أفضل واجهة برمجة تطبيقات (API) لتحويل النص إلى كلام لروبوتات الدردشة والمساعدات الصوتية في عام 2026

23 فبراير 2026

تبدو النسخة التجريبية من مساعدك الصوتي طبيعية. تقوم بتشغيل نفس العبارات التجريبية العشر في كل مرة تقيم فيها واجهة برمجة تطبيقات (API) جديدة لتحويل النص إلى كلام (TTS)، وتأتي الاستجابات نظيفة، ويشعر الصوت وكأنه قريب من البشر. ثم تضعه أمام مستخدمين حقيقيين. وبحلول التبادل الثالث، تلاحظ أن هناك شيئاً خاطئاً. لقد امتد التوقف قبل كل استجابة إلى 900 مللي ثانية. والصوت الذي كان يبدو معبراً في العزلة يبدو الآن مسطحاً في الإجابة الخامسة على التوالي. أصبح المستخدمون يتسامحون مع الصوت بدلاً من التحدث إليه.

إن تقييم TTS لروبوتات الدردشة والمساعدات الصوتية متفائل بشكل منهجي لأن الظروف التي تكسر هذه المنتجات - التفاعل المستمر متعدد الأدوار تحت حمل الشبكة الحقيقي - أصعب في المحاكاة من اختبار الجودة لطلب واحد.

ما لا تقيسه العروض التجريبية أحادية الجولة

هناك ثلاثة أشياء تحدد ما إذا كانت واجهة برمجة تطبيقات TTS تعمل مع الذكاء الاصطناعي التوليدي، ولا يتم تمثيل أي منها بشكل جيد في مقطع مدته 10 ثوانٍ:

زمن وصول تبادل الأدوار تحت الحمل. يشعر المساعد الصوتي بالاستجابة عندما يكون التوقف بين إدخال المستخدم والاستجابة الصوتية أقل من 400 مللي ثانية. تقدم معظم واجهات برمجة تطبيقات TTS ذلك في بيئة اختبار ذات حمل خفيف. السؤال هو ماذا يحدث عندما يكون هناك 200 مستخدم في محادثات نشطة في وقت واحد. تعتبر طفرات زمن الوصول (Latency) عند التزامن هي الشكوى الأساسية في عمليات نشر المساعدات الصوتية الإنتاجية.

يبلغ حد الإدراك البشري للاستجابة الحوارية حوالي 400-500 مللي ثانية. بعد ذلك، يبدأ المستخدمون في ملء الصمت بالكلام، مما يخلق تداخلاً. هذا ليس تفضيلاً لتجربة المستخدم (UX) فحسب - بل هو حد فسيولوجي. عندما أجرينا اختبار حمل بـ 50 محادثة متزامنة محاكاة على منصة من الفئة المتوسطة، قفز TTFB من 180 مللي ثانية إلى 2.8 ثانية. تحول المساعد الصوتي من مستجيب إلى معطل دون سابق إنذار، ولم يذكر أي شيء في وثائق المورد أن ملف تعريف زمن الوصول سيتغير بشكل كبير تحت الحمل المتزامن.

اتساق الصوت في المحادثات متعددة الأدوار. تنتج بعض نماذج TTS نبرة صوت (prosody) مختلفة قليلاً لنفس النص في المكالمات المتكررة. في التفاعل أحادي الجولة، لا يلاحظ أحد ذلك. أما في محادثة من 10 أدوار، فيراكم الصوت تناقضات دقيقة تجعله يبدو أقل كشخصية ثابتة وأكثر كنظام يولد استجابات.

هذه المشكلة لها اسم في فرق الإنتاج: "انهيار الشخصية" (persona collapse). واجهناها أثناء اختبار واجهة برمجة تطبيقات TTS شهيرة لروبوت دردشة لخدمة العملاء. بحلول الدور السادس من المحادثة، انجرف صوت خدمة العملاء الدافئ في الأصل إلى شيء يشبه مذيع أخبار استيقظ للتو. اختفى الدفء. واختل الإيقاع. الصوت الذي كان يبدو مقصوداً في الاختبار بدا عشوائياً عند الاستخدام. قمنا في النهاية بحل مشكلة الانجراف متعدد الأدوار في Fish Audio عن طريق تعديل معايير محددة - ولكن حقيقة أننا اضطررنا لقضاء وقت في ذلك لم تكن موجودة في أي وثائق.

النطاق العاطفي عبر أنواع الاستجابات. يتعامل الذكاء الاصطناعي الحواري مع التحيات، والتفسيرات، والتصحيحات، والاعتذارات. يحتاج صوت TTS إلى التعديل بشكل مناسب عبر كل هذه الأنواع، وليس فقط أن يبدو جيداً عند قراءة عبارة محايدة.

مقارنة واجهات برمجة تطبيقات TTS للذكاء الاصطناعي الحواري

| المنصة | TTFB | البث المباشر (Streaming) | اتساق الحوارات المتعددة | استنساخ الصوت | اللغات | الجلسات المتزامنة |

|---|---|---|---|---|---|---|

| Fish Audio | على مستوى المللي ثانية | نعم | عالٍ | نعم (عينة 15 ثانية) | 30+ | عالٍ |

| ElevenLabs | تنافسي | نعم | عالٍ | نعم | 30+ | متوسط |

| Azure TTS | متوسط | فئة المؤسسات | عالٍ | محدود | 100+ | مؤسسات |

| Google TTS | متوسط | محدود | عالٍ | لا | 40+ | عالٍ |

| Amazon Polly | متوسط | نعم | عالٍ | لا | 20+ | عالٍ |

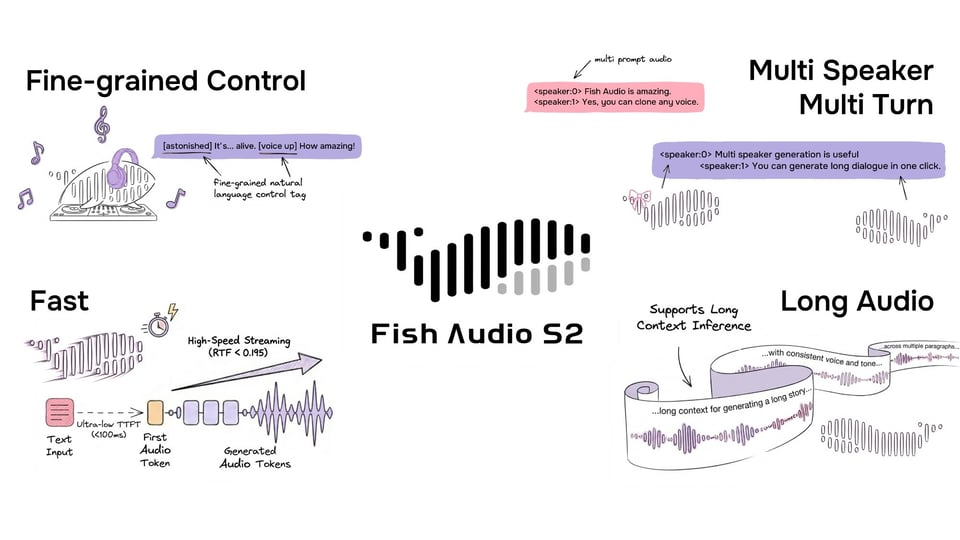

Fish Audio: زمن الوصول والاتساق في الحوارات متعددة الجولات

المتطلبان اللذان يحددان بشكل مباشر جودة المساعد الصوتي هما TTFB ودعم البث المباشر. إن زمن الوصول لأول بايت (TTFB) في Fish Audio الذي يصل لمستوى المللي ثانية، مقترناً بالتسليم عبر البث المباشر، يعني أن المستخدمين يسمعون بداية الصوت في غضون 150-200 مللي ثانية على اتصال عادي. هذا يقع ضمن النطاق الذي يجعل تبادل الأدوار يبدو طبيعياً وليس متأخراً.

أهمية البث المباشر تختلف بالنسبة للذكاء الاصطناعي الحواري عنها بالنسبة لـ TTS للمحتوى. بالنسبة للمساعد الصوتي، تحمل الكلمات الأولى من الاستجابة أعلى وزن دلالي: "نعم، يمكنني المساعدة في ذلك" مقابل "أنا آسف، هذا ليس شيئاً يمكنني القيام به". مع البث المباشر، تصل تلك الكلمات الأولى في أقل من 200 مللي ثانية. يفهم المستخدم اتجاه الاستجابة قبل إنشاء الجملة الكاملة. هذا يختلف نوعياً عن الانتظار لمدة 800 مللي ثانية حتى يكون الصوت الكامل جاهزاً قبل تشغيل أي جزء منه.

الهيكل الذي يجعل هذا يعمل هو ربط تدفق مخرجات LLM مباشرة بتدفق مدخلات TTS. بدلاً من انتظار نموذج اللغة لإنهاء استجابته الكاملة، تقوم بتغذية أجزاء النص في Fish Audio أثناء إنشائها. يعمل خط أنابيب بث LLM وخط أنابيب بث TTS بالتوازي، ويتقلص إجمالي زمن الوصول إلى ما يقرب من زمن وصول المرحلة الأبطأ - وليس مجموع الاثنين. هكذا تحصل على زمن وصول من البداية إلى النهاية أقل من 500 مللي ثانية في نشر حواري حقيقي.

ملاحظة للمطور: لا ترسل استجابات LLM الطويلة كدالة TTS واحدة. قم بتقسيمها عند حدود الجمل الطبيعية وقم ببثها كمكالمات TTS أقصر بالتتابع. يتيح لك هذا بدء تشغيل الصوت في وقت أقرب ويمنح المستخدمين نقطة توقف طبيعية للمقاطعة - وهو ما يحدث في المحادثات الحقيقية.

يعني دعم التزامن العالي أن ملف تعريف زمن الوصول الذي تلاحظه أثناء التطوير هو نفسه الذي سيختبره المستخدمون فعلياً. تعكس الحالة الموثقة لروبوت دردشة حواري يحقق زمن وصول أقل من 500 مللي ثانية من البداية إلى النهاية باستخدام Fish Audio ظروف العالم الحقيقي، وليس بيئة قياس محسنة.

يضيف استنساخ الصوت بعداً يهم بشكل خاص للمساعدات ذات العلامات التجارية وشخصيات المنتجات. بدلاً من الاختيار من كتالوج للأصوات العامة، يمكنك إنشاء شخصية صوتية محددة تتوافق مع هوية منتجك. متطلب عينة الـ 15 ثانية يجعل هذا عملياً دون الحاجة إلى جلسات تسجيل احترافية. يعمل الصوت المستنسخ عبر جميع اللغات الـ 30+ المدعومة، لذا تتوسع شخصية صوتية واحدة لتشمل عمليات النشر الدولية دون إعادة التسجيل.

كتالوج الأصوات في Fish Audio ضخم - أكثر من 2,000,000 صوت مجتمعي - ويوفر خيارات فورية إذا كنت لا ترغب في الاستنساخ. ولكن من الجدير بالذكر أن الكتالوج يميل نحو ملفات تعريف صوتية معينة. إذا كنت بحاجة إلى لهجة إقليمية محددة جداً أو صوت شخصية مميز للغاية، فقد تحتاج إلى استنساخ واحد بدلاً من العثور عليه في الكتالوج، مما يضيف خطوة إلى عملية الإعداد. هذا ليس عائقاً، ولكنه توقع واقعي يجب وضعه قبل البدء.

وثائق واجهة برمجة التطبيقات (API) متاحة في docs.fish.audio.

ElevenLabs: حالة الجودة للمساعدات الصوتية باللغة الإنجليزية

بصراحة، إذا كنت تبني ذكاءً اصطناعيًا مرافقًا غامرًا باللغة الإنجليزية وكان الصوت نفسه هو المنتج، فإن النطاق العاطفي لـ ElevenLabs لا يزال هو المعيار. الفرق بين كيفية تعامل ElevenLabs ومعظم المنصات الأخرى مع التردد والتركيد والصبغة العاطفية في اللغة الإنجليزية مسموع بوضوح. إنه ليس فرقاً هامشياً. بالنسبة لمنتج تكون فيه شخصية الصوت أساسية لتجربة المستخدم - تطبيق مرافق، مساعد سرد قصص، أداة علاجية - فإن جودة مخرجات ElevenLabs بالإنجليزية تبرر التنازلات.

تلك التنازلات حقيقية. يعني نموذج التسعير لكل فئة أن فترات الانشغال تدفعك إلى فئات خطط أعلى، وبالنسبة للمنتجات ذات الاستخدام المتقلب، تصبح الفواتير غير متوقعة. أداء البث المباشر جيد في الظروف القياسية، لكن التزامن على نطاق واسع هو المكان الذي تتمتع فيه Fish Audio بميزة هيكلية. بالنسبة لمساعد صوتي يتعامل حصرياً مع اللغة الإنجليزية وحيث يكون حجم المحادثة متوقعاً، فإن ElevenLabs هي الخيار الأقوى من حيث جودة المخرجات البحتة. أما بالنسبة لأي شيء متعدد اللغات أو عالي التزامن، فإن هذه الحسابات تتغير.

Azure TTS: مسار النشر للمؤسسات

وصلت جودة Azure Neural TTS إلى مستوى جعلها تنافسية للتطبيقات الحوارية. إن الموثوقية واتفاقية مستوى الخدمة (SLA) للمؤسسات تجعلها الخيار الافتراضي للمنظمات التي تعمل بالفعل على بنية Azure التحتية.

يتوفر البث المباشر ولكنه يتطلب عادةً الوصول إلى فئة المؤسسات. استنساخ الصوت معقد في التهيئة وغير مصمم لهذا النوع من الإنشاء السريع للأصوات الذي يحتاجه منشئو المحتوى أو فرق التطوير الصغيرة. إذا كانت حالة الاستخدام الخاصة بك هي نظام IVR للمؤسسات أو روبوت خدمة عملاء واسع النطاق مع متطلبات صوتية ثابتة ومحددة، فإن Azure يعمل بشكل جيد. بالنسبة لتطوير الذكاء الاصطناعي الحواري الأكثر تجريبية، فإن أعباء التهيئة تبطئ من سرعة التكرار.

أنماط تصميم الصوت التي تحسن جودة الحوار

اختيار المنصة هو أداة واحدة. وكيفية تهيئة التفاعل الصوتي هي أداة أخرى.

استخدم البث المباشر منذ الاستجابة الأولى. لا تنتظر حتى تتأكد من توفر الصوت الكامل. ابدأ في تشغيل الجزء الأول وقم بتخزين الباقي مؤقتاً. الشعور بالحوار يأتي من سرعة الصوت الأول، وليس سرعة الصوت المكتمل.

طابق اختيار الصوت مع سياق حالة الاستخدام. يجب أن يبدو صوت الذكاء الاصطناعي المرافق وصوت روبوت خدمة العملاء مختلفين. الملف العاطفي يهم: أكثر دفئاً لتطبيقات المرافق، وأكثر اتزاناً لتقديم المعلومات، وأكثر حيوية للتطبيقات الاستهلاكية.

اجعل الاستجابات الفردية قصيرة. تكون جودة TTS لكل وحدة صوتية أعلى للعبارات القصيرة والمكتملة. الاستجابات الطويلة تزيد من فرص عدم اتساق نبرة الصوت. إذا أنشأ LLM إجابة من 4 جمل، ففكر فيما إذا كان بثها كـ 4 مكالمات TTS منفصلة (وتشغيلها بالتتابع) يقدم جودة صوت أفضل من مكالمة واحدة بمدخل من 4 جمل.

قم بإنشاء الاستجابات الثابتة مسبقاً. يتم إنشاء التحيات والاعترافات والانتقالات ("دعني أتحقق من ذلك لك") بشكل متطابق في كل مرة. قم بإنشاء هذه مسبقاً مرة واحدة وخدمها من ذاكرة التخزين المؤقت. ستلغي زمن وصول واجهة برمجة التطبيقات تماماً لأكثر العبارات تكراراً.

ملاحظة للمطور: تحتاج المساعدات الصوتية إلى التعامل مع المقاطعة. إذا تكلم المستخدم أثناء تشغيل TTS، يجب أن يتوقف الصوت بشكل نظيف. قم بتنفيذ ذلك قبل الاختبار مع مستخدمين حقيقيين - تجربة مستخدم المقاطعة هي الشيء الأول الذي يجعل المساعدات الصوتية تبدو غير طبيعية.

مطابقة المنصة مع نوع روبوت الدردشة

الذكاء الاصطناعي المرافق والروبوتات الاجتماعية: النطاق العاطفي وطبيعية الصوت تهم أكثر من أي متغير آخر. Fish Audio أو ElevenLabs. تزداد ميزة Fish Audio إذا كنت بحاجة إلى دعم متعدد اللغات أو صوت شخصية مخصص.

روبوتات خدمة العملاء: الدعم متعدد اللغات والموثوقية هما الأكثر أهمية. تتعامل Fish Audio مع 30+ لغة بواجهة برمجة تطبيقات واحدة وجودة متسقة. التزامن العالي مهم لتطبيقات خدمة العملاء التي تشهد طفرات في الحجم.

أنظمة IVR والهاتف: متطلبات زمن الوصول أكثر مرونة قليلاً من مساعدي الصوت على الويب/التطبيقات. التحكم في SSML للنطق والإيقاع يهم أكثر. Azure أو Amazon Polly مناسبان تماماً لقناة الهاتف تحديداً.

مساعدو المعلومات (روبوتات الأسئلة الشائعة، روبوتات المعرفة): يجب أن يبدو الصوت موثوقاً وواضحاً. يعمل أي صوت محايد ومتزن من أي من المنصات الرئيسية. زمن الوصول والتكلفة هما الممايزان الأساسيان في هذه المرحلة.

الأسئلة الشائعة

ما هو زمن وصول TTS الذي أحتاجه ليشعر روبوت الدردشة الصوتي بالطبيعية؟ أقل من 400 مللي ثانية من TTFB (زمن الوصول لأول صوت) يحافظ على تبادل الأدوار الحواري الطبيعي. أقل من 200 مللي ثانية يشعر بالاستجابة الفورية. أكثر من 600 مللي ثانية يجعل المستخدمين يبدأون في التحدث قبل أن ينتهي الروبوت، أو ينتظرون في صمت غير مريح. يحافظ TTFB الخاص بـ Fish Audio على مستوى المللي ثانية على بقاء الاستجابات في النطاق الطبيعي.

هل يمكنني إنشاء صوت مخصص لعلامتي التجارية لمساعدي الصوتي؟ نعم. يقوم استنساخ الصوت في Fish Audio بإنشاء صوت للعلامة التجارية من تسجيل مدته 15 ثانية، والذي يقوم بعد ذلك بإنشاء جميع مخرجات TTS بهذا الصوت. يعمل الاستنساخ عبر 30+ لغة، لذا يتوسع صوت علامة تجارية واحدة ليشمل عمليات النشر الدولية.

هل يعمل بث TTS مع خطوط أنابيب الذكاء الاصطناعي الحواري؟ نعم، وهي البنية الموصى بها. يعني البث من Fish Audio أن المستخدم يسمع بداية الاستجابة بينما لا يزال الباقي قيد الإنشاء. عند اقترانه بإنشاء النص المتدفق من LLM، يمكن أن ينخفض زمن الوصول من البداية إلى النهاية من إدخال المستخدم إلى الاستجابة المسموعة إلى أقل من 500 مللي ثانية.

ماذا يحدث لجودة TTS في محادثة طويلة (أكثر من 10 أدوار)؟ يتم تحديد اتساق الصوت عبر الأدوار بواسطة نموذج TTS، وليس طول المحادثة. ينتج نموذج Fish Audio نبرة صوت متسقة في المكالمات المتكررة، مما يمنع انجراف الصوت الذي تظهره بعض المنصات عبر الجلسات متعددة الأدوار.

هل يستحق استنساخ الصوت استخدامه لروبوت دردشة لخدمة العملاء؟ بالنسبة لروبوتات الدردشة ذات العلامات التجارية حيث تهم هوية الشركة المتسقة، نعم. الصوت المستنسخ الذي يطابق أسلوب تواصل علامتك التجارية أكثر فعالية من الاختيار من كتالوج عام. يجعل الحد الأدنى لعينة Fish Audio البالغ 15 ثانية هذا الأمر عملياً دون ميزانية تسجيل احترافية.

أي واجهة برمجة تطبيقات TTS تتعامل بشكل أفضل مع محادثات روبوتات الدردشة المتزامنة المتعددة؟ تم تصميم دعم التزامن العالي في Fish Audio خصيصاً لهذا الغرض. يظل ملف تعريف زمن الوصول ثابتاً تحت الحمل المتزامن. تتعامل Azure و Google أيضاً مع التزامن العالي بشكل جيد، وإن كان ذلك مع توازنات مختلفة في الجودة والميزات.

خاتمة

بالنسبة للذكاء الاصطناعي الحواري، يعود اختيار واجهة برمجة تطبيقات TTS إلى سؤالين: هل يمكنها تقديم الصوت بسرعة كافية تجعل تبادل الأدوار يبدو طبيعياً، وهل يمكنها الحفاظ على هذا الأداء عندما تحدث مئات المحادثات في وقت واحد؟

إن TTFB الخاص بـ Fish Audio على مستوى المللي ثانية، ودعم البث المباشر، والتزامن العالي، واستنساخ الصوت تجعلها الخيار الأكثر اكتمالاً لعمليات النشر الحوارية. ElevenLabs لحالات الاستخدام التي تركز على اللغة الإنجليزية أولاً حيث يكون الصوت نفسه جزءاً من المنتج. Azure و Google لعمليات النشر في المؤسسات أو تلك المرتبطة بالبنية التحتية حيث تحدد تلك الأنظمة البيئية بالفعل الهيكل المعماري.

اختبر تحت الحمل المتزامن قبل الالتزام. المساعد الصوتي الذي يعمل مع مستخدم واحد لا يتنبأ بالسلوك عند 500 مستخدم. وثائق واجهة برمجة التطبيقات وتفاصيل التكامل متاحة في docs.fish.audio.