プロジェクトに最適なカスタムキャラクターボイスを作成できるAIツールは?

2026年2月22日

ほとんどのAI音声ツールは、セリフを「読む」ことはできますが、「演じる」ことができるものはごくわずかです。解説動画やポッドキャストのナレーションではその差は重要ではありませんが、キャラクター主導の作品では極めて重要になります。嘘を告白する不安なティーンエイジャーの声は、落ち着いたナレーターが不安そうな言葉を読んでいるようには聞こえません。悪役の独白には、単に「怒り」のプリセットをすべての文に均等に適用するのではなく、徐々に高まっていくような間(ま)が必要です。

500行にわたる分岐ダイアログで10人のキャラクターに声を当てる場合、シーン1を担当したツールは、複数の言語であっても、シーン47で同じキャラクターのように聞こえなければなりません。これは、ほとんどのAI音声ジェネレーターが想定しているよりも、はるかに厳しく、要求水準の高いテストです。

デモでは良く聞こえるAI音声。キャラクターには「それ以上」が必要。

キャラクターの声はプレッシャーの下で崩れます。落ち着いた文章の10秒間のデモクリップは、ほぼすべてのプラットフォームで洗練されて聞こえるでしょう。しかし、キャラクターは囁き、叫び、同じセリフの中で皮肉から誠実さへと変化します。

そこが多くのツールの苦手な点です。プレビューモードでは印象的だった声も、2分間のシーン全体で感情を維持しようとするとロボットのようになってしまいます。それはペース配分に現れます。すべての文が同じリズムになり、すべてのポーズが機械的に入り、「怒り」のプリセットは単に音量を上げただけの無感情な話し方に聞こえてしまいます。

キャラクター制作のためにツールを評価する際は、ほとんどのスペックシートが無視している以下の3つの要素に注目してください。

- ストレス下での感情表現の幅: 単一の段落内でトーンを変化させることができるか、それとも1回の生成につき1つのプリセットしか処理できないか。

- 長いセッションを通じた一貫性: シーン1とシーン47でキャラクターの声が違って聞こえると、没入感が損なわれます。ジェネレーターによっては、長いスクリプトを作成するうちに声が変質してしまうものがあります。

- 言語を超えたアイデンティティ: ぶっきらぼうなスペースマリーンの声を、日本語、ドイツ語、スペイン語でも同じように再現する必要がある場合、ほとんどのプラットフォームでは言語ごとに全く異なる人格になってしまいます。

キャラクターボイスに対応する7つのAIツール(実用的な基準でランク付け)

詳細に入る前に、簡単な概要を説明します。各ツールは、感情のコントロール、声の一貫性、多言語キャラクターの維持、そしてダイアログの多いプロジェクトにおける現実的な価格設定に基づいて評価されています。

| ツール | 最適な用途 | 感情コントロール | 音声クローン | 開始価格 |

|---|---|---|---|---|

| Fish Audio | ゲーム、アニメ、多言語キャラクター | 感情タグ(きめ細やか) | 15秒のサンプル | 無料枠 / 月額5.50ドル |

| ElevenLabs | 英語優先の洗練されたナレーション | プリセット | 60秒のサンプル | 無料枠 / 月額5ドル |

| Replica Studios | ゲームエンジンとの統合 | ダイアログ特化 | カスタムモデル | サブスクリプション |

| Resemble AI | エンタープライズゲームスタジオ | API駆動 | カスタムトレーニング | 個別見積もり |

| Murf AI | 企業/研修用キャラクターコンテンツ | スタイルプリセット | ボイスチェンジャー | 月額29ドル |

| Respeecher | 映画/AAA制作 | Speech-to-Speech | プロフェッショナル級 | 個別見積もり |

| Voice.ai | リアルタイム配信/ゲーミング | リアルタイムフィルター | 制限あり | 無料アプリ |

Fish Audio:99ドルの代替ツールよりもインディーデベロッパーに選ばれ続ける月額5.50ドルのツール

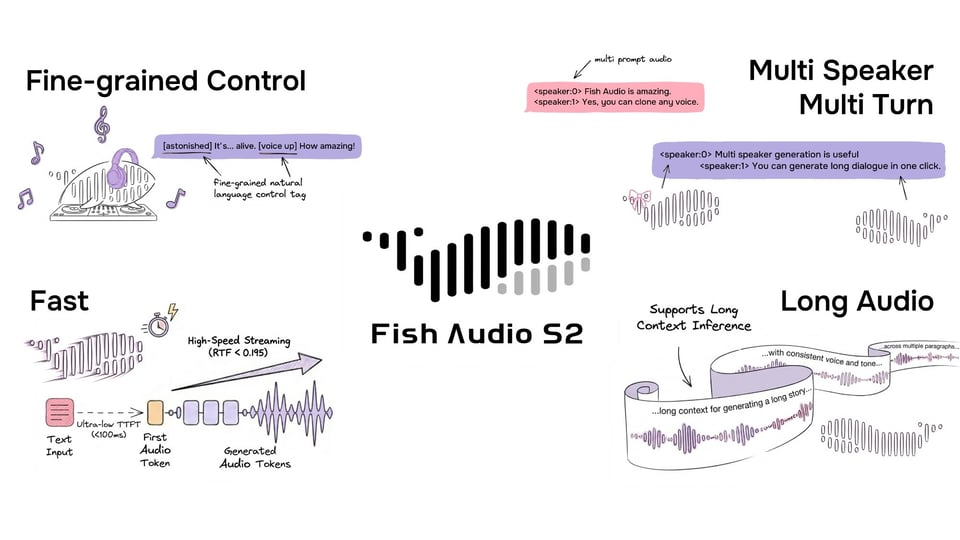

Fish Audioは、多くのプラットフォームとは異なる方法でキャラクターボイスにアプローチしています。あらかじめ用意された感情カテゴリだけに頼るのではなく、タグベースの感情システムを使用することで、セリフごとにより細かな演出が可能です。単に「嬉しい」や「悲しい」を選択するだけでなく、スクリプト内で表現の仕方を形作ることができます。

キャラクター重視のプロジェクトにおいて、特に際立つ3つの機能があります。

- 15秒の音声クローン: Fish Audioの音声クローンは、わずか15秒のリファレンスオーディオを必要とするだけで、これはElevenLabsが必要とする時間の約3分の1です。実際、これによりキャラクターの声を素早くスケッチし、実際のダイアログでテストし、事前に何時間ものサンプル録音を行うことなく反復修正することができます。生成されたクローンは、シーンを跨いでも認識可能なほど十分にボーカルアイデンティティを捉えています。

- 言語を超えたキャラクターの一貫性: 英語のキャラクタークローンは、トーンのアイデンティティを維持したまま、他のサポートされている言語でダイアログを生成できます。ぶっきらぼうなスペースマリーンはぶっきらぼうなままであり、不安なティーンエイジャーは不安なままです。多くのプラットフォームは各言語を個別の音声モデルとして扱うため、ローカライズによって性格が変わってしまうことがあります。

- ダイアログの多いスクリプトに対するコスト効率: 生成された音声1時間あたり約2.99ドル、月額5.50ドルからの有料プラン(API価格はElevenLabsより45〜70%低い)により、ソロデベロッパーでも予算を気にすることなく、ダイアログの多いゲーム全体の音声を作成できます。コミュニティの音声ライブラリには20万以上の音声があるため、クローンを作成する前に、キャラクターのコンセプトに近い出発点をすぐに見つけることができます。

Fish AudioのStory Studioは、特に複数のキャラクターが登場するプロジェクトに役立ちます。キャラクターごとに異なる音声を割り当て、セリフごとに感情の演出を調整し、プロフェッショナルな標準(長編ナレーション向けのACX/Audible仕様を含む)に合わせてエクスポートできる構造化されたワークスペースを提供します。10以上のセリフ担当がいるゲームの場合、これにより手動の整理時間を大幅に短縮できます。

ElevenLabs:洗練された英語が必要で、トレードオフを気にしない場合

ElevenLabsは、生の英語音声の品質で定評があります。ブラインドテストでは、その出力は一貫して最も自然に聞こえるものの一つにランク付けされ、音声ライブラリはユースケース、年齢、性別、言語別に整理されています。

キャラクター制作において、このプラットフォームはストーリーテリングやゲーミングに適した感情コントロールと様式化された音声を提供します。ライブラリには、特定のアーキタイプに適した専用のキャラクターボイスが含まれています。

とはいえ、キャラクター重視のクリエイターが躊躇する点が2つあります。

- 規約とデータポリシー: 2025年初頭、ElevenLabsは利用規約を更新し、アップロードされた音声データに対する広範な権利を含めました。貴重なIP(知的財産)を代表するオリジナルのキャラクターボイスをクローンする場合は、続行する前に現在の規約の内容を注意深く確認する必要があります。

- 多言語品質の格差: 英語の出力は依然として最強です。英語以外のパフォーマンスは、言語によって発音や強調に一貫性がないという報告もあり、ばらつきがあります。

無料枠では、クローン機能なしで毎月10,000文字を利用できます。有料プランは月額5ドルからですが、クレジットベースのシステムは、セリフの生成、テスト、再生成を繰り返すダイアログの多いプロジェクトでは高額になる可能性があります。

Replica Studios:汎用ではなく、ゲーム開発者のために構築

Replica Studiosは、汎用のTTSではなく、ゲーム開発のワークフローを特に対象として設計された数少ないプラットフォームの一つです。その機能セットには、その焦点が反映されています。

- ゲームエンジン統合: UnityおよびUnreal Engineを直接サポートし、一般的なゲームのアーキタイプ(ヒーロー、悪役、NPC)に合わせてキュレーションされた音声ライブラリを提供。

- 1行につき複数のテイク: 伝統的な音声収録では、ディレクターは俳優に同じセリフを数テイク録音させ、異なる感情的なニュアンスを捉えます。Replicaはこのワークフローをデジタルで再現し、手動でプロンプトを再入力することなくバリエーションを提供します。

- ゲームオーディオの一括書き出し: 書き出しはゲームオーディオの要件に合わせて調整されているため、エンジンの期待に合わせてファイルを再フォーマットする手間が省けます。

- ダイアログ特化型ツール: 分岐する会話用に設計されており、ダイアログ行に直接埋め込まれた感情演出のサポートを備えています。

サブスクリプションプランは通常、生成されたダイアログの単語数に基づいています。このプラットフォームは、専用のツールを求め、ゲーム以外のユースケースにおける機能の少なさを許容できる開発者に最適です。

Resemble AI:コンプライアンス要件のあるスタジオ向けのエンタープライズグレード

Resemble AIは、市場のプロフェッショナル層をターゲットにしています。キャラクター制作における主な機能は以下の通りです。

- カスタム音声モデル + 感情コントロール: APIを通じてキャラクター固有の音声を構築し、きめ細やかな感情調整が可能です。

- Speech-to-Speech複製: 声優がリファレンスパフォーマンスを録音し、AIがそれを追加のダイアログにスケールさせます。これは、大規模なスクリプト全体でパフォーマンスの連続性を維持するのに特に役立ちます。

- ディープフェイク検出 + ニューラルウォーターマーク: 組み込みの検証ツールにより、法的、倫理的、およびコンプライアンス上の考慮事項を扱うスタジオをサポートします。

エンタープライズ向けの価格設定のため、多くのインディーデベロッパーには手が届きにくいです。個人向けプランも存在しますが、コンシューマー向けの代替ツールよりも高価です。スタジオがコンプライアンスツールや構造化されたガバナンスを必要とする場合、Resembleは評価に値します。ソロデベロッパーにとっては、コスト構造が障壁になるかもしれません。

Murf AI、Respeecher、Voice.ai:特定のシナリオ向けのニッチな選択肢

- Murf AIは、クリーンなインターフェースと組み込みのビデオエディターを組み合わせており、キャラクター主導のトレーニングやマーケティングコンテンツを制作するチームにとって実用的です。20以上の言語で200以上の音声を提供し、専門用語の発音エディターを備え、構造化されたワークフローをサポートしています。プランは月額29ドルから。インディーゲームのプロジェクトには価格が高いかもしれませんが、企業のキャラクターコンテンツには適しています。

- Respeecherは、映画やAAA制作の分野で活動しています。そのSpeech-to-Speechテクノロジーは、明示的な許可を得て歴史的な声を再現するために、ドキュメンタリーや長編映画のプロジェクトで使用されています。カスタム価格のため、チームとの直接の交渉が必要です。これは、制作規模の予算を持つスタジオ向けの特殊なソリューションです。

- Voice.aiは、ストリーミングやゲーミング向けのリアルタイムの音声変換に焦点を当てています。テキストからキャラクターボイスを生成するのではなく、配信や録音中にライブマイク入力を様式化されたキャラクターボイスに変更できます。特定のワークフローには便利ですが、テキスト読み上げによるキャラクター生成の代わりにはなりません。

実際に通用するキャラクターボイスを構築する方法

プラットフォームを選択することは最初の一歩に過ぎません。信憑性のあるキャラクターボイスを維持するには、プロセスが必要です。

- キャラクターボイスプロフィールから始める: ジェネレーターを使用する前に、キャラクターのボーカルアイデンティティ(年齢層、アクセントの傾向、感情のベースライン、話し方のリズム、言葉のパターン(短い言葉?余韻を残す文?フォーマルな言語?))を定義します。これがセッション全体のリファレンスになります。

- 最も要求の厳しいシーンで最初にテストする: 落ち着いた説明文でツールを評価するのは避けてください。感情の変化が最も大きいシーンを生成してみましょう。プラットフォームが最も難しいダイアログを説得力を持って処理できるなら、より単純なシーンはより確実に処理できます。

- 早めにクローンし、早めに反復する: Fish Audioのように音声クローンにわずか15秒のリファレンスオーディオしか必要としないプラットフォームでは、数分でキャラクターボイスのプロトタイプを作成できます。10〜15のテストラインを生成し、一貫性を聞き取り、本格的な制作に入る前に磨きをかけます。

- 書き出し設定を事前に標準化する: サンプルレート、正規化、ファイル形式、命名規則をバッチ生成の前に固定します。プロジェクトの途中でフォーマットを修正するのは、大幅な時間の浪費になります。

特にゲーム開発者向けに、Fish AudioのAPIは開発パイプラインへの統合をサポートしており、手動の書き出し・取り込みサイクルではなく、ビルド中の自動ダイアログ生成を可能にします。

多言語問題(そしてそれが想像以上に重要な理由)

英語版のゲームは、多くの場合、日本、ドイツ、スペインなどの市場向けにローカライズを必要とします。従来のキャスティングでは、言語ごとに新しい俳優が必要となり、地域によってキャラクターの解釈が異なってしまいます。言語を超えてキャラクターのアイデンティティを維持するAI音声ツールは、構造的な優位性を提供します。Fish Audioの多言語TTSは、ボーカルの特性を維持したまま30以上の言語をサポートしているため、ローカライズによってキャラクターの一貫性を犠牲にする必要がありません。

この課題はゲームにとどまりません。アニメーションスタジオ、オーディオブック制作会社、教育コンテンツチームも同様のローカライズの制約に直面しています。キャラクターが「何を言うか」だけでなく「誰のように聞こえるか」を維持するツールは、グローバルな配信ワークフローにおいて測定可能なアドバンテージを持ちます。

結論

適切なAIキャラクター音声ツールは、制作のコンテキストによって異なります。多言語に対応し、きめ細やかな感情コントロールを必要とするほとんどのインディーデベロッパー、コンテンツクリエイター、小規模スタジオにとって、Fish Audioは品質、柔軟性、価格の最強の組み合わせを提供します。ElevenLabsは、生の音声の洗練さが最優先事項である英語中心のプロジェクトにおいて、依然として堅実な選択肢です。Replica Studiosは、エンジン統合されたワークフローを求めるゲーム開発者の真のニッチを満たしています。

実践的なアプローチ:実際のスクリプトから60秒の箇所を取り出し、2つか3つの有力なプラットフォームで生成して、出力を直接比較してみてください。キャラクターボイスの品質は本質的に主観的なものです。あなたの耳とワークフローの制約は、どんな機能比較表よりも重要です。