Audio-Trennung: Vollständiger Guide und Review 2026

27. Jan. 2026

Die Audiotrennung hat sich von einer technischen Nische zu einer Vielzahl moderner kreativer Workflows entwickelt. Im Jahr 2026 ist die KI-Audiotrennung keine experimentelle Technologie mehr, sondern ein weit verbreitetes Werkzeug für Musiker, Produzenten, DJs, Podcaster und Kreative aller Art. Egal, ob Sie Gesang und Instrumente trennen, präzise Musiktitel für Remixes isolieren oder Dialoge in einer verrauschten Spur bereinigen möchten – Tools zur Trennung von Audioquellen sind schneller, intelligenter und zugänglicher als je zuvor.

Dieser vollständige Guide und Review zur Audiotrennung 2026 führt Sie durch die Funktionsweise von Audio-Demixing, warum es heute wichtig ist, die gängigsten Anwendungsfälle, aktuelle Einschränkungen und wohin sich die Technologie entwickelt. Wenn Ihr Ziel darin besteht, Musik-Audio mithilfe von KI präzise zu trennen, bietet dieser umfassende Leitfaden alles, was Sie brauchen.

Was ist Audiotrennung (und warum ist sie wichtig)?

Audiotrennung, auch bekannt als Trennung von Audioquellen (Audio Source Separation) oder Audio-Demixing, ist der Prozess der Zerlegung einer gemischten Audiodatei (wie eines Stereo-Songs) in ihre einzelnen Komponenten:

- Gesang (Vocals)

- Schlagzeug (Drums)

- Bass

- Gitarre

- Klavier

- Synthesizer

- Dialog oder Sprache

- Soundeffekte

Früher war es fast unmöglich, Instrumente und Gesang wieder zu trennen, sobald sie in einer Stereo-Datei „festgeschrieben“ waren. Toningenieure mussten sich auf EQ-Tricks, Phasen-Tricks oder Neuaufnahmen verlassen, was zeitaufwendig und unvollkommen war. Im Gegensatz dazu nutzt die KI-Audiotrennung heute Deep Learning, um einzelne Soundelemente mit unglaublicher Genauigkeit zu erkennen und zu extrahieren.

Wie KI-Audiotrennung funktioniert

Heutige Systeme zur Trennung von Audioquellen basieren auf tiefen neuronalen Netzen, die lernen, wie sich Klang über Zeit, Frequenz und Dynamik verhält.

Kerntechnologien hinter dem Audio-Demixing

- Spektrogramm-Analyse: Audio wird in Frequenz-Zeit-Visualisierungen umgewandelt, die der KI helfen, Instrumente und Gesang zu unterscheiden.

- Neuronale Netze & Transformer: Diese Architekturen identifizieren subtile Unterschiede zwischen überlappenden Klängen, was eine zuverlässige Trennung von Gesang und Instrumenten ermöglicht.

- Maskierungstechniken: Die KI erstellt „Masken“, die ausgewählte Klänge isolieren, während andere unterdrückt werden.

- Kontextbezogenes Lernen: Moderne Modelle verstehen den musikalischen Kontext – sie wissen zum Beispiel, wie Stimmen oder Gitarrentöne klingen sollten, selbst in dichten Mixen.

Dank dieser Fortschritte sind Tools zur Trennung von Musiktiteln heute schneller, sauberer und studiobereiter als je zuvor.

Warum Audiotrennung 2026 so bedeutend ist

Der Aufstieg der KI-Audiotrennung ist kein Zufall. Mehrere Trends sind zusammengekommen, um diese Technologie unverzichtbar zu machen:

1. Creator Economy

Creator auf Plattformen wie TikTok oder YouTube wollen sauberes Audio. Die Möglichkeit, Musik-Audio zu trennen, bedeutet, Gesang für Backing-Tracks zu entfernen, Musik für Bildungsinhalte zu isolieren oder Dialoge in Videos zu verbessern.

2. Musikproduktion & Remix-Kultur

Produzenten und DJs nutzen die Trennung von Audioquellen, um:

- Remixes zu erstellen

- Acapellas zu extrahieren

- Alte Demos zu überarbeiten

- Neue Beats aus isolierten Stems zu bauen

3. Musikausbildung und Lernen

Musiker nutzen Tools zur Trennung von Gesang und Instrumenten, um:

- Mit Backing-Tracks zu üben

- Arrangements zu analysieren

- Bestimmte Parts zu studieren

4. Restaurierung und Archivierung

Archivare und Toningenieure nutzen Audio-Demixing, um alte Aufnahmen zu restaurieren, Reden zu isolieren oder gemischtes Material für die Erhaltung oder Wiederveröffentlichung zu reinigen.

5. Medienproduktion

Film-, TV- und Podcast-Produzenten verlassen sich heute auf KI-Audiotrennung, um Dialoge von Hintergrundgeräuschen zu isolieren, wenn keine Original-Multitracks verfügbar sind.

Arten von Audiotrennungs-Tools im Jahr 2026

Nicht alle Trennungs-Tools sind gleich. Die gängigsten Kategorien umfassen:

✔ Gesangs- und Instrumententrennung

Die einfachste und am weitesten verbreitete Form der Trennung von Audioquellen, mit der Sie Gesang isolieren oder stummschalten können, während die Musik erhalten bleibt.

✔ Stem-Trennung

Fortgeschrittenere Tools zerlegen einen Track in mehrere Stems, wie zum Beispiel:

- Gesang

- Schlagzeug

- Bass

- Andere Instrumente

Diese Art der Musiktiteltrennung ist essenziell für professionelle Remixing- und Produktions-Workflows.

✔ Dialog vs. Hintergrund-Trennung

Weit verbreitet in der Film- und Podcast-Bearbeitung, um Stimmen von Musik und Soundeffekten zu isolieren.

✔ Genre-spezifische Modelle

Einige KI-Modelle sind für bestimmte Genres wie Pop, Hip-Hop, Rock oder Klassik optimiert, was die Trennungsgenauigkeit für diese Stile verbessert.

Beste Anwendungsfälle für die Audiotrennung

🎧 Musikproduktion

Produzenten nutzen Audio-Demixing, um Gesang zu extrahieren, Beats zu rekonstruieren und völlig neue Versionen bestehender Tracks zu erstellen.

🎛 DJing & Live-Performance

DJs verlassen sich auf die Trennung von Musiktiteln, um Gesang für Live-Mashups zu isolieren, Instrumental-Breaks zu erstellen oder individuelle Übergänge zu bauen.

📱 Erstellung von Inhalten

Creator können:

- Urheberrechtlich geschützten Gesang entfernen

- Hintergrundmusik isolieren

- Die Dialogklarheit in Videos verbessern

📚 Musikausbildung

Lehrer und Schüler nutzen die Trennung von Gesang und Instrumenten, um Tracks zu verlangsamen, sich auf einzelne Parts zu konzentrieren und Techniken zu analysieren.

🔊 Barrierefreiheit & Rundfunk

Isolierte Sprachspuren liefern klareres Audio für hörgeschädigte Hörer und sauberere Dialoge nach dem Mix für den Rundfunk.

Stärken und Einschränkungen

✔ Stärken

- Schnelle Bearbeitungszeit und Verarbeitung

- Sauberere Extraktion von Gesang und Instrumenten

- Besserer Umgang mit überlappenden Frequenzen

- Benutzerfreundliche Oberflächen für Anfänger

✖ Einschränkungen

- Artefakte in extrem dichten Mixen

- Hall und Effekte können Quellen verschwimmen lassen

- Komplexe orchestrale oder vielschichtige Aufnahmen fordern Trennungsmodelle weiterhin heraus

Trotz der Herausforderungen sind Tools zur Trennung von Audioquellen im Jahr 2026 deutlich leistungsfähiger und zuverlässiger als frühe Alternativen.

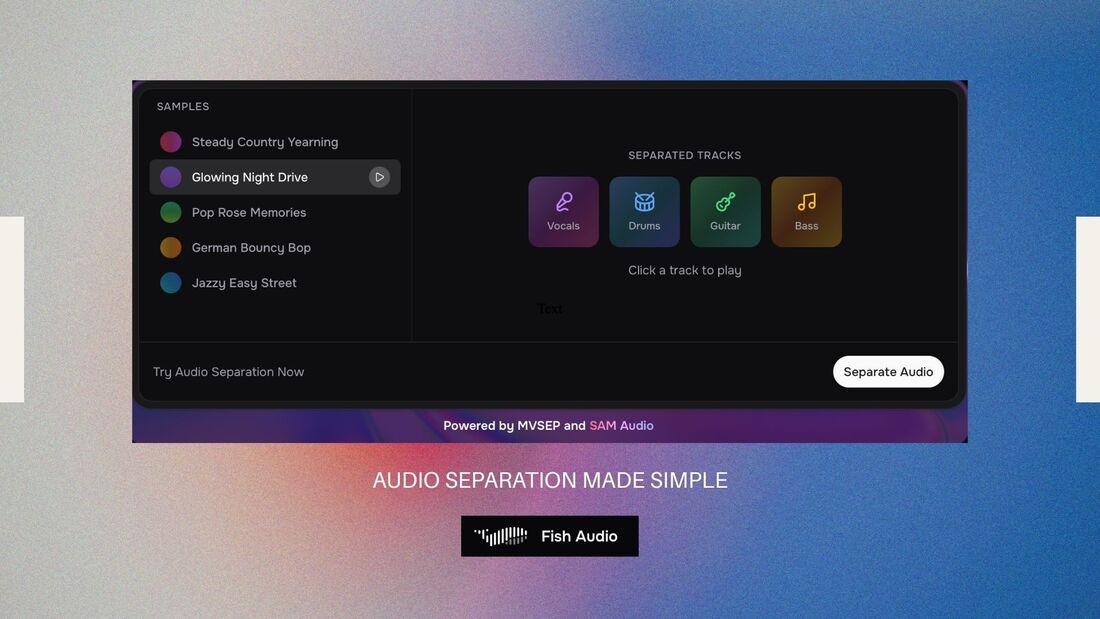

Audiotrennungs-Workflow (Benutzerfreundlich im Jahr 2026)

Ein typischer Workflow heute könnte so aussehen:

- Eine Audiodatei hochladen

- Trennungstyp wählen (Gesang/Instrumental, Stems, Dialog)

- Die KI das Audio verarbeiten lassen

- Vorschau der getrennten Spuren anhören

- Stems für Remixing oder Bearbeitung exportieren

Diese vereinfachte Erfahrung hat Operationen zur Trennung von Musik-Audio selbst für Anfänger einfach gemacht.

Die Zukunft der Audiotrennung - Fish Audio

Mit Blick auf die Zukunft umfasst die Entwicklung der KI-Audiotrennung:

- Echtzeit-Trennung während Live-Streams und Performances

- Personalisierte KI-Modelle, die auf spezifische Stimmen oder Instrumente abgestimmt sind

- Multimodale Systeme, die Video und Metadaten für eine bessere Genauigkeit integrieren

- Ethische Schutzmaßnahmen für Urheberrecht und Zustimmung

Fish Audio bietet eines der am einfachsten zugänglichen Audiotrennungs-Tools, die Sie heute ausprobieren können

Audiotrennungs-Tools wie Fish Audio & KI-Audio-Demixing werden schnell zu einem Standardwerkzeug im Werkzeugkasten jedes Audioprofis.

Fazit: Audiotrennung im Jahr 2026

Egal, ob Sie als Produzent Tracks remixen, als Podcaster Dialoge bereinigen, als DJ ein Set vorbereiten oder als Lehrer Schülern zeigen, wie ein Song aufgebaut ist – die Fähigkeit, Gesang und Instrumente zu trennen, präzise Musiktitel zu isolieren und intelligente Workflows zur Trennung von Audioquellen zu nutzen, hat unsere Interaktion mit Klang grundlegend verändert.

Von Mainstream-Tools bis hin zu modernster Forschung (wie KI-Modellen, die aus massiven Audiodatensätzen lernen) ist Audio-Demixing heute eine grundlegende Fähigkeit für jeden, der mit Audio arbeitet… und das ist erst der Anfang.