Cómo transformar prompts en canciones completas: de texto a música

8 mar 2026

No hace mucho, crear una canción significaba reservar tiempo en un estudio, contratar músicos o, como mínimo, pasar horas con estaciones de trabajo de audio digital. Los profesionales de la industria necesitaban un título para entenderlo. Ahora, puedes escribir una frase y tener una pista terminada en menos de un minuto. La IA de texto a música se ha convertido silenciosamente en una de las herramientas creativas más emocionantes disponibles, y está captando la atención de creadores de contenido, cineastas independientes, desarrolladores de juegos y aficionados curiosos por igual, especialmente cuando esas pistas son libres de regalías.

Pero, ¿cómo funciona realmente? Y lo que es más importante, ¿cómo escribir prompts que generen música que realmente quieras usar? Vamos a desglosarlo.

Introducción

El texto a música consiste básicamente en que un modelo de IA genera audio basado en tu descripción. La tecnología ha evolucionado rápidamente. Las primeras herramientas podían producir bucles básicos o progresiones de acordes sencillas. Los modelos actuales pueden generar composiciones completas con versos, ganchos e instrumentación diferenciados, y algunos de ellos suenan realmente profesionales.

En su funcionamiento interno, estos sistemas se entrenan con conjuntos masivos de datos de pares de música y texto. Aprenden las relaciones entre el lenguaje descriptivo ("piano melancólico", "sintetizador de los 80 enérgico", "lo-fi con sonido de lluvia") y las cualidades sonoras reales que representan esas palabras. Cuando escribes un prompt, el modelo lo interpreta y construye un audio que coincide con la vibración que describiste.

Esto es fundamentalmente diferente de las bibliotecas de música de stock. No estás buscando algo parecido a lo que necesitas. Estás generando algo adaptado a tu visión exacta; si no acierta, puedes refinar el prompt e intentarlo de nuevo.

La frase "libre de regalías" tiene mucho peso para cualquiera que cree contenido de forma profesional o semiprofesional. Las licencias tradicionales pueden ser complicadas: compras una pista, pero los derechos son confusos, la plataforma la reclama o recibes un reclamo por derechos de autor en un video en el que pasaste 40 horas editando.

Las canciones de IA libres de regalías evitan gran parte de esa fricción. Dado que el audio se genera de forma nueva en lugar de reproducirse a partir de una grabación protegida por derechos de autor, los derechos de uso suelen ser mucho más claros. La mayoría de las plataformas de música con IA ofrecen pistas que son gratuitas para usar en videos de YouTube, podcasts, contenido social, cortometrajes y proyectos comerciales; a veces con una atribución sencilla, a veces sin ninguna condición.

Esto es enormemente importante para los pequeños creadores que no pueden pagar las tarifas de las licencias pero que aún así quieren que su contenido parezca profesional. Es importante para los desarrolladores de juegos que necesitan horas de música ambiental adaptativa. Es importante para los especialistas en marketing que necesitan una entrega rápida de anuncios de video sin dolores de cabeza legales.

Aquí es donde la mayoría de la gente se equivoca: escriben prompts vagos y luego se preguntan por qué el resultado suena genérico. "Música de fondo alegre" te dará algo técnicamente alegre, pero no será interesante. Los prompts específicos y por capas son los que separan un resultado olvidable de algo que vale la pena conservar.

Añade capas a tus descriptores

Un prompt musical sólido suele cubrir cuatro aspectos: género o estilo, estado de ánimo o emoción, instrumentación y tempo o nivel de energía. "Orquestal cinematográfico, tenso y creciente, cuerdas y metales pesados, tempo lento con un aumento dramático" le da a la IA mucho más con qué trabajar que "música tensa para una película".

Referencia épocas y escenas

Los modelos de música por IA responden bien a las referencias contextuales. Frases como "suena como una lista de reproducción de una cafetería de finales de los 90" o "el tipo de música que suena en una escena inicial de ciencia ficción retro de los 80" le dan al modelo anclajes estilísticos. Básicamente, estás evocando un recuerdo estético muy específico, y el modelo recurre a los patrones que aprendió de la música asociada con esas atmósferas.

Especifica la estructura cuando sea importante

Si necesitas una pista con un arco definido (una introducción tranquila, un desarrollo medio y un final intenso), indícalo. Algunas plataformas te permiten describir el viaje emocional de la canción paso a paso, y este tipo de prompting estructural mejora drásticamente la utilidad de la pista final para trabajos de video o presentaciones.

Algunas herramientas que vale la pena conocer

El espacio del texto a música se ha llenado de gente rápidamente, con plataformas que van desde generadores simples hasta suites creativas completas. Dos nombres que aparecen a menudo son Suno y Fish Audio.

Suno se ha hecho muy conocido por generar canciones completas (voces, letras e instrumentación) a partir de un solo prompt de texto. Es lo suficientemente accesible para personas sin conocimientos musicales y genera resultados que, en algunos casos, son realmente difíciles de distinguir de las maquetas hechas por humanos. Sus resultados se inclinan hacia el pop estructurado y la música de género, y se ha convertido en un punto de entrada popular para los creadores que quieren pistas producidas completas rápidamente.

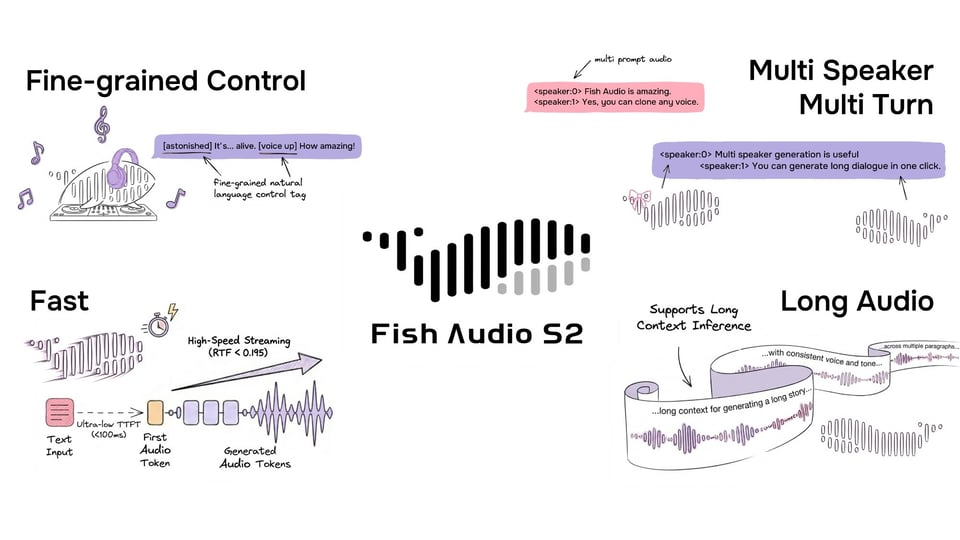

Fish Audio adopta un ángulo diferente. En su núcleo, es una plataforma construida en torno a la clonación de voz de alta calidad y la síntesis de texto a voz, pero se ha expandido a un territorio de generación de audio más amplio. Una de sus características destacadas es la capacidad de clonar una voz a partir de una pequeña muestra de audio y luego usar esa voz para generar nuevos discursos, narraciones o voces cantadas. Esto lo hace particularmente útil para los creadores que buscan coherencia en sus proyectos, como el presentador de un podcast que quiere una voz de IA que suene realmente como él, o un desarrollador que construye un asistente de voz con una personalidad específica.

Fish Audio también alberga un mercado de modelos de voz compartidos por la comunidad, lo que significa que puedes explorar voces creadas y subidas por otros usuarios y aplicarlas a tus propios proyectos. Se inclina más hacia los desarrolladores y creadores con inclinación técnica que hacia los usuarios ocasionales, siendo el acceso a la API una parte clave de su atractivo. Si estás construyendo un producto o flujo de trabajo que necesita generación de audio programática, Fish Audio te ofrece la infraestructura para conectarlo limpiamente.

Vale la pena explorar ambos dependiendo de lo que necesites. Suno es excelente para producir rápidamente música que suena terminada. Fish Audio es más adecuado para aquellos que quieren construir alrededor del proceso de generación o personalizarlo más profundamente.

Itera hasta conseguir un buen resultado

Algo que los nuevos usuarios a menudo no comprenden es que generar música con IA es un proceso iterativo, no algo que se logra al primer intento. Tu primer resultado probablemente no será perfecto, y eso está bien. Trata la primera generación como un borrador que te indica qué ajustar.

Si el estado de ánimo no es el adecuado, añade más descriptores emocionales. Si el tempo no se siente bien, describe la energía de manera diferente: "urgente y rápido" frente a "lento y deliberado" producirá resultados muy diferentes incluso dentro del mismo género. Si un instrumento está ahogando todo lo demás, indica explícitamente el equilibrio que buscas: "predominio del piano con cuerdas de acompañamiento sutiles".

Conclusión

Piensa en ello como trabajar con un músico de sesión que tiene una paciencia infinita y no tiene ego. Puedes pedir lo mismo de cinco maneras diferentes hasta que des exactamente con lo que estabas escuchando en tu cabeza.

La IA de texto a música no es solo una novedad; ya se está utilizando en flujos de trabajo reales y prácticos. Los creadores de YouTube están generando bandas sonoras personalizadas que coinciden con el tono emocional de cada segmento. Los podcasters están creando música de cabecera y ráfagas de transición sin contratar compositores. Los desarrolladores de juegos independientes están construyendo horas de música ambiental adaptativa que cambia según el juego.

En el lado empresarial, los equipos de marketing la están utilizando para maquetas rápidas de anuncios, presentaciones de marca y contenido social. Los terapeutas y desarrolladores de aplicaciones de bienestar están generando paisajes sonoros relajantes o que mejoran el enfoque. Incluso los educadores la están explorando para crear entornos de audio atractivos para cursos en línea.