Comment fonctionne la reconnaissance vocale ? – Le principe de fonctionnement de la conversion Speech-to-Text

28 févr. 2026

La plupart des gens pensent que la conversion de la parole en texte est une simple transformation : l'audio entre, et le texte sort, comme une recherche dans un dictionnaire à une vitesse de 150 mots par minute. En réalité, même une seule phrase parlée doit passer par 4 à 6 couches de traitement par réseaux de neurones. Chaque couche s'attaque à un défi distinct que les humains réalisent inconsciemment, mais que les machines interprètent encore mal dans environ 5 à 15 % des cas.

Selon l'AI Index annuel de Stanford, les taux d'erreur sont tombés de 43 % en 2013 à moins de 5 % pour un audio anglais clair en 2025. Néanmoins, ce chiffre global cache de fortes disparités. Remplacez un audio de studio propre par un enregistrement téléphonique dans un restaurant bondé, passez de l'anglais au thaï, ou introduisez un second locuteur, et les taux d'erreur peuvent rapidement remonter entre 15 et 30 %. Pour comprendre pourquoi, il faut regarder sous le capot comment la technologie fonctionne réellement.

La reconnaissance vocale en une phrase (et en profondeur)

En substance, la technologie speech-to-text (STT), également appelée reconnaissance automatique de la parole (ASR), convertit le langage parlé en texte écrit. C'est la définition en une phrase.

Explication approfondie : le système STT commence par capturer un signal audio analogique et le convertir en une représentation numérique ; par la suite, le système extrait des motifs qui correspondent aux sons de la parole, fait correspondre ces sons à des mots et des phrases probables, et applique un contexte linguistique pour déterminer la signification la plus probable de l'énoncé. Chaque étape implique des compromis entre vitesse, précision et coût de calcul. La différence entre la transcription en temps réel sur votre téléphone et le délai d'exécution de 24 heures d'un service de transcription médicale réside finalement dans les compromis pour lesquels chaque système a été conçu. En somme, la réponse pratique à la question « comment fonctionne la reconnaissance vocale » dépend fortement de l'environnement, de la variabilité du locuteur, de la qualité audio et du cas d'utilisation.

Le flux de travail en 5 étapes : ce qui se passe entre le son et le texte

Les systèmes de reconnaissance vocale modernes, qu'ils fonctionnent sur votre téléphone ou dans un centre de données cloud, suivent généralement cinq étapes clés. Chaque étape s'attaque à un défi technique spécifique.

Étape 1 : Le prétraitement audio

L'audio brut est désordonné. Avant que la reconnaissance ne commence, le système nettoie et standardise le signal.

- Réduction du bruit : le système isole le signal de parole du bruit de fond (comme le trafic, la musique ou les conversations croisées). Les systèmes modernes utilisent la séparation de sources basée sur des réseaux de neurones pour distinguer la voix d'un locuteur du son ambiant.

- Normalisation : Les niveaux de volume sont ajustés pour que les paroles calmes et fortes produisent une force de signal constante.

- Échantillonnage et fenêtrage : Le flux audio continu est divisé en courtes fenêtres (frames), généralement de 20 à 25 millisecondes chacune, avec un léger chevauchement. Chaque fenêtre est suffisamment brève pour que le signal audio qu'elle contient puisse être traité comme acoustiquement stable.

C'est à cette étape que la qualité audio détermine la précision finale. Un enregistrement de studio propre offre au système un excellent point de départ. Un appel téléphonique enregistré via un haut-parleur Bluetooth dans une voiture introduit un bruit que chaque étape suivante devra compenser.

Étape 2 : L'extraction de caractéristiques

Une fois nettoyées, les fenêtres audio doivent être converties de données de forme d'onde brute en un format qui capture les caractéristiques des sons de la parole. Le système ne traite pas directement l'onde sonore brute ; au lieu de cela, il extrait des caractéristiques — des représentations numériques de ce qui fait que chaque minuscule tranche d'audio sonne de telle ou telle manière.

Traditionnellement, les systèmes s'appuient sur les coefficients cepstraux sur l'échelle de Mel (MFCC), qui représentent l'audio d'une manière qui se rapproche de la perception humaine de la hauteur et du ton. Imaginez cela comme la transformation d'une photographie en un croquis qui conserve les contours essentiels tout en éliminant le bruit visuel.

Les systèmes plus récents, en particulier ceux basés sur le deep learning de bout en bout, contournent les caractéristiques conçues manuellement comme les MFCC et apprennent leurs propres représentations directement à partir de l'audio brut. Des modèles tels que Whisper d'OpenAI et wav2vec de Meta sont des exemples de cette approche. Ils ont montré qu'avec suffisamment de données d'entraînement, un réseau de neurones peut découvrir des représentations de caractéristiques plus performantes que celles conçues par l'homme.

Étape 3 : La modélisation acoustique

C'est ici que les caractéristiques audio sont associées aux sons de la parole. La question fondamentale à cette étape est : « Quels phonèmes (unités de base des sons) sont présents dans cette fenêtre audio ? »

L'anglais contient environ 44 phonèmes. Le mot « cat », par exemple, en comprend trois : /k/, /æ/, /t/. Le modèle acoustique évalue les caractéristiques extraites de chaque fenêtre et estime la distribution de probabilité sur tous les phonèmes possibles.

Deux architectures dominent cette étape :

Connectionist Temporal Classification (CTC) : Un réseau de neurones traite toute la séquence audio et produit des probabilités de phonèmes à chaque étape temporelle, sans nécessiter de données d'entraînement pré-alignées. Le CTC a été une avancée majeure car il a éliminé le besoin d'aligner manuellement l'audio avec les transcriptions pendant l'entraînement.

Encodeur-décodeur basé sur l'attention (Transformer) : Adaptée de l'architecture des grands modèles de langage comme GPT pour le traitement audio, cette approche utilise un encodeur pour traiter les caractéristiques audio et un décodeur pour générer un jeton de texte à la fois. Le mécanisme d'attention apprend quelles parties de l'audio correspondent à chaque jeton de sortie. Comparé au CTC, cette approche gère plus efficacement les dépendances à longue portée, produisant souvent des transcriptions plus naturelles pour la parole conversationnelle.

La plupart des systèmes de production en 2025-2026 adoptent des approches hybrides, combinant l'alignement CTC avec le décodage basé sur les Transformers pour équilibrer vitesse et précision.

Étape 4 : La modélisation du langage

La modélisation acoustique vous indique quels sons sont présents. La modélisation du langage détermine quels mots ces sons représentent le plus probablement en contexte.

Voici pourquoi cette étape est cruciale : considérez la séquence de phonèmes /r/ /aɪ/ /t/, qui pourrait correspondre à « right », « write » ou « rite ». Sans contexte linguistique, le système devine. Avec un modèle de langage qui sait que les mots précédents étaient « please write » (s'il vous plaît, écrivez), la probabilité de « write » devient quasi certaine.

Les systèmes STT modernes s'appuient généralement sur deux types de contexte linguistique :

- Modèles de langage statistiques : Prédisent un mot en fonction des 2 à 5 mots précédents. Ces modèles sont efficaces et légers mais limités dans leur portée contextuelle.

- Modèles de langage neuronaux : Traitent toute la phrase (ou le paragraphe) pour estimer les probabilités des mots. Ces modèles peuvent gérer des phrases ambiguës, des dépendances à longue distance et des structures de phrases complexes plus efficacement, mais à un coût de calcul nettement plus élevé.

Le vocabulaire spécifique au domaine joue également un rôle critique. Un modèle de langage généraliste transcrira « CRISPR-Cas9 » par des mots phonétiquement proches mais incorrects, alors qu'un modèle affiné sur des données biomédicales le reconnaîtra correctement. Cela explique pourquoi les services de transcription spécialisés dans les domaines médical, juridique et financier surpassent encore les outils généralistes en termes de terminologie technique.

Étape 5 : Le post-traitement et le formatage

Après les étapes 3 et 4, la sortie brute est un flux de mots en minuscules sans ponctuation, ni majuscules, ni sauts de paragraphe. Le post-traitement transforme cette sortie brute en texte utilisable.

- Insertion de la ponctuation : Un modèle distinct prédit où insérer les points, virgules et points d'interrogation en fonction d'indices acoustiques (comme les changements de hauteur et les pauses) et de motifs linguistiques.

- Capitalisation : Les noms propres, les débuts de phrases et les abréviations reçoivent une majuscule en fonction des règles de la langue et de la reconnaissance d'entités nommées.

- Formatage des nombres : « trois cent quarante-deux dollars et cinquante cents » devient « 342,50 $ ».

- Suppression des disfluences : Les tics de langage comme « euh » ou « hum », ainsi que les faux départs, peuvent être supprimés en option.

- Diarisation du locuteur (lorsqu'elle est activée) : elle détermine quels segments d'un enregistrement multi-locuteurs correspondent à chaque individu. C'est un modèle distinct qui analyse les caractéristiques vocales (hauteur, timbre, débit) pour regrouper les segments audio par identité de locuteur.

Le post-traitement détermine souvent si une transcription est simplement précise techniquement ou réellement exploitable. Une transcription précise à 95 % sans ponctuation est plus difficile à lire qu'une version précise à 92 % correctement formatée.

De 43 % d'erreur à 5 % : Les trois avancées qui ont tout changé

La recherche sur la reconnaissance vocale est en cours depuis les années 1950. Si vous vous demandez « comment la reconnaissance vocale peut-elle fonctionner assez bien pour alimenter les applications modernes », la réponse réside dans trois avancées majeures de la dernière décennie.

Avancée n°1 : Le deep learning a remplacé les modèles de Markov cachés (2012-2015). Pendant des décennies, les systèmes STT reposaient sur des modèles statistiques appelés HMM (modèles de Markov cachés) combinés à des modèles de mélanges gaussiens. Ces systèmes étaient complexes et plafonnaient à un taux d'erreur par mot d'environ 20-25 %. Lorsque les réseaux de neurones profonds ont remplacé les HMM, les taux d'erreur ont chuté de 30 % en peu de temps. C'est le tournant où des produits comme Siri et Google Voice sont passés du statut de « jouets amusants » à celui d'outils réellement utiles.

Avancée n°2 : Les modèles de bout en bout ont simplifié le système (2016-2020). Les systèmes STT traditionnels nécessitaient des modèles conçus et entraînés séparément pour l'extraction de caractéristiques, la modélisation acoustique et la modélisation du langage. Les systèmes de bout en bout (end-to-end), comme LAS (Listen, Attend and Spell) de Google et wav2vec de Meta, entraînent un réseau de neurones unique qui mappe directement l'audio au texte. Cela a réduit la complexité technique et permis au modèle d'optimiser l'ensemble du processus conjointement.

Avancée n°3 : Le pré-entraînement auto-supervisé sur des volumes massifs d'audio non étiquetés (2020-présent). La dernière percée est venue de l'entraînement de modèles sur des centaines de milliers d'heures d'audio sans dépendre de transcriptions humaines. Le modèle Whisper d'OpenAI, par exemple, a été entraîné sur 680 000 heures d'audio multilingue. Le modèle wav2vec 2.0 de Meta a démontré qu'un modèle pré-entraîné sur de la parole non étiquetée pouvait être affiné avec seulement 10 minutes de données étiquetées tout en surpassant des systèmes entraînés sur 100 fois plus de données. Cette approche explique pourquoi les systèmes STT modernes sont performants dans des dizaines de langues, y compris celles disposant de peu de données d'entraînement.

Pourquoi la précision varie-t-elle encore autant en pratique ?

Si la technologie est si avancée, pourquoi votre téléphone se trompe-t-il encore parfois ? Parce que le taux d'erreur de 5 % est mesuré dans des conditions idéales. Dans le monde réel, plusieurs variables amplifient les erreurs.

Variations d'accents et de dialectes. Les modèles STT sont entraînés principalement sur les dialectes standards des langues les plus parlées. Un accent américain standard enregistré dans une pièce calme peut donner une transcription quasi parfaite, tandis qu'un accent écossais prononcé ou un accent indien dans le même environnement peut faire grimper les erreurs à 10-15 %.

Dégradation de la qualité audio. Chaque couche de compression, le bruit de fond et la distance entre le locuteur et le micro introduisent des distorsions. Un enregistrement direct au micro à 44,1 kHz est fondamentalement différent d'un enregistrement par haut-parleur capturé à l'autre bout d'une table de conférence.

Chevauchement de la parole. Lorsque deux personnes parlent en même temps, la plupart des systèmes STT échouent à produire une sortie fiable. Les modèles de séparation des locuteurs s'améliorent, mais distinguer les voix reste un défi technique de taille.

Vocabulaire spécifique au domaine. Les modèles STT généraux ne reconnaissent pas automatiquement les noms de produits de votre entreprise ou les acronymes de votre secteur. Sans adaptation au domaine, les mots rares sont remplacés par des mots communs phonétiquement similaires.

6 applications réelles où le STT crée une valeur mesurable

La reconnaissance vocale n'est plus seulement une option pratique sur les téléphones. C'est devenue une infrastructure de base pour de nombreuses industries.

- Création de contenu et journalisme : Transcrire des interviews et des conférences de presse. Un journaliste peut économiser 3 à 4 heures de travail manuel en utilisant le STT.

- Accessibilité : Sous-titrage en temps réel pour les personnes sourdes ou malentendantes lors de réunions ou d'événements en direct.

- Documentation médicale : Les médecins dictent leurs notes directement dans les dossiers de santé électroniques, économisant en moyenne 2 heures par jour selon une étude de Stanford Medicine de 2023.

- Analytique du service client : Transcrire des millions d'appels pour identifier les tendances et les opportunités de formation.

- Transcription juridique : Procédures judiciaires et dépositions, où les seuils de précision sont extrêmement élevés.

- Éducation : Génération de transcriptions de cours et archives consultables pour les étudiants.

Comment le moteur STT de Fish Audio applique ces principes

Comment fonctionne la reconnaissance vocale ? Identifier la réponse en théorie est une chose, mais choisir un outil efficace en est une autre.

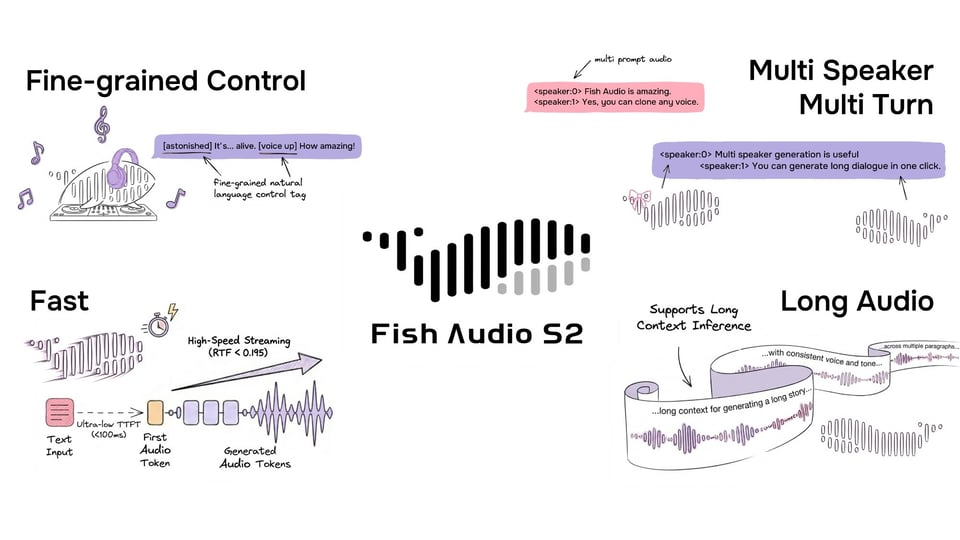

Le moteur Speech to Text de Fish Audio est construit sur la même génération de modèles décrits précédemment : des systèmes de deep learning de bout en bout avec pré-entraînement auto-supervisé. Voici comment ces fondements techniques se traduisent concrètement.

Traitement robuste au bruit. Les étapes de prétraitement et de modélisation acoustique sont entraînées sur des audios réels : enregistrements téléphoniques, réverbération de pièces, bruits de rue. Vous n'avez pas besoin de conditions d'enregistrement parfaites pour obtenir des résultats fiables.

Traitement robuste au bruit. Les étapes de prétraitement et de modélisation acoustique sont entraînées sur des audios réels : enregistrements téléphoniques, réverbération de pièces, bruits de rue. Vous n'avez pas besoin de conditions d'enregistrement parfaites pour obtenir des résultats fiables.

Anglais, mandarin, cantonais, japonais et coréen avec détection automatique de la langue. Le modèle de Fish Audio bénéficie de l'approche de pré-entraînement multilingue. Le système maintient une grande précision même pour les langues disposant de moins de données d'entraînement étiquetées que l'anglais.

Traitement par lots rapide. L'architecture fonctionne en parallèle sur les segments audio. Un enregistrement de 60 minutes peut être traité en moins de 2 minutes car le système traite tous les segments simultanément au lieu d'écouter en temps réel.

Accès développeur via API. Pour les équipes intégrant le STT dans leurs propres produits, l'API Fish Audio offre une latence de l'ordre de la milliseconde pour le streaming en temps réel et des points de terminaison par lots pour le traitement de fichiers.

La boucle audio complète

Le moteur STT de Fish Audio représente la moitié d'une plateforme vocale complète. L'autre moitié est le Text to Speech, proposant plus de 2 000 000 de voix, le clonage de voix en 15 secondes, et le support de plus de 13 langues. Ensemble, ils forment une boucle audio complète :

- Voix → Texte : Téléchargez un enregistrement et recevez une transcription (fish.audio/speech-to-text)

- Texte → Voix : Collez du texte, choisissez une voix et générez un audio prêt pour la production (fish.audio/text-to-speech)

Pour commencer

L'offre gratuite est suffisamment généreuse pour tester avec des enregistrements réels. Téléchargez un fichier, évaluez la qualité par vous-même et comparez avec votre solution actuelle. Les abonnements payants commencent à 11 $/mois. Les tarifs complets sont ici.

Et après : Où va le STT en 2026-2027

Trois tendances définiront la prochaine génération de technologie speech-to-text.

Transcription avec attribution du locuteur en temps réel. La diarisation sera traitée instantanément pendant les conversations en direct, avec une identification immédiate basée sur les profils vocaux.

Contexte multimodal. Les systèmes STT intégreront des signaux visuels. Si un intervenant présente des diapositives, le modèle utilisera le texte à l'écran pour améliorer la reconnaissance des termes techniques.

Adaptation personnalisée du vocabulaire. Les systèmes construiront des profils de vocabulaire individualisés s'adaptant aux termes spécifiques, contacts et noms de produits propres à chaque utilisateur.

Conclusion

La conversion de la parole en texte repose sur cinq couches d'apprentissage automatique superposées. Le prétraitement audio nettoie le signal. L'extraction de caractéristiques convertit le son en chiffres. La modélisation acoustique associe ces chiffres aux sons de la parole. La modélisation du langage transforme les sons en phrases probables. Le post-traitement affine le tout en texte lisible.

En une décennie, la technologie est passée d'un taux d'erreur de 43 % à moins de 5 %. Pour ceux qui ont besoin d'un STT performant dans des conditions réelles et sur plusieurs langues, Fish Audio propose cette technologie de pointe accessible via navigateur ou API.