2026年版:チャットボットと音声アシスタントに最適なテキスト読み上げ(TTS)API

2026年2月23日

音声アシスタントのデモ版は自然に聞こえます。新しいTTS APIを評価する際、毎回同じ10個のテストフレーズを実行すると、応答はクリアで、声は人間に非常に近く感じられます。しかし、実際にユーザーの前に出すと、3回目のやり取りで何かがおかしくなります。各応答の前のポーズは900msまで伸び、単独では表現力豊かだった声は、5回連続の回答では平坦に聞こえるようになります。ユーザーは音声との対話を楽しむのではなく、ただ耐えている状態になります。

チャットボットや音声アシスタント向けのTTS評価が系統的に楽観的になりがちなのは、これらの製品を破綻させる条件(実際のネットワーク負荷下での持続的なマルチターン対話)が、単発のリクエストによる品質テストよりもシミュレーションが難しいためです。

単発のデモでは測定できないこと

対話型AIにおいてTTS APIが実用的かどうかを決定する要因は3つありますが、そのどれもが10秒のクリップでは十分に表現されません。

負荷時のターン交代レイテンシ。 ユーザーの入力から音声応答までのポーズが400ms未満であれば、音声アシスタントはレスポンスが良いと感じられます。ほとんどのTTS APIは、負荷の軽いテスト環境ではそれを実現します。問題は、200人のユーザーが同時にアクティブな会話を行っているときに何が起こるかです。同時実行時のレイテンシのスパイクは、本番環境の音声アシスタント導入における最大の不満点です。

会話の応答に対する人間の知覚しきい値はおよそ400〜500msです。それを超えると、ユーザーは沈黙を言葉で埋めようとし始め、クロストーク(話し被り)が発生します。これはUXの好みではなく、生理的な限界です。ある中堅プラットフォームで50件の同時並行会話をシミュレートした負荷テストを行ったところ、TTFB(最初の1バイトまでの時間)は180msから2.8秒に跳ね上がりました。音声アシスタントは何の警告もなく「レスポンスが良い」状態から「壊れた」状態になり、ベンダーのドキュメントには、同時負荷下でレイテンシ特性がこれほど劇的に変化することは一切記載されていませんでした。

マルチターンにおける音声の一貫性。 一部のTTSモデルは、繰り返しの呼び出しに対して同じテキストでもわずかに異なる韻律(プロソディ)を生成します。単発のやり取りでは誰も気づきませんが、10ターンの会話になると、音声に微細な不整合が蓄積され、一貫したキャラクターではなく、システムが応答を生成しているように聞こえるようになります。

この問題は、制作チームの間で「ペルソナの崩壊」と呼ばれています。あるカスタマーサービス用チャットボットで人気のTTS APIをテストしていた際、この問題に直面しました。会話の6ターン目までに、もともと温かみのあるカスタマーサービスの声は、まるで起きたばかりのニュースキャスターのような声に変質していました。温かみは消え、ペースも乱れていました。テスト時に意図が感じられた声が、実際の使用では場当たり的に感じられたのです。最終的にFish Audioで特定のパラメータを調整することでマルチターンのドリフト問題を解決しましたが、そのために時間を費やす必要があるという事実は、どのドキュメントにも載っていませんでした。

応答タイプに応じた感情の幅。 対話型AIは、挨拶、説明、訂正、謝罪などを処理します。TTS音声は、単にニュートラルな文章を上手に読み上げるだけでなく、これらすべてにおいて適切にトーンを変える必要があります。

対話型AI向けTTS APIの比較

| プラットフォーム | TTFB | ストリーミング | マルチターンの一貫性 | 音声クローニング | 対応言語 | 同時接続セッション |

|---|---|---|---|---|---|---|

| Fish Audio | ミリ秒単位 | はい | 高 | はい(15秒のサンプル) | 30+ | 高 |

| ElevenLabs | 競争力あり | はい | 高 | はい | 30+ | 中 |

| Azure TTS | 中 | エンタープライズ階層 | 高 | 制限あり | 100+ | エンタープライズ |

| Google TTS | 中 | 制限あり | 高 | なし | 40+ | 高 |

| Amazon Polly | 中 | はい | 高 | なし | 20+ | 高 |

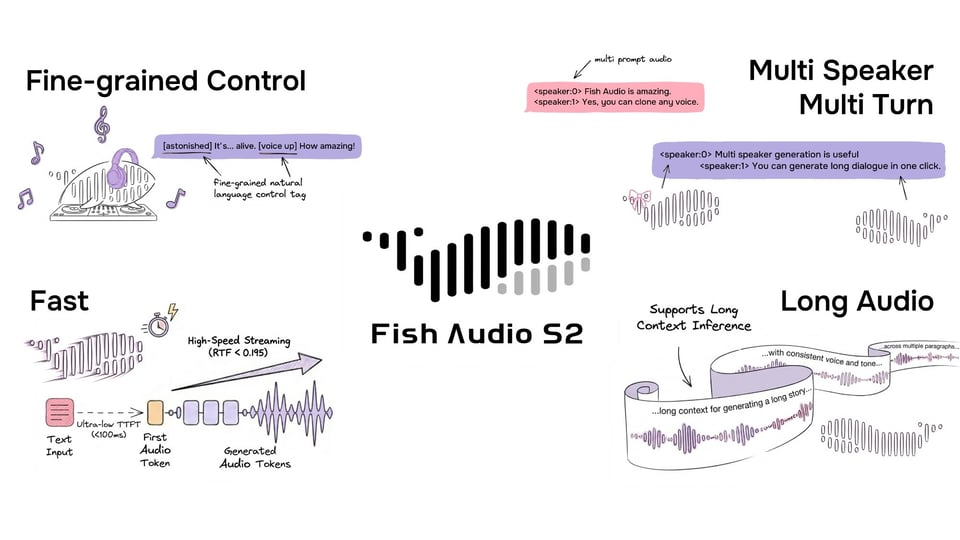

Fish Audio:マルチターン会話における低レイテンシと一貫性

音声アシスタントの品質を最も直接的に決定する2つの要件は、TTFBとストリーミング対応です。Fish Audioのミリ秒単位のTTFBとストリーミング配信の組み合わせにより、通常の接続環境では150〜200ms以内に音声が再生され始めます。これはターン交代が遅延を感じさせず、自然に感じられるしきい値内です。

ストリーミングは、コンテンツ制作向けのTTSよりも対話型AIにおいて重要な意味を持ちます。音声アシスタントにとって、応答の最初の数語は「はい、お手伝いできます」や「申し訳ありませんが、それはできかねます」のように、最も高い意味的重みを持ちます。ストリーミングを使用すれば、これらの最初の言葉は200ms未満で届きます。ユーザーは、全文が生成される前に応答の方向性を理解できます。これは、再生が始まる前に音声全体が完成するまで800ms待つのとは、質的に全く異なる体験です。

これを可能にするアーキテクチャは、LLM(大規模言語モデル)の出力ストリームをTTSの入力ストリームに直接接続することです。言語モデルが応答を完全に終えるのを待つのではなく、生成されたテキストのチャンクをFish Audioに流し込みます。LLMのストリーミングパイプラインとTTSのストリーミングパイプラインが並行して走り、全体のレイテンシは両方の合計ではなく、遅い方のステージのレイテンシに近いところまで縮小されます。これが、実際の本番環境でエンドツーエンドのレイテンシを500ms未満に抑える方法です。

開発者への注記: 長いLLMの応答を単一のTTSコールとして送信しないでください。自然な文の境界で分割し、短いTTSコールとして順番にストリーミングしてください。これにより、音声再生をより早く開始でき、ユーザーが話を遮る(現実の会話でよくあること)ための自然なポーズポイントを作ることができます。

高い同時実行性のサポートは、開発中に観察したレイテンシ特性をユーザーが実際に体験できることを意味します。Fish Audioを使用してエンドツーエンドで500ms未満のレイテンシを達成したチャットボットの実績は、最適化されたベンチマーク環境ではなく、現実世界の条件を反映したものです。

音声クローニングは、ブランドアシスタントや製品ペルソナにおいて特に重要な次元を加えます。汎用的な声のカタログから選択する代わりに、製品アイデンティティと一致する特定の音声キャラクターを作成できます。15秒のサンプル要件により、プロのレコーディングセッションを必要とせずにこれを実用化できます。クローンされた音声はサポートされている30以上の言語すべてで機能するため、一度キャラクターボイスを作成すれば、録り直しなしで国際展開が可能です。

Fish Audioの音声カタログは膨大で、200万以上のコミュニティ音声があり、クローニングしたくない場合でも即座に選択肢が見つかります。ただし、カタログには特定の音声プロファイルに偏りがある点に注意が必要です。非常に特殊な地域の方言や、極めて独特なキャラクターボイスが必要な場合は、カタログから探すよりもクローニングする方が早い場合があり、その分セットアップの手順が増えることになります。これは致命的な問題ではありませんが、開始前に想定しておくべき現実的な点です。

APIドキュメントは docs.fish.audio で確認できます。

ElevenLabs:英語音声アシスタントにおける品質の優位性

率直に言って、英語で没入感のあるコンパニオンAIを構築しており、音声そのものが製品である場合、ElevenLabsの感情の幅は依然としてベンチマークです。ElevenLabsと他の多くのプラットフォームにおける、英語のためらい、強調、感情的なニュアンスの処理の違いは、はっきりと聞き取れるレベルです。それはわずかな差ではありません。音声キャラクターがユーザー体験の核となる製品(コンパニオンアプリ、読み聞かせアシスタント、セラピーに近いツールなど)にとって、ElevenLabsの英語出力の品質はトレードオフを正当化するものです。

そのトレードオフは現実的です。階層別の料金モデルは、繁忙期に高いプランへの移行を余儀なくされ、利用が急増する製品では請求額が予測しにくくなります。ストリーミングは標準的な条件下では良好に動作しますが、大規模な同時実行においてはFish Audioが構造的な優位性を持っています。英語のみを扱い、会話ボリュームが予測可能な音声アシスタントであれば、純粋な出力品質においてElevenLabsは最強の選択肢です。多言語対応や高い同時実行性が必要な場合、その評価は変わります。

Azure TTS:エンタープライズ導入への道

Azure Neural TTSの品質は、対話型アプリケーションでも競争できるレベルに達しています。信頼性とエンタープライズSLAにより、すでにAzureインフラを使用している組織にとってはデフォルトの選択肢となります。

ストリーミングは利用可能ですが、通常はエンタープライズ階層へのアクセスが必要です。音声クローニングの設定は複雑で、コンテンツクリエイターや小規模な開発チームが必要とするような迅速な音声作成には向いていません。ユースケースがエンタープライズIVRシステムや、安定した定義済みの音声要件を持つ大規模なカスタマーサービスボットであれば、Azureはうまく機能します。より実験的な対話型AI開発の場合、設定のオーバーヘッドが反復のスピードを落とす可能性があります。

会話の質を向上させる音声デザインパターン

プラットフォームの選択は一つの手段に過ぎません。音声インタラクションをどのように構成するかも重要です。

最初の応答からストリーミングを使用する。 すべての音声データが利用可能になるのを待たないでください。最初のチャンクの再生を開始し、残りをバッファリングします。会話らしさは、音声全体の速さではなく、最初の音が出る速さから生まれます。

ユースケースのトーンに合わせて音声を選択する。 コンパニオンAIの声とカスタマーサービスボットの声は、異なる響きであるべきです。感情プロファイルは重要です。コンパニオンアプリには温かみのある声を、情報伝達にはより落ち着いた声を、消費者向けアプリにはより明るい声を選びましょう。

個々の応答を短く保つ。 音声単位あたりのTTSの品質は、短く完結したフレーズで最も高くなります。長い応答は、韻律の不整合が生じる可能性を高めます。LLMが4文の回答を生成した場合、それを4つの別々のTTSコールとしてストリーミングし、順番に再生する方が、1つのコールで4文を入力するよりも音声品質が向上するかどうかを検討してください。

静的な応答を事前生成する。 挨拶、確認、つなぎの言葉(「ただいまお調べします」など)は毎回同じように生成されます。これらを一度事前生成してキャッシュから提供すれば、最も頻繁に使用される発話におけるAPIレイテンシを完全に排除できます。

開発者への注記: 音声アシスタントには割り込み処理が必要です。TTSの再生中にユーザーが話し始めたら、音声はきれいに停止しなければなりません。実際のユーザーでテストする前にこれを実装してください。割り込みのUXこそが、音声アシスタントが自然に感じられるかどうかの最大の分岐点です。

チャットボットのタイプ別プラットフォーム適合表

コンパニオンAIおよびソーシャルボット: 他のどの変数よりも、感情の幅と音声の自然さが重要です。Fish Audio または ElevenLabs が適しています。多言語サポートやカスタムキャラクターボイスが必要な場合は、Fish Audio の優位性が増します。

カスタマーサービスボット: 多言語サポートと信頼性が最も重要です。Fish Audio は単一のAPIで30以上の言語を一貫した品質で処理します。アクセスが集中するカスタマーサービスアプリケーションでは、高い同時実行性能も重要です。

IVRおよび電話システム: レイテンシ要件はWebやアプリの音声アシスタントよりも多少寛容です。発音やペースを制御するためのSSMLコントロールがより重要になります。Azure や Amazon Polly は、特に電話チャネルに適しています。

情報アシスタント(FAQボット、ナレッジボット): 音声は権威があり、クリアである必要があります。主要なプラットフォームが提供するニュートラルで落ち着いた声ならどれでも機能します。この場合、レイテンシとコストが主な差別化要因となります。

よくある質問

音声チャットボットを自然に感じさせるために必要なTTSレイテンシはどのくらいですか? TTFB(最初の音声までの時間)が400ms以下であれば、自然な会話のターン交代を維持できます。200ms以下であれば即座に反応していると感じられます。600msを超えると、ボットが話し終える前にユーザーが話し始めたり、不快な沈黙が生じたりします。Fish Audioのミリ秒単位のTTFBは、応答を自然な範囲内に保ちます。

音声アシスタント用にカスタムブランド音声を作成できますか? はい。Fish Audioの音声クローニングは、15秒の録音からブランド音声を作成し、その音声ですべてのTTS出力を生成します。クローンされた音声は30以上の言語で機能するため、単一のブランド音声で国際展開が可能です。

ストリーミングTTSは対話型AIのパイプラインで動作しますか? はい、それが推奨されるアーキテクチャです。Fish Audioのストリーミングを使用すると、残りの音声が生成されている間に応答の開始部分を聞くことができます。LLMからのストリーミングテキスト生成と組み合わせることで、ユーザーの入力から音声応答までのエンドツーエンドのレイテンシを500ms未満に抑えることができます。

長い会話(10ターン以上)でTTSの品質はどうなりますか? ターンをまたいだ音声の一貫性は、会話の長さではなくTTSモデルによって決まります。Fish Audioのモデルは、繰り返しの呼び出しでも一貫した韻律を生成するため、一部のプラットフォームで見られるようなマルチターンセッション中の音声の変質を防ぎます。

カスタマーサービス用チャットボットに音声クローニングを使用する価値はありますか? 一貫した企業アイデンティティが重要なブランドチャットボットであれば、その価値はあります。ブランドのコミュニケーションスタイルに合わせたクローン音声は、汎用的なカタログから選ぶよりも効果的です。Fish Audioの最低15秒のサンプル要件により、プロのレコーディング予算なしでこれを実現できます。

複数の同時チャットボット会話を最も適切に処理できるTTS APIはどれですか? Fish Audioの高い同時実行サポートは、まさにこのために設計されています。レイテンシ特性は同時負荷下でも安定しています。AzureやGoogleも高い同時実行性をうまく処理しますが、品質や機能面で異なるトレードオフがあります。

結論

対話型AIにおいて、TTS APIの選択は2つの問いに集約されます。ターン交代が自然に感じられるほど速く音声を届けられるか、そして何百もの会話が同時に行われているときにそのパフォーマンスを維持できるかです。

Fish Audioのミリ秒単位のTTFB、ストリーミング対応、高い同時実行性、そして音声クローニングは、対話型AIの導入において最も完成度の高い選択肢となります。音声そのものが製品の一部である英語メインのユースケースでは ElevenLabs を、既存のエコシステムによってアーキテクチャが定義されているエンタープライズ導入では Azure や Google を検討してください。

導入を決定する前に、同時負荷下でテストを行ってください。ユーザー1人の時のパフォーマンスは、500人の時の挙動を予測しません。APIドキュメントと統合の詳細は docs.fish.audio を参照してください。