CapCutでテキスト読み上げ(TTS)機能を活用して、より高品質なナレーションを作成する方法

2026年3月5日

CapCutのテキスト読み上げツールに200語のスクリプトを入力し、生成ボタンを押したところ、ファストフードのドライブスルーで道案内をするGPSのような声が流れてきた……そんな経験はありませんか?テンポは崩れ、トーンは単調で、「自然な」音声オプションを選んだはずなのに、AI特有の違和感が拭えません。

CapCutの内蔵TTSは、素早いドラフト作成には便利です。しかし、10秒以上にわたって視聴者の注意を引きつけたい場合には、すぐに限界に突き当たります。幸いなことに、CapCutの編集能力と、より優れた音声エンジンを組み合わせる非常にシンプルなワークフローが存在します。

CapCutの内蔵TTSの仕組み

CapCutには、エディター内で直接利用できる無料のテキスト読み上げ機能が含まれています。スクリプトを入力または貼り付けて音声を選択すると、アプリがタイムラインに同期したオーディオトラックを生成します。

30秒未満の短尺コンテンツであれば、この機能は非常に便利です。アプリを離れる必要がなく、オーディオが直接タイムラインに配置されるからです。CapCutは複数の言語で数十種類の音声オプションを提供しており、速度の基本的なコントロールも可能です。

しかし、便利さはそこまでです。

専用のTTSプラットフォームと比較すると、音声の選択肢は限られています。感情の幅も狭く、同じ音声で、ある文章は興奮気味に、次の文章は真剣にといった使い分けはできません。長尺のスクリプトでは、最初の数行を過ぎるとリズムが崩れ、単調になりがちです。また、複数の言語で作業する場合、英語や中国語以外では品質が著しく低下します。

毎日ショート動画を投稿するクリエイターやカジュアルなコンテンツであれば、その妥協も許容範囲かもしれません。しかし、コンテンツを通じてブランドを構築しようとしている人にとって、音声はブランドの一部です。汎用的なTTS音声は、ブランドの価値を下げてしまう可能性があります。

CapCutでテキスト読み上げを使用する方法

モバイル版とデスクトップ版のそれぞれにおける、CapCutネイティブTTSの使い方を紹介します。

モバイル版 (iOS / Android)

CapCutでプロジェクトを開き、下のツールバーにある 「テキスト」 をタップします。スクリプトを入力または貼り付け、「テキスト読み上げ」 をタップします。利用可能な音声を確認し、いくつかプレビューして選択します。必要に応じて速度スライダーを調整し、チェックマークをタップして生成します。

オーディオクリップがタイムライン上のテキストレイヤーにリンクして表示されます。他のオーディオクリップと同様に、トリミング、位置変更、分割が可能です。

デスクトップ版 (PC / Web)

プロジェクトを開き、左パネルの 「テキスト」 をクリックしてテキストボックスを追加します。スクリプトを入力し、テキストレイヤーを右クリックして 「テキスト読み上げ」 を選択します。音声を選び、速度を設定して生成します。

デスクトップ版はトリミングや複数のオーディオトラックの重ね合わせが少しやりやすいですが、音声ライブラリ自体は同じです。

確認すべき重要な設定

最も影響が大きいのは「速度」の設定です。CapCutのデフォルト設定では、チュートリアルやナレーションとしては急ぎすぎていると感じることがよくあります。0.8倍または0.9倍に遅くすると改善されることがありますが、時折不自然な音の伸びが発生します。

ピッチの調整や強調の設定、文の間隔を長くするような指示はできません。プレビューで聞こえる音が、そのままの出力結果となります。

CapCut内蔵テキスト読み上げの主な制限事項

多くのクリエイターが同じパターンに陥ります。最初は無料で内蔵されているため、CapCutのTTSを使い始めます。最初の動画は許容範囲に思えます。しかし10本目の動画を作る頃には、すべてのナレーションが同じリズム、同じ平坦な喋り、同じロボットのような響きであることに気づきます。

視聴者の反応もそれを裏付けます。「どんなTTSを使っていますか?」や「声が気になって集中できない」といったコメントが届き始めます。視聴維持率のデータはさらに如実です。単調なナレーションの動画は、変化に富んだ表現力豊かなナレーションの動画に比べ、最初の5秒間の離脱率が大幅に高くなる傾向があります。

根本的な問題は、CapCutのTTSが劣っていることではなく、それがビデオエディター内の「便利な付帯機能」として設計されており、独立した音声制作ツールではない点にあります。専用プラットフォームが投資しているようなモデルの深み、音声の多様性、きめ細かなコントロールは備わっていないのです。

より良いナレーションのための代替ワークフロー

解決策はシンプルです。専用のTTSプラットフォームでナレーション音声を生成し、それをCapCutにインポートして編集することです。

動画1本あたり約60秒の手間が増えるだけで、品質には劇的な差が生まれます。CapCutの編集ツール、タイムライン、エフェクト、書き出しオプションはそのまま使いつつ、最も弱いリンクである「音声」だけを入れ替えるのです。

ワークフローは以下の通りです:

- 任意のテキストエディタでスクリプトを書く。

- 専用のTTSツールを使用してナレーションを生成する(詳細は後述)。

- オーディオファイル(MP3またはWAV)をダウンロードする。

- CapCutにオーディオをインポートし、タイムラインに配置する。

- 通常通り編集、トリミング、同期を行う。

変わるのは音声の「調達先」だけです。それ以外のCapCutの作業フローは一切変わりません。

Fish Audioでナレーションを生成しCapCutにインポートする方法

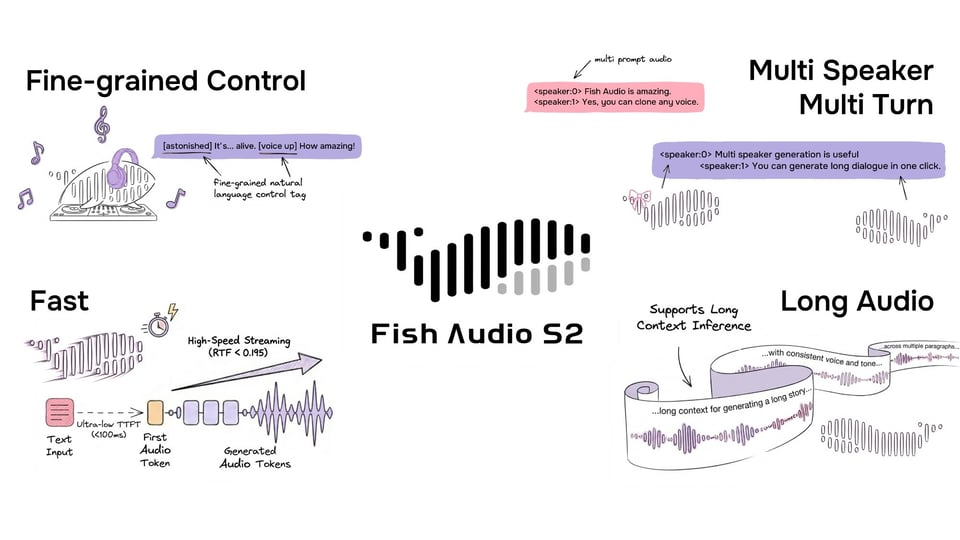

Fish Audio は、30以上の言語で20万種類以上の音声を提供するTTSプラットフォームです。合成音声ではなく、人間のように聞こえる声を必要とするコンテンツクリエイターや開発者のために特別に構築されています。

Fish Audio は、30以上の言語で20万種類以上の音声を提供するTTSプラットフォームです。合成音声ではなく、人間のように聞こえる声を必要とするコンテンツクリエイターや開発者のために特別に構築されています。

CapCutと組み合わせて使用する方法は以下の通りです:

ステップ1:Fish Audioのテキスト読み上げツールを開く

fish.audio/text-to-speech にアクセスします。アカウントを作成しなくても、音声をプレビューすることができます。

ステップ2:音声を選ぶ(または自分の声をクローンする)

言語、性別、スタイルから音声ライブラリを検索します。自分のテキストを使って、納得いくまでプレビューできます。

さらに、自分だけのユニークな声が欲しい場合は、Fish Audioの 音声クローン 機能を使って、わずか15秒の音声サンプルからカスタムボイスを作成できます。数行の文章を読み上げた音声を録音してアップロードするだけで、あなたそっくりの音声モデルが生成されます。これは、毎回録音する手間を省きつつ、ブランドの一貫性を保ちたいクリエイターに最適です。

ステップ3:スクリプトを貼り付けて生成する

テキストボックスにスクリプト全体を貼り付けます。Fish Audioは長尺のスクリプトでも数秒で処理します。CapCutの内蔵TTSにはない、感情のトーン、テンポ、強調の調整が可能です。

多言語コンテンツの場合、Fish Audioはコードスイッチング(言語の混在)を非常にうまく処理します。英語とスペイン語、あるいは英語と日本語が混ざったスクリプトでも、スクリプトを分割することなく、言語の境界をまたいで自然な発音を維持します。

ステップ4:ダウンロードしてCapCutにインポートする

生成されたオーディオをMP3またはWAV形式でダウンロードします。CapCutプロジェクトを開き、「オーディオ」 > 「インポート」 をタップ(またはクリック)して、ファイルをタイムラインにドラッグ&ドロップします。あとは通常通り、トリミング、音量調整、エフェクト追加を行うだけです。

プロセス全体で増える時間はわずか1分程度ですが、出力される品質の向上はそれ以上の価値をコンテンツにもたらします。

CapCut内蔵テキスト読み上げ vs. 外部TTSツール

| 機能 | CapCut内蔵TTS | Fish Audio |

|---|---|---|

| 対応言語 | 約10 | 13 |

| 音声クローン | なし | あり(15秒のサンプル) |

| 感情表現の制御 | なし | あり |

| テンポ・強調の制御 | 速度スライダーのみ | 細かな調整が可能 |

| 長尺の安定性 | 約30秒後に劣化 | スクリプト全体で安定 |

| APIアクセス | なし | あり (docs.fish.audio) |

最大の差は、単一の機能ではなく「最初の30秒の後に何が起こるか」にあります。CapCutのTTSは短尺では健闘しますが、長くなると自然さが失われます。Fish Audioのようなプラットフォームは、スクリプト全体を通して一貫したトーンとリズムを維持します。これは15秒以上の動画を作る際には極めて重要です。

避けるべきテキスト読み上げのよくある間違い

優れた音声エンジンを使っても、悪い習慣がナレーションを台無しにすることがあります。

「読み手」ではなく「聞き手」のために書く。 書き言葉は話し言葉よりも長く複雑になりがちです。紙の上では良く見えても、読み上げた時に息苦しく感じる場合は、長い文章を短く区切りましょう。生成する前に、自分で一度声に出して読んでみてください。

セクション間の間を無視する。 最初から最後まで一定のスピードで流れるナレーションは、音声の質に関係なくロボットのように聞こえます。セクションの間に自然な「間」を入れましょう。Fish Audioを含む多くのTTSツールでは、ポーズ(一時停止)マーカーを挿入したり、セグメントごとにペースを調整したりできます。

何でもデフォルトの音声を使う。 視聴者はコンテンツの「声」に対して期待を抱きます。動画ごとに声を変えたり、他の何千人ものクリエイターと同じ汎用的な声を使ったりすると、ブランドの認知度が弱まります。一つの声を選ぶ(または自分の声をクローンする)ことで、一貫性を保ちましょう。

結論

CapCutの内蔵TTSが適している場面もいくつかあります。本制作の前にテストするクイックドラフト、音声の質が差別化要因にならないカジュアルなコンテンツ、あるいはどうしてもワークフローにあと60秒もかけられない場合などです。

それ以外のすべてのケースでは、外部でナレーションを生成してCapCutにインポートする方が賢明な選択です。編集作業の快適さは変わらず、音声のクオリティだけが格段に向上します。多言語展開を考えていたり、独自のボイスアイデンティティを築こうとしているなら、内蔵TTSと Fish Audio のような専用プラットフォームとの差は、時間が経つほどに広がっていくでしょう。