As 5 Melhores APIs de Clonagem de Voz em Tempo Real para 2026

20 de dez. de 2025

A geração de voz em tempo real é um componente crucial para muitas aplicações criadas em 2026, desde chatbots conversacionais até companheiros de IA ou agentes de suporte ao cliente. Quando a fala é gerada ao vivo, em vez de ser gerada e entregue de forma assíncrona, surgem novos fatores a considerar para a qualidade da API de geração de fala. A latência torna-se importante, enquanto cada falha torna-se imediatamente óbvia e audível para o ouvinte. Atrasos parecem estranhos e uma entrega monótona soa falsa. Uma voz que oscila ou apresenta falhas quebra a confiança imediatamente. Isso é especialmente verdadeiro para agentes de IA, NPCs ao vivo, assistentes de voz, bots de suporte ao cliente e qualquer coisa que responda enquanto um humano está esperando.

Em 2026, a clonagem de voz em tempo real é um recurso robusto que pode proporcionar realismo e engajamento para muitos desenvolvedores. As equipes esperam baixa latência, identidade de voz estável e controle suficiente para fazer a fala parecer intencional. As APIs abaixo são as que oferecem a melhor experiência para seus usuários quando implementadas em um ambiente de produção.

O Que Importa para a Clonagem de Voz em Tempo Real

A voz em tempo real tem requisitos mais rigorosos do que o text-to-speech em lote:

Latência. Qualquer coisa acima de uma pequena pausa parece antinatural na conversa.

Estabilidade da voz. A voz clonada deve permanecer reconhecível em diferentes emoções e comprimentos de frase.

Controle de streaming. Você precisa de saídas parciais, interrupções e transições suaves, não apenas arquivos de áudio completos.

Escalabilidade. Sistemas em tempo real têm picos. As APIs precisam ser confiáveis quando o tráfego aumenta.

Se você está criando agentes ao vivo, NPCs conversacionais ou sistemas baseados em chamadas, esses fatores importam mais do que o polimento bruto do áudio.

Melhores APIs de Clonagem de Voz em Tempo Real (2026)

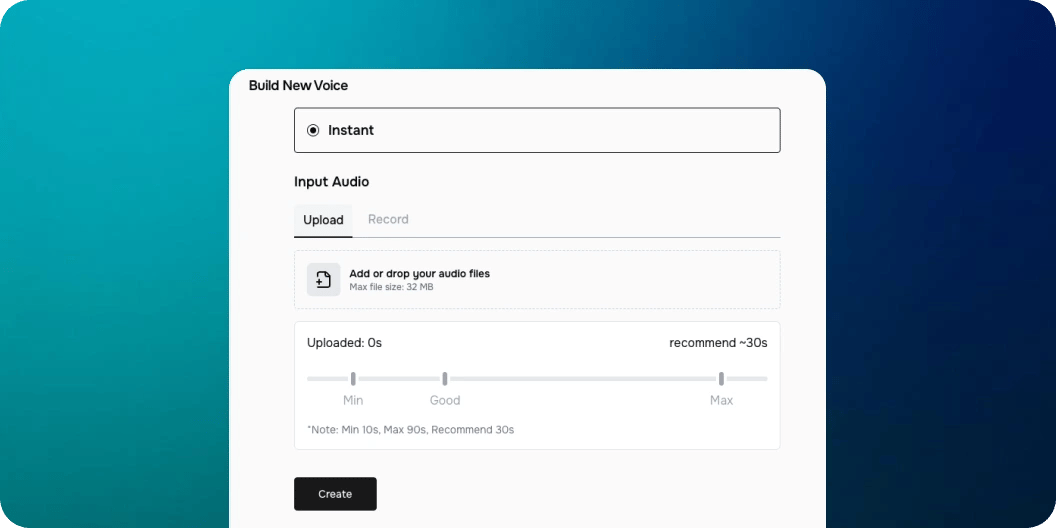

1. Fish Audio

Fish Audio é a API de clonagem de voz em tempo real mais poderosa disponível no momento. Ela combina streaming de baixa latência com uma entrega expressiva que não falha sob condições ao vivo. A clonagem de voz funciona a partir de amostras curtas e permanece consistente mesmo quando as emoções mudam no meio da conversa.

- Casos de uso: agentes de IA, NPCs ao vivo, companheiros de voz, aplicativos em tempo real

- Ponto forte: realismo expressivo com identidade de voz estável

- API: streaming em tempo real, geração em lote, SDKs

Fish Audio suporta controle de emoção no momento da geração, o que permite que os desenvolvedores moldem o tom em vez de fixar tudo em prompts estáticos. A latência de <500ms é perfeita para conversas que pareçam naturais. Isso o torna viável não apenas para demonstrações, mas para sistemas de produção com os quais os usuários interagem diariamente.

2. ElevenLabs

ElevenLabs oferece recursos em tempo real junto com suas ferramentas de geração em lote.

- Casos de uso: narração ao vivo, agentes conversacionais

- Ponto forte: saída limpa e uma ampla biblioteca de vozes

- Notas: o direcionamento emocional é mais limitado e os custos aumentam rapidamente em escala

Funciona bem para diálogos previsíveis, mas menos quando a fala precisa reagir dinamicamente ao comportamento do usuário.

3. Cartesia

Cartesia foi construída especificamente com fala de baixa latência em mente.

- Casos de uso: agentes de resposta rápida, sistemas interativos

- Ponto forte: latência muito baixa

- Notas: a profundidade emocional é mais limitada que no Fish Audio

Se a velocidade é sua prioridade máxima e o tom é secundário, Cartesia é fácil de integrar em pipelines ao vivo.

4. Hume

Hume enfatiza a modulação emocional em vez da estabilidade bruta.

- Casos de uso: agentes conversacionais expressivos, interfaces experimentais

- Ponto forte: forte variação emocional

- Notas: menos consistente em longas sessões ao vivo e pode alucinar o fraseado

Pode adicionar textura a interações curtas, mas precisa de proteções cuidadosas em produção.

5. Speechify

Speechify suporta casos de uso em tempo real em uma capacidade limitada.

- Casos de uso: leituras simples ao vivo, ferramentas de acessibilidade

- Ponto forte: fala clara e previsível

- Notas: controle mínimo para sistemas conversacionais ao vivo

É mais adequado para cenários de leitura em voz alta do que para agentes conversacionais completos.

Dicas Práticas para Sistemas de Voz em Tempo Real

Algumas lições que surgem rapidamente em implantações ao vivo:

- Teste a latência de ponta a ponta. Rede, modelo e reprodução, tudo se acumula.

- Limite os extremos emocionais. Exagerar no direcionamento da emoção causa instabilidade na fala ao vivo.

- Projete o tratamento de interrupções. Os usuários falam por cima dos agentes. Seu sistema de voz deve saber lidar com isso.

- Monitore o desvio (drift). Verifique a identidade da voz em sessões longas e regenere a fala quando necessário.

Fish Audio apresenta um bom desempenho nessas condições porque seu pipeline em tempo real foi projetado para uso contínuo, em vez de clipes isolados.

Considerações Finais

A clonagem de voz em tempo real possui requisitos adicionais além das plataformas básicas de TTS com IA. Sistemas que soam bem de forma assíncrona podem sofrer em desempenho quando a fala precisa responder instantaneamente e de forma consistente. É por isso que o design da API, o comportamento de streaming e o controle emocional importam mais do que uma demonstração chamativa.

Em 2026, Fish Audio se destaca como a solução de clonagem de voz em tempo real mais equilibrada. Oferece fala expressiva e estável sem forçar os desenvolvedores a trocar o realismo pela velocidade.

Se o seu produto depende de conversação ao vivo, esse equilíbrio é a diferença entre algo que as pessoas testam uma vez e algo que elas realmente usam.