2026 音频分离全指南与评测

2026年1月29日

音频分离已从一项小众的技术专长演变为现代创意工作流中的重要环节。在 2026 年,AI 音频分离不再是一项实验性技术,它已成为音乐人、制作人、DJ、播客主和各类创作者广泛使用的工具。无论你是想分离人声和乐器,还是进行精确的音乐轨道分离以制作混音,或者是清理嘈杂音轨中的对话,音频源分离工具都比以往任何时候更快速、更智能、更易于使用。

这份《2026 音频分离全指南与评测》将带你了解音频分轨 (demixing) 的工作原理、其在当今的重要性、最热门的应用场景、当前的局限性以及该技术的未来走向。如果你想利用 AI 准确地分离音乐音频,这份全面的指南提供你所需的一切。

什么是音频分离(以及它为什么重要)?

音频分离,也称为音频源分离或音频分轨,是将混合后的音频文件(如立体声歌曲)并隔离其各个组成部分的过程:

- 人声

- 鼓

- 贝斯

- 吉他

- 钢琴

- 合成器

- 对话或演讲

- 音效

传统上,一旦乐器和人声被“固定”在立体声文件中,再次将它们分离几乎是不可能的。工程师必须依靠均衡器 (EQ) 技巧、相位技巧或重新录制部分音轨,这些方法既耗时又不完美。相比之下,AI 音频分离现在使用深度学习以惊人的准确度识别并提取单个声音元素。

AI 音频分离的工作原理

当今的音频源分离系统建立在深度神经网络之上,这些网络能够学习声音在时间、频率和动态方面的表现。

驱动音频分轨的核心技术

- Spectrogram Analysis(频谱图分析):将音频转换为频率-时间可视化图像,帮助 AI 区分乐器和人声。

- Neural Networks & Transformers:这些架构能够识别重叠声音之间的细微差别,从而可靠地分离人声和乐器。

- Masking Techniques(掩蔽技术):AI 创建“掩蔽”来隔离选定的声音,同时抑制其他声音。

- Contextual Learning(上下文学习):现代模型能够理解音乐语境——例如,即使在密集的混音中,也能知道人声或吉他音色应该是怎样的。

得益于这些进步,执行音乐轨道分离的工具现在比以往任何时候都更快、更干净、更符合录音室标准。

为什么音频分离在 2026 年如此重要

AI 音频分离的兴起并非偶然。多种趋势共同作用,使这项技术变得至关重要:

1. 创作者经济

来自 TikTok 或 YouTube 等平台的创作者需要纯净的音频。能够分离音乐音频意味着可以去除人声制作伴奏、隔离音乐用于教育内容,或增强视频中的对话。

2. 音乐制作与混音文化

制作人和 DJ 使用音频源分离来:

- 制作混音 (Remixes)

- 提取人声干声 (Acapellas)

- 重新加工旧的 Demo

- 从隔离的分轨 (Stems) 中构建新的节奏

3. 音乐教育与学习

音乐人使用分离人声和乐器的工具来:

- 配合伴奏进行练习

- 分析编曲

- 学习特定部分

4. 修复与存档

档案保管员和音频工程师使用音频分轨来修复旧录音、隔离演讲,或清理混合素材以便保存或重新发行。

5. 媒体制作

电影、电视和播客制作人现在在没有原始多轨素材的情况下,依靠 AI 音频分离来从背景声中隔离对话。

2026 年音频分离工具的类型

并非所有的分离工具都相同。最常见的类别包括:

✔ 人声与乐器分离

最简单且最广泛的音频源分离形式,让你可以隔离或静音人声,同时保留音乐。

✔ Stem 分离

更高级的工具将轨道分解为多个分轨 (Stems),例如:

- 人声

- 鼓

- 贝斯

- 其他乐器

这种类型的音乐轨道分离对于专业的混音和制作工作流至关重要。

✔ 对话与背景分离

广泛用于电影和播客编辑,以从音乐和音效中隔离语音。

✔ 特定流派模型

一些 AI 模型针对流行、嘻哈、摇滚或古典等特定流派进行了优化,提高了这些风格的分离准确度。

音频分离的最佳应用场景

🎧 音乐制作

制作人使用音频分轨来提取人声、重构节奏,并创建现有曲目的全新版本。

🎛 DJ 与现场演出

DJs 依靠音乐轨道分离来隔离人声进行现场混音 (Mashups)、创建纯乐器段落或构建自定义过渡。

📱 内容创作

创作者可以:

- 去除受版权保护的人声

- 隔离背景音乐

- 提高视频中的对话清晰度

📚 音乐教育

教师和学生使用分离的人声和乐器来放慢音轨、专注于特定部分并分析技巧。

🔊 无障碍与广播

隔离的语音音轨为听障听众提供更清晰的音频,并为广播提供更干净的后期混音对话。

优势与局限性

✔ 优势

- 极快的周转和处理速度

- 更干净的人声和乐器提取

- 更好地处理重叠频率

- 对初学者友好的界面

✖ 局限性

- 在极度密集的混音中会出现人工痕迹 (Artifacts)

- 混响和音效可能会模糊音源

- 复杂的管弦乐或多层录音对分离模型仍具挑战

尽管存在挑战,2026 年的音频源分离工具比早期的替代方案明显更加强大和可靠。

音频分离工作流(2026 年用户友好型)

典型的现代工作流可能如下所示:

- 上传音频文件

- 选择分离类型(人声/乐器、分轨、对话)

- 让 AI 处理音频

- 预览分离后的音轨

- 导出分轨 (Stems) 用于混音或编辑

这种简化的体验使得分离音乐音频的操作即使对于初学者来说也变得简单。

音频分离的未来 - Fish Audio

展望未来,AI 音频分离的前景包括:

- 现场直播和演出期间的实时分离

- 针对特定声音或乐器调整的个性化 AI 模型

- 集成视频和元数据以提高准确性的多模态系统

- 针对版权和知情同意的伦理保障

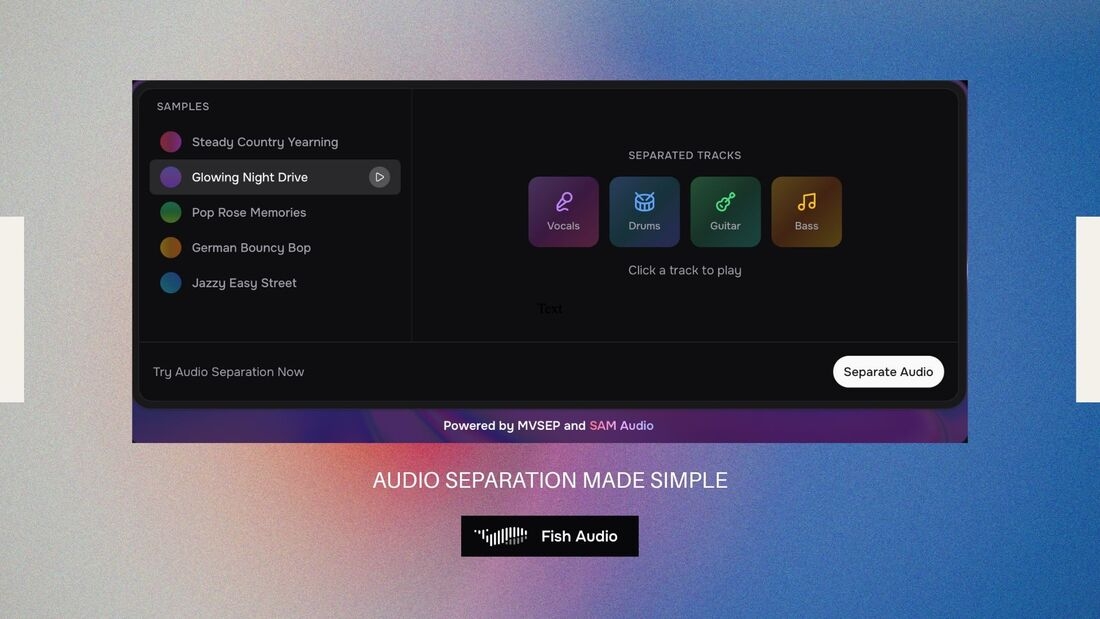

Fish Audio 拥有目前最易用的音频分离工具之一

像 Fish Audio 这样的音频分离工具和 AI 音频分轨正迅速成为每位声音专业人士工具箱中的标准配置。

最终评测:2026 年的音频分离

无论你是制作混音的制作人、清理对话的播客主、准备演出的 DJ,还是向学生展示歌曲构成的老师,分离人声和乐器、执行精确的音乐轨道分离以及利用智能音频源分离工作流的能力,都重塑了我们与声音互动的方式。

从主流工具到前沿研究(如学习自海量音频数据集的 AI 模型),音频分轨现在是任何音频工作者的基本技能……而这仅仅是个开始。

Kyle is a Founding Engineer at Fish Audio and UC Berkeley Computer Scientist and Physicist. He builds scalable voice systems and grew Fish into the #1 global AI text-to-speech platform. Outside of startups, he has climbed 1345 trees so far around the Bay Area. Find his irresistibly clouty thoughts on X at @kile_sway.

阅读Kyle Cui的更多内容 >