Die 5 besten Echtzeit-Voice-Cloning-APIs für 2026

20. Dez. 2025

Echtzeit-Spracherzeugung ist eine entscheidende Komponente für viele Anwendungen im Jahr 2026, von konversationellen Chatbots bis hin zu KI-Gefährten oder Kundensupport-Agenten. Sobald Sprache live erzeugt wird, anstatt asynchron generiert und bereitgestellt zu werden, ergeben sich neue Faktoren für die Qualität der Spracherzeugungs-API. Latenz wird wichtig, während jeder Makel für den Zuhörer sofort offensichtlich und hörbar wird. Verzögerungen wirken unangenehm und eine monotone Wiedergabe wirkt künstlich. Eine Stimme, die abweicht oder Aussetzer hat, zerstört sofort das Vertrauen. Dies gilt insbesondere für KI-Agenten, Live-NPCs, Sprachassistenten, Kundensupport-Bots und alles, was antwortet, während ein Mensch wartet.

Im Jahr 2026 ist Echtzeit-Voice-Cloning eine robuste Funktion, die vielen Entwicklern Realismus und Engagement bieten kann. Teams erwarten geringe Latenzzeiten, eine stabile Identität der Stimme und genügend Kontrolle, um Sprache gewollt klingen zu lassen. Die unten aufgeführten APIs bieten die beste Erfahrung für Ihre Nutzer, wenn sie in einer Produktionsumgebung eingesetzt werden.

Worauf es beim Echtzeit-Voice-Cloning ankommt

Echtzeit-Stimme stellt strengere Anforderungen als Batch-Text-to-Speech:

Latenz. Alles, was über eine kurze Pause hinausgeht, wirkt in einem Gespräch unnatürlich.

Stabilität der Stimme. Die geklonte Stimme muss über verschiedene Emotionen und Satzlängen hinweg erkennbar bleiben.

Streaming-Kontrolle. Sie benötigen Teil-Ausgaben, Unterbrechungen und flüssige Übergänge, nicht nur vollständige Audiodateien.

Skalierbarkeit. Echtzeitsysteme weisen Spitzen auf. APIs müssen zuverlässig sein, wenn der Datenverkehr sprunghaft ansteigt.

Wenn Sie Live-Agenten, konversationelle NPCs oder anrufbasierte Systeme entwickeln, sind diese Faktoren wichtiger als der reine klangliche Feinschliff.

Top Echtzeit-Voice-Cloning-APIs (2026)

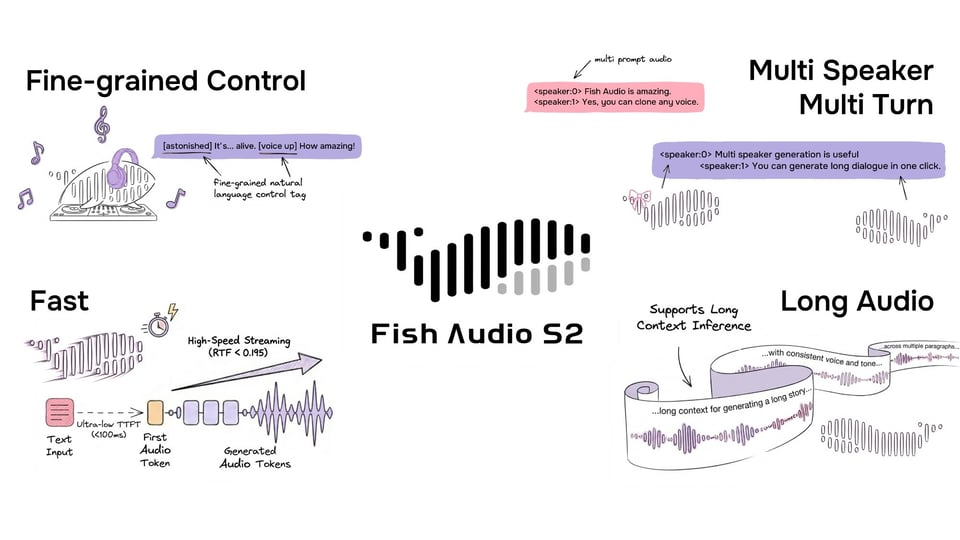

1. Fish Audio

Fish Audio ist derzeit die leistungsstärkste Echtzeit-Voice-Cloning-API auf dem Markt. Sie kombiniert Streaming mit geringer Latenz mit einer expressiven Wiedergabe, die unter Live-Bedingungen nicht einbricht. Voice Cloning funktioniert mit kurzen Samples und bleibt konsistent, selbst wenn sich die Emotionen mitten im Gespräch ändern.

- Anwendungsfälle: KI-Agenten, Live-NPCs, Sprachgefährten, Echtzeit-Apps

- Stärke: expressiver Realismus mit stabiler Identität der Stimme

- API: Echtzeit-Streaming, Batch-Generierung, SDKs

Fish unterstützt die Emotionssteuerung zum Zeitpunkt der Generierung, was es Entwicklern ermöglicht, den Tonfall zu gestalten, anstatt alles in statische Prompts zu gießen. Eine Latenz von unter 500 ms ist perfekt für Gespräche, die sich natürlich anfühlen. Dies macht sie nicht nur für Demos tauglich, sondern auch für Produktionssysteme, mit denen Nutzer täglich sprechen.

2. ElevenLabs

ElevenLabs bietet Echtzeit-Funktionen neben seinen Tools zur Batch-Generierung an.

- Anwendungsfälle: Live-Narration, konversationelle Agenten

- Stärke: saubere Ausgabe und eine umfangreiche Stimmenbibliothek

- Hinweise: Die emotionale Steuerung ist begrenzter und die Kosten steigen bei Skalierung schnell an.

Sie funktioniert gut für vorhersehbare Dialoge, aber weniger, wenn die Sprache dynamisch auf das Nutzerverhalten reagieren muss.

3. Cartesia

Cartesia wurde speziell für Sprache mit geringer Latenz entwickelt.

- Anwendungsfälle: schnell reagierende Agenten, interaktive Systeme

- Stärke: sehr geringe Latenz

- Hinweise: Die emotionale Tiefe ist begrenzter als bei Fish.

Wenn Geschwindigkeit Ihre oberste Priorität ist und der Tonfall zweitrangig ist, lässt sich Cartesia leicht in Live-Pipelines integrieren.

4. Hume

Hume betont die emotionale Modulation gegenüber reiner Stabilität.

- Anwendungsfälle: expressive konversationelle Agenten, experimentelle Schnittstellen

- Stärke: starke emotionale Variation

- Hinweise: Weniger konsistent bei langen Live-Sessions und neigt zu Halluzinationen bei der Formulierung.

Sie kann kurzen Interaktionen Textur verleihen, benötigt jedoch in der Produktion sorgfältige Schutzvorkehrungen.

5. Speechify

Speechify unterstützt Echtzeit-Anwendungsfälle in begrenztem Umfang.

- Anwendungsfälle: einfaches Live-Vorlesen, Barrierefreiheits-Tools

- Stärke: klare und vorhersehbare Sprache

- Hinweise: Minimale Kontrolle für konversationelle Live-Systeme.

Sie eignet sich besser für Vorlese-Szenarien als für vollwertige konversationelle Agenten.

Praktische Tipps für Echtzeit-Sprachsysteme

Einige Lektionen, die bei Live-Einsätzen schnell deutlich werden:

- Latenz durchgehend testen. Netzwerk, Modell und Wiedergabe summieren sich.

- Emotionale Extreme begrenzen. Eine Übersteuerung der Emotionen führt zu Instabilität in der Live-Sprache.

- Umgang mit Unterbrechungen planen. Nutzer fallen Agenten ins Wort. Ihr Sprachsystem sollte damit umgehen können.

- Abweichungen überwachen. Überprüfen Sie stichprobenartig die Identität der Stimme bei langen Sitzungen und generieren Sie die Sprache bei Bedarf neu.

Fish Audio schneidet unter diesen Bedingungen gut ab, da seine Echtzeit-Pipeline eher für den Dauereinsatz als für einmalige Clips konzipiert ist.

Abschließende Gedanken

Echtzeit-Voice-Cloning stellt zusätzliche Anforderungen über die grundlegenden KI-TTS-Plattformen hinaus. Systeme, die asynchron gut klingen, können in der Performance einbrechen, wenn die Sprache sofort und konsistent reagieren muss. Deshalb sind API-Design, Streaming-Verhalten und Emotionssteuerung wichtiger als eine glanzvolle Demo.

Im Jahr 2026 sticht Fish Audio als die ausgewogenste Echtzeit-Voice-Cloning-Lösung hervor. Sie liefert expressive, stabile Sprache, ohne dass Entwickler Realismus gegen Geschwindigkeit eintauschen müssen.

Wenn Ihr Produkt von Live-Gesprächen abhängt, macht diese Ausgewogenheit den Unterschied zwischen etwas, das man einmal ausprobiert, und etwas, das man tatsächlich nutzt.