Fish Audio veröffentlicht S2 als Open-Source: Fein abgestimmte Steuerung trifft auf produktionsreifes Streaming

S2 Pro ist in der Fish Audio App verfügbar und der Open-Source-Code ist über das GitHub-Repository des Projekts sowie auf HuggingFace zugänglich.

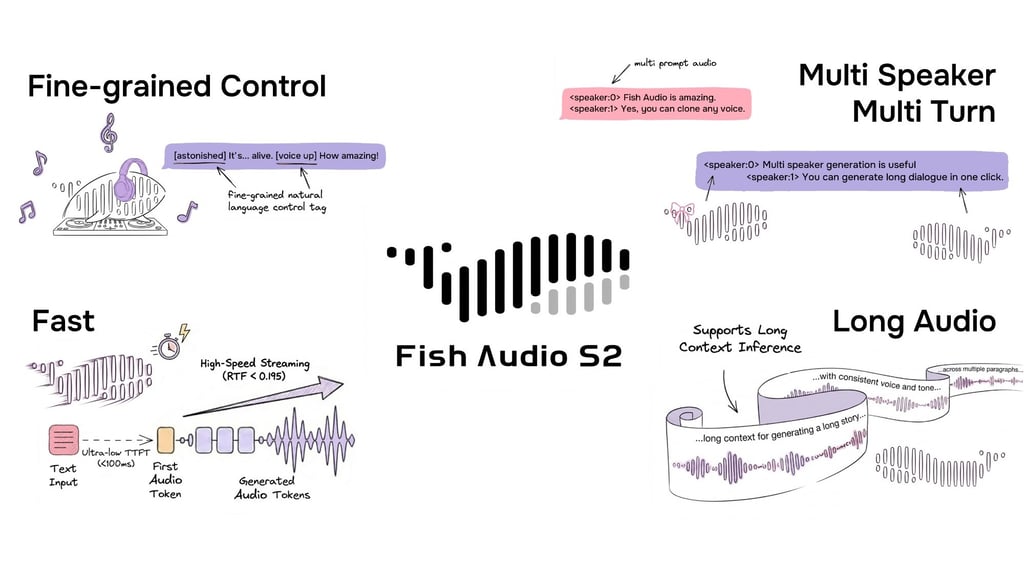

Fish Audio hat S2 als Open-Source veröffentlicht, ein Text-to-Speech-Modell, das eine feingranulare Inline-Steuerung von Prosodie und Emotionen mithilfe natürlichsprachlicher Tags wie [laugh], [whispers] und [super happy] unterstützt. Das System wurde mit über 10 Millionen Stunden Audiomaterial in etwa 50 Sprachen trainiert und kombiniert Reinforcement Learning Alignment mit einer dual-autoregressiven Architektur. Die Veröffentlichung umfasst Modellgewichte, Code für das Fine-Tuning und eine auf SGLang basierende Streaming-Inferenz-Engine.

Feingranulare Inline-Steuerung mittels natürlicher Sprache

S2 ermöglicht die Inline-Steuerung der Sprachsynthese, indem natürlichsprachliche Anweisungen direkt an spezifischen Wort- oder Phrasenpositionen im Text eingebettet werden. Anstatt auf einen festen Satz vordefinierter Tags angewiesen zu sein, akzeptiert S2 freiformulierte Textbeschreibungen – wie [whisper in small voice], [professional broadcast tone] oder [pitch up] – was eine ergebnisoffene Ausdruckskontrolle auf Wortebene ermöglicht.

Im Audio-Turing-Test erreicht S2 einen Posterior-Mittelwert von 0,515 mit Instruction Rewriting, verglichen mit 0,417 für Seed-TTS und 0,387 für MiniMax-Speech. Auf EmergentTTS-Eval erzielt es eine Gesamt-Win-Rate von 81,88 % gegenüber einer gpt-4o-mini-tts Baseline – der höchste Wert unter allen evaluierten Modellen, einschließlich Closed-Source-Systemen von Google und OpenAI.

Beispiel für das S2-Eingabeformat, das einen Dialog mit mehreren Sprechern und natürlichsprachlichen Inline-Tags zur feingranularen Steuerung zeigt.

Beispiel für das S2-Eingabeformat, das einen Dialog mit mehreren Sprechern und natürlichsprachlichen Inline-Tags zur feingranularen Steuerung zeigt.

Ein einheitliches Rezept: Datenkuratierung und RL-Rewards aus denselben Modellen

Eine zentrale architektonische Entscheidung bei S2 ist, dass dieselben Modelle, die zum Filtern und Annotieren der Trainingsdaten verwendet werden, direkt als Belohnungsmodelle (Reward Models) während des Reinforcement Learning wiederverwendet werden:

- Sprachqualitätsmodell: Bewertet Audio während der Datenfilterung nach Dimensionen wie SNR, Sprecherkonsistenz und Verständlichkeit – und dient dann als akustischer Präferenz-Reward während des RL.

- Rich-Transcription ASR-Modell: (fortlaufend vortrainiert auf Basis von Qwen3-Omni-30B-A3B) generiert während der Datenkuratierung Transkripte mit Caption-Erweiterungen und paralinguistischen Inline-Annotationen – und liefert dann den Reward für Verständlichkeit und Anweisungsbefolgung, indem es generiertes Audio erneut transkribiert und mit dem ursprünglichen Prompt vergleicht.

Dieses Design für zwei Zwecke eliminiert konstruktionsbedingt die Verteilungsdiskrepanz (Distribution Mismatch) zwischen Pre-training-Daten und Post-training-Zielen – ein Problem, das in anderen TTS-Systemen, die Reward-Modelle separat von ihren Daten-Pipelines trainieren, ungelöst bleibt.

Einblick in das Modell: Dual-AR-Architektur

S2 basiert auf einem Decoder-only Transformer in Kombination mit einem RVQ-basierten Audio-Codec (10 Codebooks, ~21 Hz Framerate). Das einfache Aneinanderreihen aller Codebooks entlang der Zeitachse würde zu einer zehnfachen Explosion der Sequenzlänge führen. S2 löst dies mit einer Dual-Autoregressiven (Dual-AR) Architektur:

- Slow AR: Operiert entlang der Zeitachse und sagt das primäre semantische Codebook voraus.

- Fast AR: Generiert an jedem Zeitschritt die verbleibenden 9 Residual-Codebooks und rekonstruiert so feingranulare akustische Details.

Dieses asymmetrische Design – 4 Mrd. Parameter entlang der Zeitachse, 400 Mio. Parameter entlang der Tiefenachse – hält die Inferenz effizient und bewahrt gleichzeitig die Audioqualität.

Reinforcement Learning Alignment für Sprache

Für das Post-training nutzt S2 Group Relative Policy Optimization (GRPO), um den Speicher-Overhead von Value-Modellen im PPO-Stil bei langen Audio-Kontexten zu vermeiden. Das Belohnungssignal kombiniert mehrere Dimensionen, darunter:

- Semantische Genauigkeit und Befolgung von Anweisungen

- Akustische Präferenzbewertung

- Timbre-Ähnlichkeit

Benchmark-Ergebnisse

S2 erzielt führende Ergebnisse in mehreren öffentlichen Benchmarks:

| Benchmark | Fish Audio S2 |

|---|---|

| Seed-TTS Eval — WER (Chinesisch) | 0,54% (bestes Gesamtergebnis) |

| Seed-TTS Eval — WER (Englisch) | 0,99% (bestes Gesamtergebnis) |

| Audio Turing Test (mit Anweisung) | 0,515 Posterior-Mittelwert |

| EmergentTTS-Eval — Win-Rate | 81,88% (höchstes Gesamtergebnis) |

| Fish Instruction Benchmark — TAR | 93,3% |

| Fish Instruction Benchmark — Qualität | 4,51 / 5,0 |

| Multilingual (MiniMax Testset) — Bester WER | 11 von 24 Sprachen |

| Multilingual (MiniMax Testset) — Beste SIM | 17 von 24 Sprachen |

Bei Seed-TTS Eval erreicht S2 die niedrigste WER unter allen evaluierten Modellen, einschließlich Closed-Source-Systemen: Qwen3-TTS (0,77/1,24), MiniMax Speech-02 (0,99/1,90), Seed-TTS (1,12/2.25). Im Audio-Turing-Test übertrifft der Wert 0,515 Seed-TTS (0,417) um 24 % und MiniMax-Speech (0,387) um 33 %. Bei EmergentTTS-Eval erzielt S2 besonders starke Ergebnisse in den Bereichen Paralinguistik (91,61 % Win-Rate), Fragen (84,41 %) und syntaktische Komplexität (83,39 %).

Für einen umfassenderen Blick darauf, wie verschiedene Lösungen in Bezug auf Emotionskontrolle, Latenz und mehrsprachige Unterstützung abschneiden, können Sie diesen unabhängigen Vergleich von KI-Voice- und Audio-Tools heranziehen.

Produktionsreifes Streaming via SGLang

Da die Dual-AR-Architektur von S2 strukturell isomorph zu Standard-autoregressiven LLMs ist, kann sie alle LLM-nativen Serving-Optimierungen von SGLang mit minimalen Änderungen übernehmen – einschließlich Continuous Batching, Paged KV Cache, CUDA Graph Replay und RadixAttention-basiertem Prefix Caching.

Für das Voice Cloning platziert S2 Referenz-Audio-Tokens im System-Prompt. RadixAttention von SGLang cached diese KV-Zustände automatisch und erreicht eine durchschnittliche Prefix-Cache-Hit-Rate von 86,4 % (über 90 % in der Spitze), wenn dieselbe Stimme über mehrere Anfragen hinweg wiederverwendet wird – wodurch der Prefill-Overhead für Referenz-Audio fast vernachlässigbar wird.

Auf einer einzelnen NVIDIA H200 GPU:

- Real-Time Factor (RTF): 0,195

- Time-to-first-audio: ca. 100 ms

- Durchsatz: über 3.000 akustische Tokens/s bei einem RTF unter 0,5

Warum diese Veröffentlichung wichtig ist

S2 wird nicht nur als Modell-Checkpoint veröffentlicht, sondern als komplettes System: Modellgewichte, Fine-Tuning-Code und ein produktionsreifer Inferenz-Stack.

Zwei Design-Entscheidungen stechen hervor. Erstens eliminiert die vereinheitlichte Daten-und-Reward-Pipeline ein strukturelles Problem – die Verteilungsdiskrepanz zwischen Pre-training und RL –, das andere TTS-Systeme auf architektonischer Ebene bisher nicht angegangen sind. Zweitens bedeutet die strukturelle Isomorphie zwischen der Dual-AR-Architektur und Standard-LLMs, dass S2 das gesamte Ökosystem der LLM-Serving-Optimierungen nutzen kann, anstatt eine maßgeschneiderte Inferenz-Infrastruktur zu benötigen.

S2 ist über das GitHub-Repository des Projekts, SGLang-Omni, HuggingFace und als interaktive Demo auf fish.audio verfügbar.