Melhor API de Text to Speech para Chatbots e Assistentes de Voz em 2026

23 de fev. de 2026

A versão demo do seu assistente de voz soa natural. Você executa as mesmas 10 frases de teste toda vez que avalia uma nova API de TTS, as respostas voltam limpas e a voz parece humana. Então, você a coloca diante de usuários reais. Na terceira troca de mensagens, algo está errado. A pausa antes de cada resposta aumentou para 900ms. A voz que parecia expressiva isoladamente agora soa monótona na quinta resposta consecutiva. Os usuários estão tolerando a voz em vez de conversar com ela.

A avaliação de TTS para chatbots e assistentes de voz é sistematicamente otimista porque as condições que quebram esses produtos — interação contínua de múltiplos turnos sob carga real de rede — são mais difíceis de simular do que um teste de qualidade de solicitação única.

O Que as Demos de Turno Único Não Medem

Existem três coisas que determinam se uma API de TTS funciona para IA conversacional, e nenhuma delas é bem representada em um clipe de 10 segundos:

Latência de alternância de turnos sob carga. Um assistente de voz parece responsivo quando a pausa entre a entrada do usuário e a resposta de voz é inferior a 400ms. A maioria das APIs de TTS entrega isso em um ambiente de teste com pouca carga. A questão é o que acontece quando 200 usuários estão simultaneamente em conversas ativas. Picos de latência em concorrência são a principal reclamação em implantações de assistentes de voz em produção.

O limiar de percepção humana para resposta conversacional é de aproximadamente 400-500ms. Passado isso, os usuários começam a preencher o silêncio com fala, criando sobreposição (crosstalk). Isso não é uma preferência de UX — é um limite fisiológico. Quando executamos um teste de carga com 50 conversas simultâneas simuladas em uma plataforma de nível médio, o TTFB saltou de 180ms para 2,8 segundos. O assistente de voz passou de responsivo para quebrado sem aviso, e nada na documentação do fornecedor mencionava que o perfil de latência mudaria tão drasticamente sob carga simultânea.

Consistência de voz em múltiplos turnos. Alguns modelos de TTS produzem prosódia ligeiramente diferente para o mesmo texto em chamadas repetidas. Em uma interação de turno único, ninguém percebe. Em uma conversa de 10 turnos, a voz acumula inconsistências sutis que a fazem parecer menos com um personagem consistente e mais como um sistema gerando respostas.

Esse problema tem um nome nas equipes de produção: colapso de persona. Encontramos isso ao testar uma API de TTS popular para um chatbot de atendimento ao cliente. No 6º turno da conversa, a voz originalmente calorosa do atendimento ao cliente tinha derivado para algo que parecia um apresentador de telejornal que acabou de acordar. O calor havia sumido. O ritmo estava errado. A voz que parecia intencional nos testes parecia arbitrária no uso. Eventualmente, resolvemos o problema de deriva em múltiplos turnos na Fish Audio ajustando parâmetros específicos — mas o fato de termos tido que gastar tempo com isso não estava em nenhuma documentação.

Alcance emocional em diferentes tipos de resposta. Uma IA conversacional lida com saudações, explicações, correções e desculpas. A voz de TTS precisa modular adequadamente em todos eles, não apenas soar bem lendo uma declaração neutra.

Comparação de APIs de TTS para IA Conversacional

| Plataforma | TTFB | Streaming | Consistência Multi-turnos | Clonagem de Voz | Idiomas | Sessões Simultâneas |

|---|---|---|---|---|---|---|

| Fish Audio | Nível de milissegundos | Sim | Alta | Sim (amostra de 15 seg) | 30+ | Alta |

| ElevenLabs | Competitivo | Sim | Alta | Sim | 30+ | Moderada |

| Azure TTS | Moderado | Nível empresarial | Alta | Limitada | 100+ | Empresarial |

| Google TTS | Moderado | Limitado | Alta | Não | 40+ | Alta |

| Amazon Polly | Moderado | Sim | Alta | Não | 20+ | Alta |

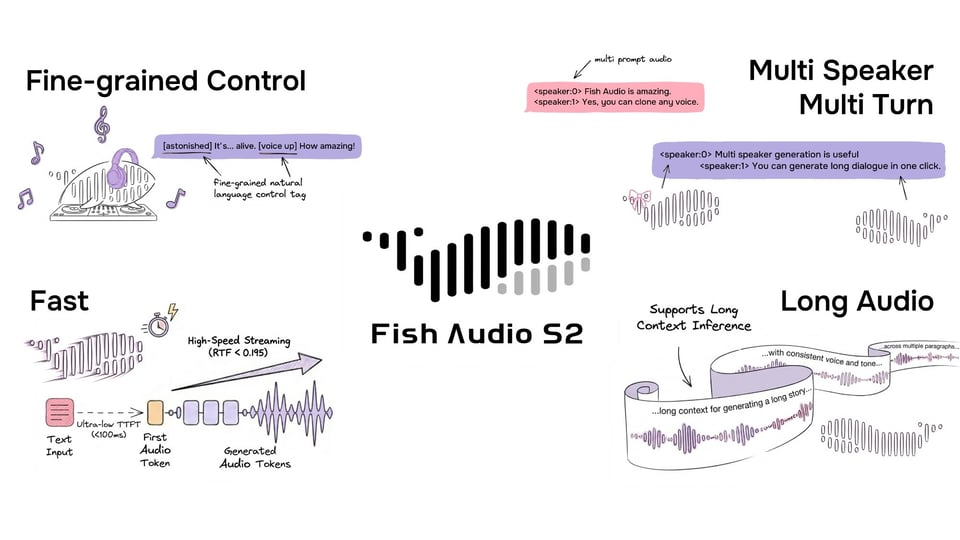

Fish Audio: Latência e Consistência para Conversas de Múltiplos Turnos

Os dois requisitos que determinam mais diretamente a qualidade do assistente de voz são o TTFB e o suporte a streaming. O tempo para o primeiro byte em nível de milissegundos da Fish Audio, combinado com a entrega via streaming, significa que os usuários ouvem a voz começando dentro de 150-200ms em uma conexão normal. Isso está dentro do limite onde a alternância de turnos parece natural em vez de atrasada.

O streaming importa de forma diferente para a IA conversacional do que para o TTS de conteúdo. Para um assistente de voz, as primeiras palavras de uma resposta carregam o maior peso semântico: "Sim, posso ajudar com isso" vs "Sinto muito, isso não é algo que eu possa fazer". Com o streaming, essas primeiras palavras chegam em menos de 200ms. O usuário entende a direção da resposta antes que a frase completa tenha sido gerada. Isso é qualitativamente diferente de esperar 800ms para que o áudio completo esteja pronto antes que qualquer parte dele seja reproduzida.

A arquitetura que faz isso funcionar é conectar o fluxo de saída do LLM diretamente ao fluxo de entrada do TTS. Em vez de esperar que o modelo de linguagem termine sua resposta completa, você alimenta blocos de texto na Fish Audio conforme eles são gerados. O pipeline de streaming do LLM e o pipeline de streaming do TTS funcionam em paralelo, e a latência total encolhe para perto da latência de qualquer estágio que seja mais lento — não a soma de ambos. É assim que você obtém latência de ponta a ponta inferior a 500ms em uma implantação conversacional real.

Nota do Desenvolvedor: Não envie respostas longas de LLM como uma única chamada de TTS. Divida-as em limites de frases naturais e transmita-as como chamadas de TTS mais curtas em sequência. Isso permite que você comece a reproduzir o áudio mais cedo e dá aos usuários um ponto de pausa natural para interromper — que é o que acontece em conversas reais.

O suporte a alta concorrência significa que o perfil de latência que você observa durante o desenvolvimento é o que os usuários realmente experimentam. O caso documentado de um chatbot conversacional alcançando latência de ponta a ponta inferior a 500ms com a Fish Audio reflete condições do mundo real, não um ambiente de benchmark otimizado.

A clonagem de voz adiciona uma dimensão que importa especificamente para assistentes de marca e personas de produtos. Em vez de selecionar em um catálogo de vozes genéricas, você pode criar um personagem de voz específico que seja consistente com a identidade do seu produto. O requisito de amostra de 15 segundos torna isso prático sem exigir sessões de gravação profissional. A voz clonada funciona em todos os mais de 30 idiomas suportados, portanto, uma única voz de personagem escala para implantações internacionais sem regravação.

O catálogo de vozes da Fish Audio é grande — mais de 2.000.000 de vozes da comunidade — e oferece opções imediatas se você não quiser clonar. Mas vale a pena notar que o catálogo tende a certos perfis vocais. Se você precisar de um sotaque regional muito específico ou de uma voz de personagem altamente distinta, pode ser necessário clonar uma em vez de encontrá-la no catálogo, o que adiciona uma etapa ao processo de configuração. Isso não é um impedimento, mas é uma expectativa realista a ser definida antes de começar.

Documentação da API em docs.fish.audio.

ElevenLabs: O Caso da Qualidade para Assistentes de Voz em Inglês

Francamente, se você está construindo uma IA de companhia imersiva em inglês e a própria voz é o produto, o alcance emocional da ElevenLabs ainda é a referência. A diferença entre como a ElevenLabs e a maioria das outras plataformas lidam com hesitação, ênfase e subtexto emocional em inglês é audível. Não é marginal. Para um produto onde o personagem de voz é central para a experiência do usuário — um aplicativo de companhia, um assistente de narrativa, uma ferramenta de apoio terapêutico — a qualidade da saída em inglês da ElevenLabs justifica as compensações.

Essas compensações são reais. O modelo de precificação por níveis significa que períodos de pico levam você para planos mais caros e, para produtos com uso instável, o faturamento torna-se imprevisível. O streaming funciona bem em condições padrão, mas a concorrência em escala é onde a Fish Audio tem uma vantagem estrutural. Para um assistente de voz que lida exclusivamente com o inglês e onde o volume de conversação é previsível, a ElevenLabs é a opção mais forte em termos de pura qualidade de saída. Para qualquer coisa multilíngue ou de alta concorrência, esse cálculo muda.

Azure TTS: O Caminho de Implementação Empresarial

A qualidade do Azure Neural TTS atingiu um nível em que é competitivo para aplicações conversacionais. A confiabilidade e o SLA empresarial fazem dele a escolha padrão para organizações que já operam na infraestrutura Azure.

O streaming está disponível, mas normalmente requer acesso ao nível empresarial. A clonagem de voz é complexa de configurar e não foi projetada para o tipo de criação rápida de voz que criadores de conteúdo ou equipes de desenvolvimento menores precisam. Se o seu caso de uso for um sistema de URA empresarial ou um bot de atendimento ao cliente em larga escala com requisitos de voz estáveis e definidos, o Azure funciona bem. Para um desenvolvimento de IA conversacional mais experimental, a sobrecarga de configuração retarda a iteração.

Padrões de Design de Voz que Melhoram a Qualidade Conversacional

A seleção da plataforma é uma alavanca. Como você configura a interação de voz é outra.

Use streaming desde a primeira resposta. Não espere até confirmar que o áudio completo está disponível. Comece a reproduzir o primeiro bloco e armazene o restante no buffer. A sensação conversacional vem do primeiro áudio rápido, não do áudio completo rápido.

Combine a seleção de voz com o tom do caso de uso. Uma voz de IA de companhia e uma voz de bot de atendimento ao cliente devem soar diferentes. O perfil emocional importa: mais caloroso para aplicativos de companhia, mais comedido para entrega de informações, mais animado para aplicativos de consumo.

Mantenha as respostas individuais curtas. A qualidade do TTS por unidade de áudio é maior para frases curtas e completas. Respostas longas introduzem mais oportunidades de inconsistência na prosódia. Se o seu LLM gerar uma resposta de 4 frases, considere se transmitir essas frases como 4 chamadas de TTS separadas (e reproduzi-las em sequência) entrega uma melhor qualidade de voz do que uma única chamada com uma entrada de 4 frases.

Pré-gere respostas estáticas. Saudações, confirmações, transições ("Deixe-me verificar isso para você") são geradas de forma idêntica todas as vezes. Pré-gere-as uma vez e sirva a partir do cache. Você elimina totalmente a latência da API para as expressões mais frequentes.

Nota do Desenvolvedor: Assistentes de voz precisam lidar com interrupções. Se um usuário falar enquanto o TTS está sendo reproduzido, o áudio deve parar de forma limpa. Implemente isso antes de testar com usuários reais, não depois — a UX de interrupção é o fator número um que faz os assistentes de voz parecerem não naturais.

Correspondendo a Plataforma ao Tipo de Chatbot

IA de companhia e bots sociais: O alcance emocional e a naturalidade da voz importam mais do que qualquer outra variável. Fish Audio ou ElevenLabs. A vantagem da Fish Audio aumenta se você precisar de suporte multilíngue ou de uma voz de personagem personalizada.

Bots de atendimento ao cliente: O suporte multilíngue e a confiabilidade são o que mais importa. A Fish Audio lida com mais de 30 idiomas com uma única API e qualidade consistente. A alta concorrência é importante para aplicações de atendimento ao cliente que veem picos de volume.

URA e sistemas telefônicos: Os requisitos de latência são um pouco mais flexíveis do que os assistentes de voz de web/app. O controle de SSML para pronúncia e ritmo importa mais. Azure ou Amazon Polly são bem adequados especificamente para o canal telefônico.

Assistentes de informação (bots de FAQ, bots de conhecimento): A voz precisa soar autoritária e clara. Uma voz neutra e comedida de qualquer uma das principais plataformas funciona. A latência e o custo são os principais diferenciais neste ponto.

Perguntas Frequentes

Qual latência de TTS eu preciso para que um chatbot de voz pareça natural? Um TTFB (tempo para o primeiro áudio) abaixo de 400ms mantém a alternância de turnos conversacional natural. Abaixo de 200ms parece imediato. Acima de 600ms faz com que os usuários comecem a falar antes que o bot termine ou esperem em um silêncio desconfortável. O TTFB em nível de milissegundos da Fish Audio mantém as respostas na faixa natural.

Posso criar uma voz de marca personalizada para o meu assistente de voz? Sim. A clonagem de voz da Fish Audio cria uma voz de marca a partir de uma gravação de 15 segundos, que gera toda a saída de TTS nessa voz. O clone funciona em mais de 30 idiomas, portanto, uma única voz de marca escala para implantações internacionais.

O streaming de TTS funciona com pipelines de IA conversacional? Sim, e é a arquitetura recomendada. O streaming da Fish Audio significa que o usuário ouve o início de uma resposta enquanto o restante ainda está sendo gerado. Combinado com a geração de texto em streaming de um LLM, a latência de ponta a ponta da entrada do usuário até a resposta audível pode cair para menos de 500ms.

O que acontece com a qualidade do TTS em uma conversa longa (mais de 10 turnos)? A consistência da voz entre os turnos é determinada pelo modelo de TTS, não pela duração da conversa. O modelo da Fish Audio produz prosódia consistente em chamadas repetidas, o que evita a deriva de voz que algumas plataformas exibem em sessões de múltiplos turnos.

Vale a pena usar clonagem de voz para um chatbot de atendimento ao cliente? Para chatbots de marca onde a identidade consistente da empresa importa, sim. Uma voz clonada que corresponda ao estilo de comunicação da sua marca é mais eficaz do que selecionar de um catálogo genérico. O mínimo de amostra de 15 segundos da Fish Audio torna isso prático sem um orçamento de gravação profissional.

Qual API de TTS lida melhor com várias conversas simultâneas de chatbot? O suporte de alta concorrência da Fish Audio foi projetado exatamente para isso. O perfil de latência permanece consistente sob carga simultânea. Azure e Google também lidam bem com alta concorrência, embora com diferentes compensações de qualidade e recursos.

Conclusão

Para IA conversacional, a seleção da API de TTS resume-se a duas questões: ela pode entregar áudio rápido o suficiente para que a alternância de turnos pareça natural e pode sustentar esse desempenho quando centenas de conversas estão acontecendo simultaneamente?

O TTFB em milissegundos, o suporte a streaming, a alta concorrência e a clonagem de voz da Fish Audio tornam-na a opção mais completa para implantações conversacionais. ElevenLabs para casos de uso focados em inglês onde a própria voz faz parte do produto. Azure e Google para implantações empresariais ou alinhadas à infraestrutura onde esses ecossistemas já definem a arquitetura.

Teste sob carga simultânea antes de se comprometer. Um assistente de voz que funciona com 1 usuário não prevê o comportamento com 500. Documentação da API e detalhes de integração em docs.fish.audio.