Fish Audio Disponibiliza S2 em Código Aberto: Controle de Grão Fino Encontra Streaming de Produção

O S2 Pro está disponível no Fish Audio App e o seu código aberto está disponível através do repositório GitHub do projeto e no HuggingFace.

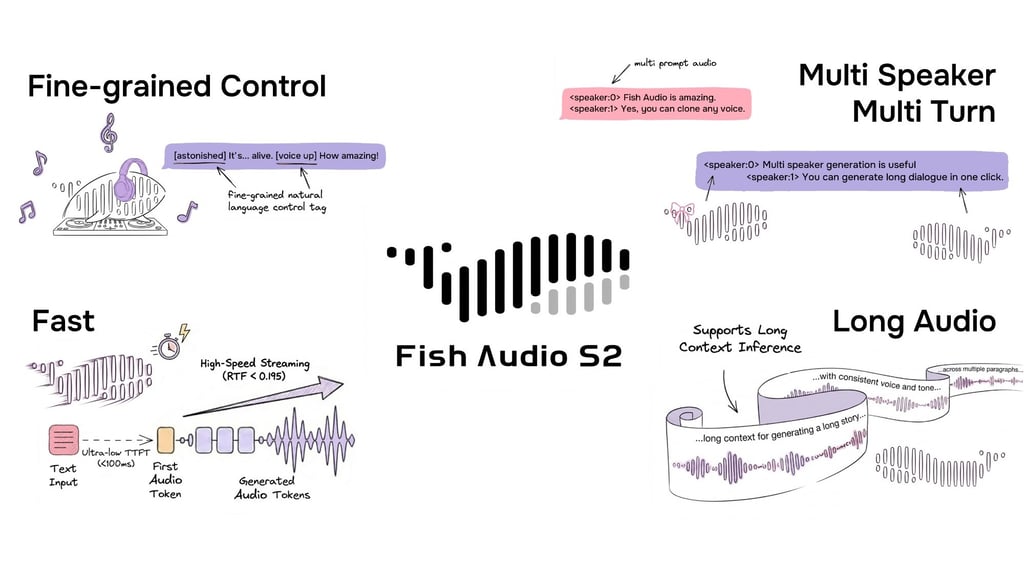

A Fish Audio lançou em código aberto o S2, um modelo de conversão de texto em fala (text-to-speech) que suporta controle in-line de grão fino de prosódia e emoção usando tags de linguagem natural como [laugh], [whispers] e [super happy]. Treinado em mais de 10 milhões de horas de áudio em aproximadamente 50 idiomas, o sistema combina alinhamento por aprendizagem por reforço com uma arquitetura auto-regressiva dupla. O lançamento inclui pesos do modelo, código de ajuste fino (fine-tuning) e um motor de inferência de streaming baseado em SGLang.

Controle In-line de Grão Fino via Linguagem Natural

O S2 permite Controle in-line sobre a geração de fala ao incorporar instruções de linguagem natural diretamente em posições específicas de palavras ou frases no texto. Em vez de depender de um conjunto fixo de tags predefinidas, o S2 aceita descrições textuais de forma livre — como [whisper in small voice], [professional broadcast tone] ou [pitch up] — permitindo o controle de expressão em aberto ao nível da palavra.

No Audio Turing Test, o S2 alcança uma média posterior de 0,515 com reescrita de instruções, em comparação com 0,417 para o Seed-TTS e 0,387 para o MiniMax-Speech. No EmergentTTS-Eval, atinge uma taxa de vitória global de 81,88% em relação a um baseline gpt-4o-mini-tts — a mais alta entre todos os modelos avaliados, incluindo sistemas de código fechado do Google e da OpenAI.

Exemplo do formato de entrada do S2 mostrando um diálogo multi-locutor com tags in-line de linguagem natural de forma livre para controle de grão fino.

Exemplo do formato de entrada do S2 mostrando um diálogo multi-locutor com tags in-line de linguagem natural de forma livre para controle de grão fino.

Uma Receita Unificada: Curadoria de Dados e Recompensas de RL dos Mesmos Modelos

Uma decisão arquitetônica central no S2 é que os mesmos modelos usados para filtrar e anotar os dados de treinamento são reutilizados diretamente como modelos de recompensa durante a aprendizagem por reforço (RL):

- Modelo de qualidade de fala avalia o áudio em dimensões como SNR, consistência do locutor e inteligibilidade durante a filtragem de dados — servindo depois como a recompensa de preferência acústica durante a RL.

- Modelo ASR de transcrição rica (pré-treinado a partir do Qwen3-Omni-30B-A3B) gera transcrições aumentadas por legendas com anotações paralinguísticas in-line durante a curadoria de dados — fornecendo depois a recompensa de inteligibilidade e seguimento de instruções ao re-transcrever o áudio gerado e compará-lo com o prompt original.

Este design de duplo propósito elimina por construção o desajuste de distribuição entre os dados de pré-treinamento e os objetivos de pós-treinamento — um problema que permanece sem solução em outros sistemas de TTS que treinam modelos de recompensa separadamente de seus pipelines de dados.

Por Dentro do Modelo: Arquitetura Dual-AR

O S2 baseia-se num transformer apenas decodificador combinado com um codec de áudio baseado em RVQ (10 codebooks, taxa de quadros de ~21 Hz). Achatar todos os codebooks ao longo do tempo causaria uma explosão de 10 vezes no comprimento da sequência. O S2 resolve isso com uma arquitetura Auto-regressiva Dupla (Dual-AR):

- AR Lenta (Slow AR) opera ao longo do eixo temporal e prevê o codebook semântico primário.

- AR Rápida (Fast AR) gera os 9 codebooks residuais restantes em cada passo de tempo, reconstruindo detalhes acústicos de grão fino.

Este design assimétrico — 4B de parâmetros ao longo do eixo do tempo, 400M de parâmetros ao longo do eixo de profundidade — mantém a inferência eficiente enquanto preserva a fidelidade do áudio.

Alinhamento de Aprendizagem por Reforço para Fala

Para o pós-treinamento, o S2 utiliza a Group Relative Policy Optimization (GRPO), escolhida para evitar a sobrecarga de memória dos modelos de valor do tipo PPO em contextos de áudio longos. O sinal de recompensa combina múltiplas dimensões, incluindo:

- Acurácia semântica e adesão a instruções

- Pontuação de preferência acústica

- Similaridade de timbre

Resultados de Benchmark

O S2 alcança resultados de liderança em múltiplos benchmarks públicos:

| Benchmark | Fish Audio S2 |

|---|---|

| Seed-TTS Eval — WER (Chinês) | 0,54% (melhor geral) |

| Seed-TTS Eval — WER (Inglês) | 0,99% (melhor geral) |

| Audio Turing Test (com instrução) | 0,515 média posterior |

| EmergentTTS-Eval — Taxa de Vitória | 81,88% (maior geral) |

| Fish Instruction Benchmark — TAR | 93,3% |

| Fish Instruction Benchmark — Qualidade | 4,51 / 5,0 |

| Multilíngue (MiniMax Testset) — Melhor WER | 11 de 24 idiomas |

| Multilíngue (MiniMax Testset) — Melhor SIM | 17 de 24 idiomas |

No Seed-TTS Eval, o S2 atinge o menor WER entre todos os modelos avaliados, incluindo sistemas de código fechado: Qwen3-TTS (0,77/1,24), MiniMax Speech-02 (0,99/1,90), Seed-TTS (1,12/2,25). No Audio Turing Test, 0,515 supera o Seed-TTS (0,417) em 24% e o MiniMax-Speech (0,387) em 33%. No EmergentTTS-Eval, o S2 alcança resultados particularmente fortes em paralinguística (taxa de vitória de 91,61%), perguntas (84,41%) e complexidade sintática (83,39%).

Para uma visão mais ampla de como diferentes soluções são avaliadas em relação ao controle de emoção, latência e suporte multilíngue, você pode consultar esta comparação independente de ferramentas de voz e áudio de IA.

Streaming de Produção via SGLang

Como a arquitetura Dual-AR do S2 é estruturalmente isomórfica aos LLMs auto-regressivos padrão, ela pode herdar diretamente todas as otimizações de serviço nativas de LLM do SGLang com modificações mínimas — incluindo batching contínuo, paged KV cache, replays de gráficos CUDA e cache de prefixo baseado em RadixAttention.

Para clonagem de voz, o S2 coloca tokens de áudio de referência no prompt do sistema. O RadixAttention do SGLang armazena automaticamente esses estados KV em cache, alcançando uma taxa média de acerto no cache de prefixo de 86,4% (mais de 90% no pico) quando a mesma voz é reutilizada entre as solicitações — tornando a sobrecarga de preenchimento do áudio de referência quase insignificante.

Em uma única GPU NVIDIA H200:

- Fator de Tempo Real (RTF): 0,195

- Tempo para o primeiro áudio: aproximadamente 100 ms

- Taxa de transferência: mais de 3.000 tokens acústicos/s enquanto mantém o RTF abaixo de 0,5

Por Que Este Lançamento é Importante

O S2 é lançado não apenas como um checkpoint de modelo, mas como um sistema completo: pesos de modelo, código de ajuste fino e uma pilha de inferência pronta para produção.

Duas escolhas de design se destacam. Primeiro, o pipeline unificado de dados e recompensa elimina um problema estrutural — o desajuste de distribuição entre o pré-treinamento e a RL — que outros sistemas de TTS não abordaram a nível arquitetônico. Segundo, o isomorfismo estrutural entre a arquitetura Dual-AR e os LLMs padrão significa que o S2 pode alavancar todo o ecossistema de otimizações de serviço de LLM, em vez de exigir uma infraestrutura de inferência personalizada.

O S2 está disponível através do repositório GitHub do projeto, SGLang-Omni, HuggingFace e demonstração interativa em fish.audio.