Echtzeit-Text-zu-Sprache für KI-Begleiter

18. Nov. 2025

Der globale Markt für KI-Begleiter wird im Jahr 2024 auf etwa 22 bis 28 Milliarden USD geschätzt, mit einem prognostizierten Wachstum auf 140 Milliarden USD bis 2030. Angesichts der zunehmenden sozialen Isolation in der Gesellschaft, die besonders in Regionen wie Japan, Korea, China und den Vereinigten Staaten verbreitet ist, werden KI-Begleiter zu einer lebenswichtigen Trostquelle für viele, die nach emotionaler Verbindung suchen. Während viele KI-Begleiter heute textbasiert sind, befeuert der Aufstieg von Anbietern wie Fish Audio, die erstklassige Text-zu-Sprache-Audioqualität mit stabilem Realismus bieten, den Wandel hin zu emotional intimeren und intelligenteren Begleitern, die tatsächlich mit den Nutzern sprechen und konversieren.

Eine entscheidende Fähigkeit, die von Text-zu-Sprache-Lösungen für KI-Begleiter verlangt wird, ist die Fähigkeit, in Echtzeit zu konversieren. Während Bruchteile einer Sekunde an Latenz akzeptabel und sogar zu erwarten sind (um menschliche Sprache nachzuahmen), muss die Text-zu-Sprache-Technologie mit einer ausreichend kurzen Time-to-First-Byte und Latenz reagieren, um Audioclips zu erzeugen, die eine echte menschliche Interaktion simulieren. Dieses Echtzeit-Streaming von Audiosprache ermöglicht es vielen Konversationsplattformen für KI-Begleiter, Immersion und Engagement zu maximieren.

Echtzeit-Text-zu-Sprache

Sprachanrufe mit KI-Begleitern müssen Echtzeit-Text-zu-Sprache nutzen, um sich echt anzufühlen. In der Praxis bedeutet dies in der Regel die Verwendung eines Websockets, um die Zwei-Wege-Kommunikation zwischen dem Nutzer und dem KI-Text-zu-Sprache-Anbieter zu ermöglichen. Der Text für den Begleiter kann erzeugt und dann an den Anbieter weitergeleitet werden, wobei das Audio direkt an die Lautsprecher des Nutzers zurückgegeben wird.

Diese KI-Begleiter können dann sogar für andere Anwendungen wie Smart Homes, Wellness-Apps, soziale Plattformen und jeden anderen virtuellen Assistenten verwendet werden.

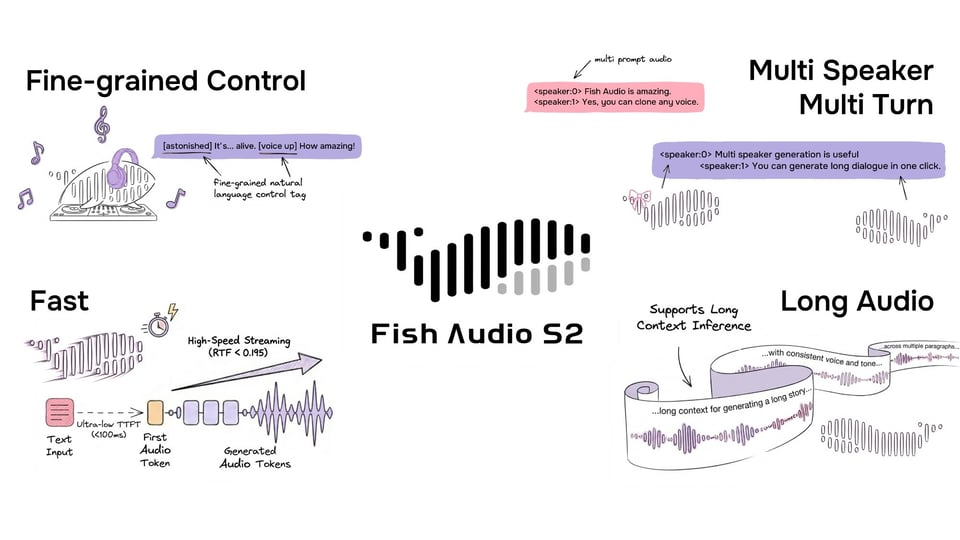

Die Echtzeit-Text-zu-Sprache-Funktionen von Fish Audio

Für Entwickler von KI-Begleitern ist die Wahl des richtigen TTS-Anbieters entscheidend, um den Nutzern das beste Erlebnis zu bieten. Fish Audio ist der weltweit beste Anbieter für Echtzeit-TTS und führend sowohl bei der emotionalen Ausdrucksstärke als auch bei der Echtzeit-Latenz. Fish Audio bietet umfangreiche Websocket-Dokumentationen und Anleitungen zur Integration von Echtzeit-Live-Audio-Streaming. Mit SDKs für sowohl Python als auch JavaScript macht es Fish Audio außergewöhnlich einfach, in wenigen Minuten loszulegen und Echtzeit-Streaming zu integrieren. Fish Audio bietet:

Emotionaler Ausdruck mit Emotions-Tags, die Keuchen, Flüstern und komplexe Emotionen in Echtzeit steuern können.

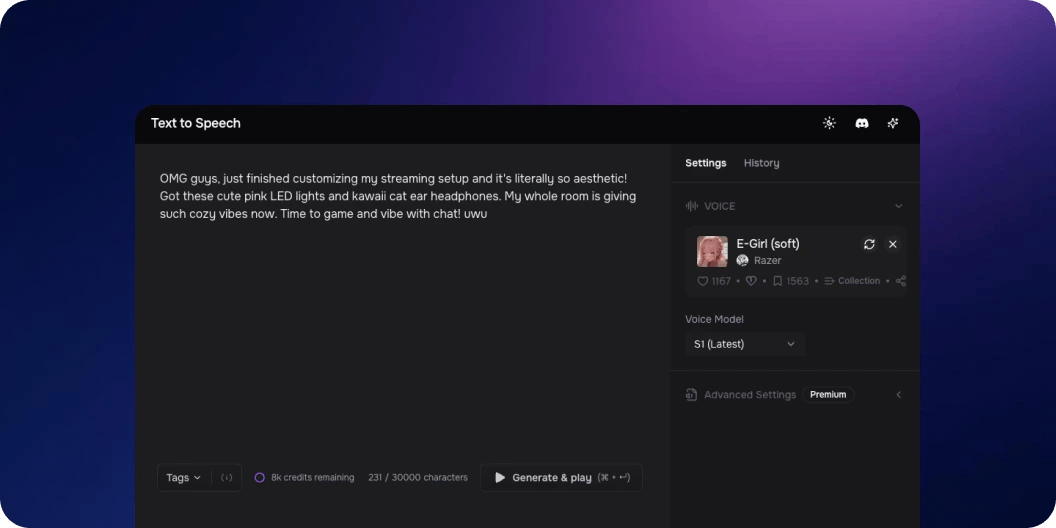

Breite Sprachverfügbarkeit: Mit einer Bibliothek von der Community erstellter Stimmen und der Möglichkeit, die eigene Stimme mit nur 10 Sekunden Audio zu klonen, sodass sie nicht von der Realität zu unterscheiden ist.

Fish Audio ist der führende Anbieter für Echtzeit-Text-zu-Sprache und wird von Nutzern und Entwicklern am konsistentesten als der Beste bewertet. Mit der großen Community von Fish Audio-Creatoren ergeben sich riesige Chancen, Anwendungen zu entwickeln, die Sprache nutzen, um Trost und Begleitung zu bieten. Legen Sie noch heute los und beginnen Sie in wenigen Minuten mit dem Streaming kristallklarer, emotional tiefer Stimmen!