Fish Audio Abre Código do S2: Controle de Granularidade Fina Encontra Streaming de Produção

9 de mar. de 2026

O código aberto do S2 está disponível através do repositório no GitHub do projeto e no HuggingFace.

A Fish Audio lançou o código aberto do S2, um modelo de texto para fala que suporta controle inline de granularidade fina de prosódia e emoção usando tags de linguagem natural como [laugh], [whispers] e [super happy]. Treinado em mais de 10 milhões de horas de áudio em aproximadamente 50 idiomas, o sistema combina alinhamento por aprendizagem por reforço com uma arquitetura dual-autorregressiva. O lançamento inclui pesos do modelo, código de ajuste fino e um mecanismo de inferência de streaming baseado em SGLang.

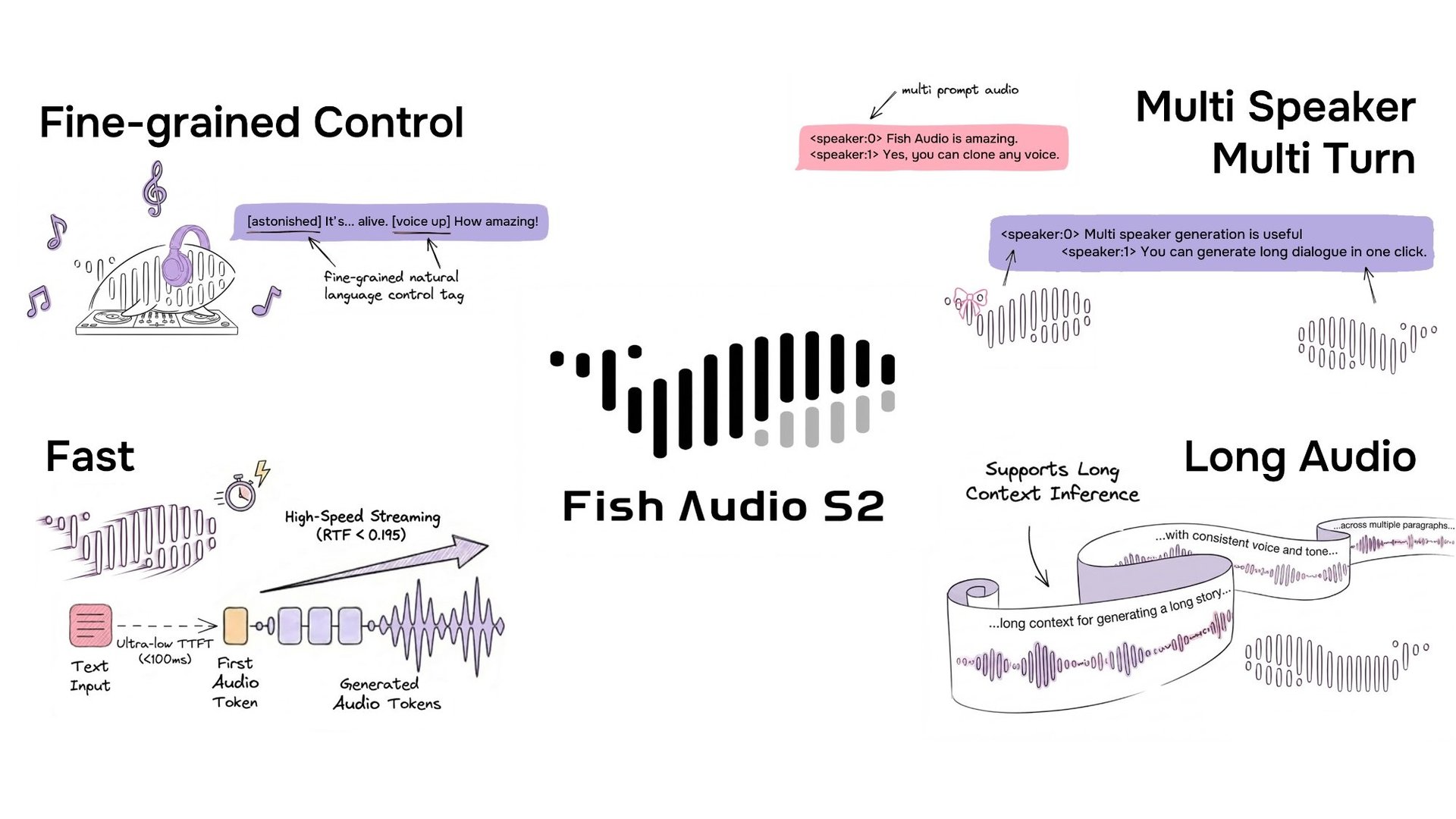

Controle Inline de Granularidade Fina via Linguagem Natural

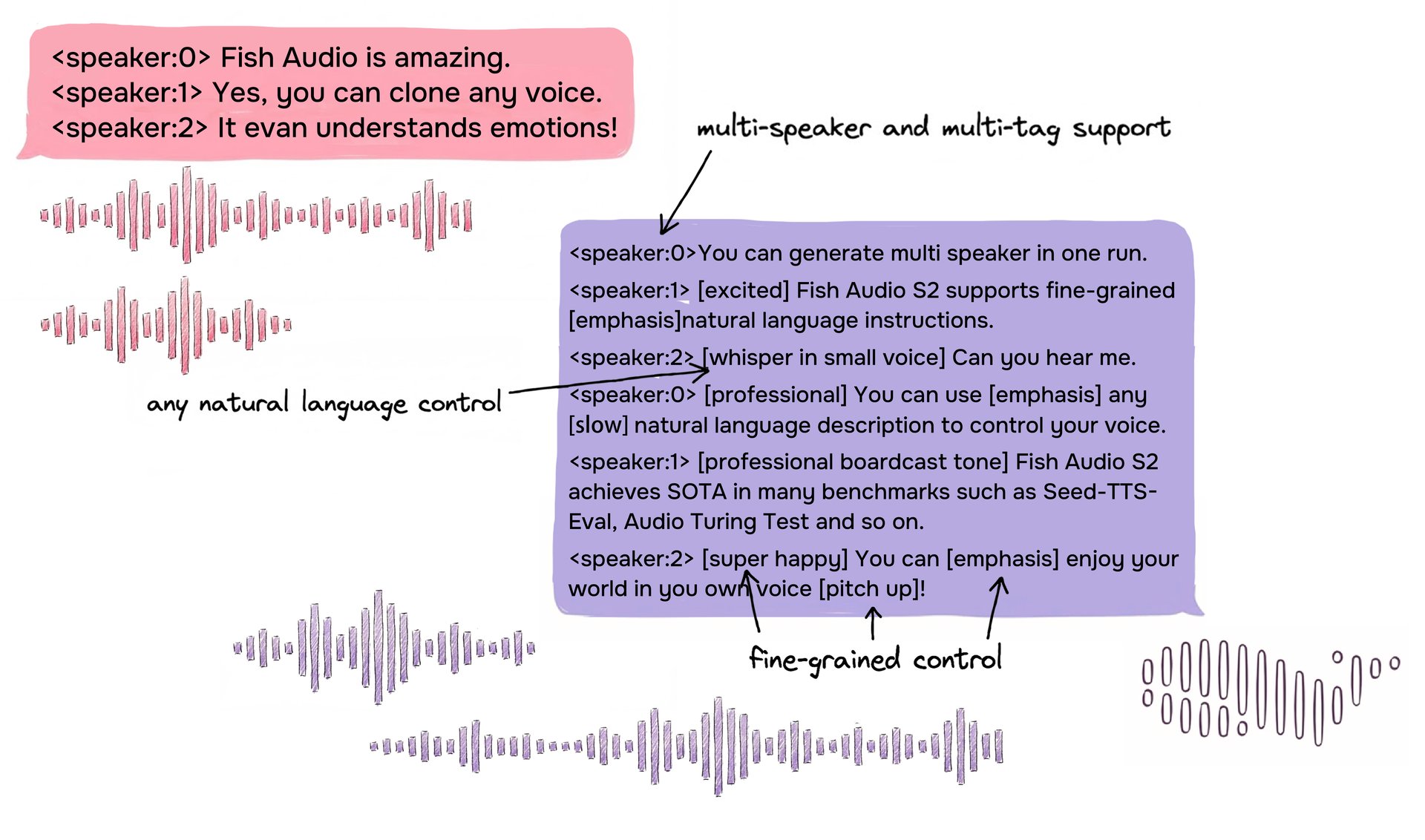

O S2 permite Controle inline sobre a geração de fala ao incorporar instruções de linguagem natural diretamente em posições específicas de palavras ou frases dentro do texto. Em vez de depender de um conjunto fixo de tags predefinidas, o S2 aceita descrições textuais de forma livre — como [whisper in small voice], [professional broadcast tone] ou [pitch up] — permitindo controle de expressão em aberto ao nível da palavra.

No Audio Turing Test, o S2 alcança uma média posterior de 0,515 com reescrita de instrução, comparado a 0,417 para Seed-TTS e 0,387 para MiniMax-Speech. No EmergentTTS-Eval, atinge uma taxa de vitória geral de 81,88% contra uma linha de base gpt-4o-mini-tts — a mais alta entre todos os modelos avaliados, incluindo sistemas de código fechado do Google e OpenAI.

Exemplo de formato de entrada do S2 mostrando diálogo multi-locutor com tags inline de linguagem natural de forma livre para controle de granularidade fina.

Exemplo de formato de entrada do S2 mostrando diálogo multi-locutor com tags inline de linguagem natural de forma livre para controle de granularidade fina.

Uma Receita Unificada: Curadoria de Dados e Recompensas de RL dos Mesmos Modelos

Uma decisão arquitetural central no S2 é que os mesmos modelos usados para filtrar e anotar os dados de treinamento são reutilizados diretamente como modelos de recompensa durante a aprendizagem por reforço:

- Modelo de qualidade de fala pontua o áudio em dimensões como SNR, consistência do locutor e inteligibilidade durante a filtragem de dados — servindo então como a recompensa de preferência acústica durante o RL.

- Modelo ASR de transcrição rica (pré-treinado a partir do Qwen3-Omni-30B-A3B) gera transcrições aumentadas por legendas com anotações paralinguísticas inline durante a curadoria de dados — fornecendo então a recompensa de inteligibilidade e seguimento de instruções ao re-transcrever o áudio gerado e compará-lo com o prompt original.

Este design de dupla finalidade elimina a incompatibilidade de distribuição entre os dados de pré-treinamento e os objetivos de pós-treinamento por construção — um problema que permanece sem solução em outros sistemas de TTS que treinam modelos de recompensa separadamente de seus pipelines de dados.

Por Dentro do Modelo: Arquitetura Dual-AR

O S2 baseia-se em um transformer apenas decodificador combinado com um codec de áudio baseado em RVQ (10 codebooks, taxa de quadros de ~21 Hz). Achatar todos os codebooks ao longo do tempo causaria uma explosão de 10 vezes no comprimento da sequência. O S2 resolve isso com uma arquitetura Dual-Autorregressiva (Dual-AR):

- Slow AR opera ao longo do eixo do tempo e prevê o codebook semântico primário.

- Fast AR gera os 9 codebooks residuais restantes em cada etapa de tempo, reconstruindo detalhes acústicos de granularidade fina.

Este design assimétrico — 4B de parâmetros ao longo do eixo do tempo, 400M de parâmetros ao longo do eixo de profundidade — mantém a inferência eficiente enquanto preserva a fidelidade do áudio.

Alinhamento por Aprendizagem por Reforço para Fala

Para o pós-treinamento, o S2 utiliza a Otimização de Política Relativa de Grupo (GRPO), escolhida para evitar a sobrecarga de memória de modelos de valor no estilo PPO em contextos de áudio longos. O sinal de recompensa combina múltiplas dimensões, incluindo:

- Precisão semântica e aderência às instruções

- Pontuação de preferência acústica

- Similaridade de timbre

Resultados de Benchmarks

O S2 alcança resultados de liderança em vários benchmarks públicos:

| Benchmark | Fish Audio S2 |

|---|---|

| Seed-TTS Eval — WER (Chinês) | 0,54% (melhor geral) |

| Seed-TTS Eval — WER (Inglês) | 0,99% (melhor geral) |

| Audio Turing Test (com instrução) | 0,515 média posterior |

| EmergentTTS-Eval — Taxa de Vitória | 81,88% (mais alta no geral) |

| Fish Instruction Benchmark — TAR | 93,3% |

| Fish Instruction Benchmark — Qualidade | 4,51 / 5,0 |

| Multilingual (MiniMax Testset) — Melhor WER | 11 de 24 idiomas |

| Multilingual (MiniMax Testset) — Melhor SIM | 17 de 24 idiomas |

No Seed-TTS Eval, o S2 alcança o menor WER entre todos os modelos avaliados, incluindo sistemas de código fechado: Qwen3-TTS (0,77/1,24), MiniMax Speech-02 (0,99/1,90), Seed-TTS (1,12/2,25). No Audio Turing Test, 0,515 supera o Seed-TTS (0,417) em 24% e o MiniMax-Speech (0,387) em 33%. No EmergentTTS-Eval, o S2 alcança resultados particularmente fortes em paralinguística (91,61% de taxa de vitória), perguntas (84,41%) e complexidade sintática (83,39%).

Streaming de Produção via SGLang

Como a arquitetura Dual-AR do S2 é estruturalmente isomórfica aos LLMs autorregressivos padrão, ela pode herdar diretamente todas as otimizações de serviço nativas de LLM do SGLang com modificação mínima — incluindo batching contínuo, cache KV paginado, replay de gráfico CUDA e cache de prefixo baseado em RadixAttention.

Para clonagem de voz, o S2 coloca tokens de áudio de referência no prompt do sistema. O RadixAttention do SGLang armazena automaticamente esses estados KV em cache, alcançando uma taxa média de acerto de cache de prefixo de 86,4% (mais de 90% no pico) quando a mesma voz é reutilizada em várias solicitações — tornando a sobrecarga de prefill do áudio de referência quase insignificante.

Em uma única GPU NVIDIA H200:

- Fator de Tempo Real (RTF): 0,195

- Tempo para o primeiro áudio: aproximadamente 100 ms

- Throughput: mais de 3.000 tokens acústicos/s mantendo o RTF abaixo de 0,5

Por Que Este Lançamento é Importante

O S2 não é lançado apenas como um checkpoint de modelo, mas como um sistema completo: pesos do modelo, código de ajuste fino e uma pilha de inferência pronta para produção.

Duas escolhas de design se destacam. Primeiro, o pipeline unificado de dados e recompensa elimina um problema estrutural — a incompatibilidade de distribuição entre o pré-treinamento e o RL — que outros sistemas de TTS não abordaram no nível arquitetural. Segundo, o isomorfismo estrutural entre a arquitetura Dual-AR e os LLMs padrão significa que o S2 pode alavancar todo o ecossistema de otimizações de serviço de LLM, em vez de exigir uma infraestrutura de inferência personalizada.

O S2 está disponível através do repositório no GitHub do projeto, SGLang-Omni, HuggingFace e demonstração interativa em fish.audio.