Fish Audio открывает исходный код S2: точное управление и потоковая передача уровня продакшн

9 мар. 2026 г.

S2 с открытым исходным кодом доступен в GitHub-репозитории проекта и на HuggingFace.

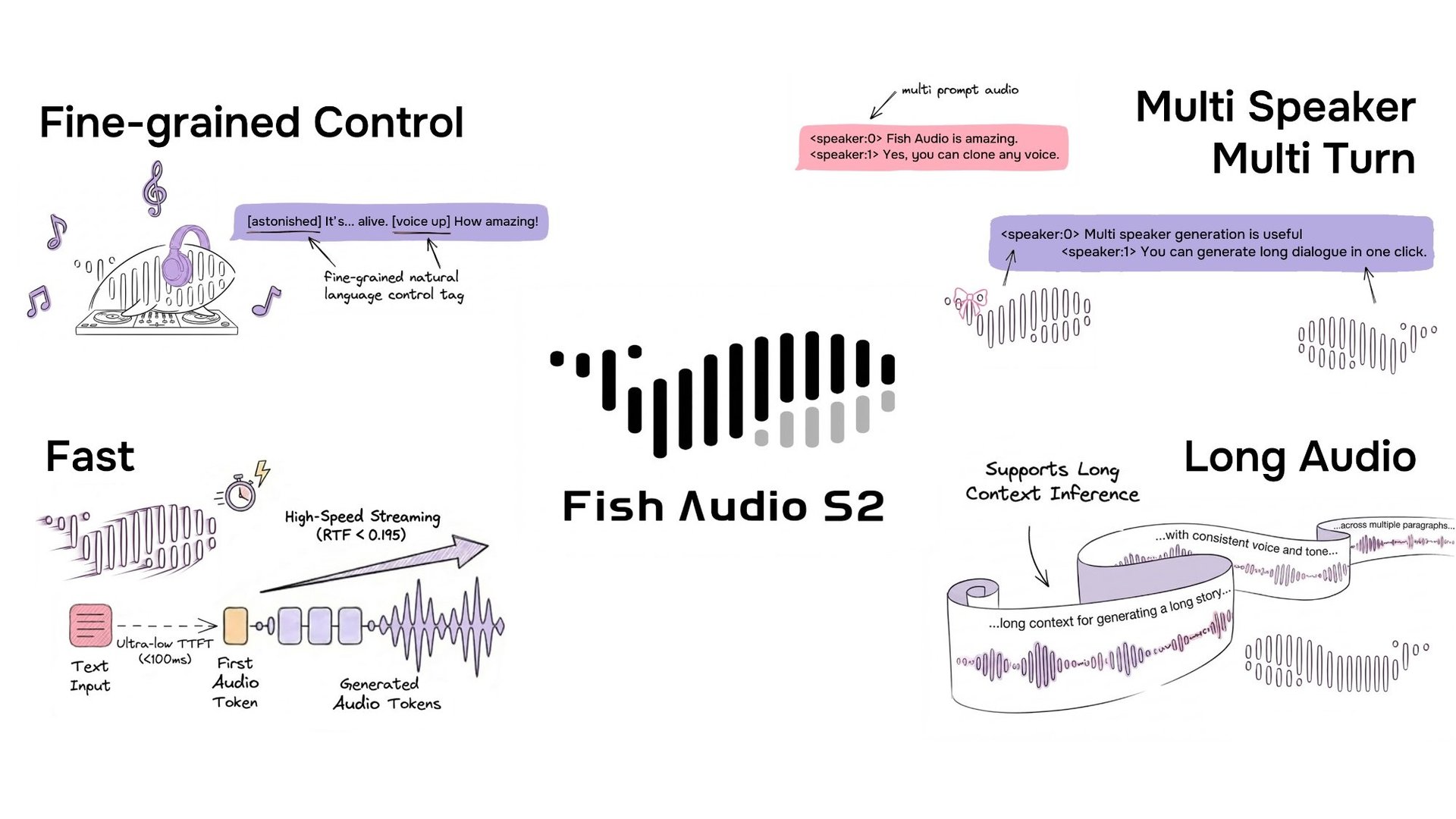

Fish Audio открыла исходный код S2 — модели преобразования текста в речь (TTS), которая поддерживает точное встроенное управление просодией и эмоциями с помощью тегов на естественном языке, таких как [laugh], [whispers] и [super happy]. Система, обученная на более чем 10 миллионах часов аудио на примерно 50 языках, сочетает в себе выравнивание с помощью обучения с подкреплением и двойную авторегрессионную архитектуру. Релиз включает веса модели, код для тонкой настройки и движок для потокового инференса на базе SGLang.

Точное встроенное управление с помощью естественного языка

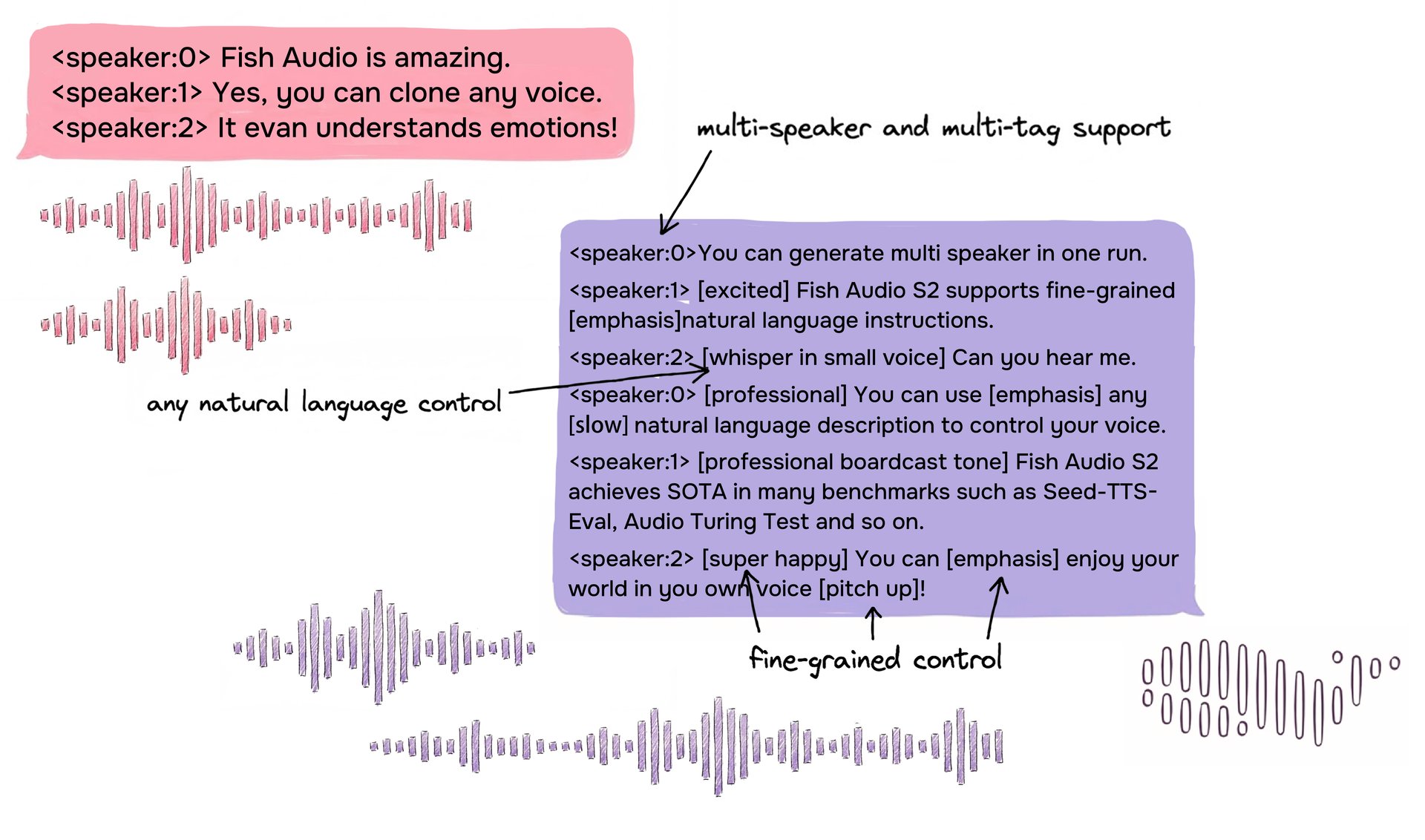

S2 обеспечивает встроенное управление генерацией речи путем вставки инструкций на естественном языке непосредственно в определенные позиции слов или фраз в тексте. Вместо того чтобы полагаться на фиксированный набор предопределенных тегов, S2 принимает текстовые описания в свободной форме — такие как [whisper in small voice], [professional broadcast tone] или [pitch up] — позволяя гибко управлять экспрессией на уровне слов.

В тесте Audio Turing Test S2 достигает апостериорного среднего значения 0,515 с перефразированием инструкций, по сравнению с 0,417 для Seed-TTS и 0,387 для MiniMax-Speech. В EmergentTTS-Eval модель достигает общего процента побед 81,88% по сравнению с базовой моделью gpt-4o-mini-tts — это самый высокий показатель среди всех протестированных моделей, включая закрытые системы от Google и OpenAI.

Пример формата ввода S2, демонстрирующий диалог с несколькими дикторами и произвольными встроенными тегами на естественном языке для точного управления.

Пример формата ввода S2, демонстрирующий диалог с несколькими дикторами и произвольными встроенными тегами на естественном языке для точного управления.

Единый метод: подготовка данных и RL-вознаграждения из одних и тех же моделей

Ключевым архитектурным решением в S2 является то, что те же модели, которые использовались для фильтрации и аннотирования обучающих данных, повторно используются в качестве моделей вознаграждения во время обучения с подкреплением (RL):

- Модель качества речи оценивает аудио по таким параметрам, как SNR (отношение сигнал/шум), последовательность диктора и разборчивость во время фильтрации данных — а затем служит вознаграждением за акустические предпочтения во время RL.

- Модель ASR с расширенной транскрипцией (продолжение обучения на базе Qwen3-Omni-30B-A3B) генерирует транскрипты с описаниями и встроенными паралингвистическими аннотациями во время подготовки данных — а затем обеспечивает вознаграждение за разборчивость и следование инструкциям путем повторной транскрибации сгенерированного аудио и сравнения его с исходным промптом.

Такой двойной дизайн исключает несоответствие распределения между данными предварительного обучения и целями после обучения — проблему, которая остается нерешенной в других системах TTS, где модели вознаграждения обучаются отдельно от пайплайнов данных.

Внутри модели: архитектура Dual-AR

S2 построена на базе трансформера (decoder-only) в сочетании с аудиокодеком на основе RVQ (10 кодовых книг, частота кадров ~21 Гц). Развертывание всех кодовых книг вдоль временной оси привело бы к 10-кратному увеличению длины последовательности. S2 решает эту проблему с помощью архитектуры Dual-Autoregressive (Dual-AR):

- Slow AR работает вдоль временной оси и предсказывает основную семантическую кодовую книгу.

- Fast AR генерирует остальные 9 остаточных кодовых книг на каждом временном шаге, восстанавливая точные акустические детали.

Эта асимметричная конструкция — 4 млрд параметров вдоль временной оси и 400 млн параметров вдоль оси глубины — обеспечивает эффективность инференса при сохранении высокого качества звука.

Выравнивание с помощью обучения с подкреплением для речи

Для этапа post-training в S2 используется метод Group Relative Policy Optimization (GRPO), выбранный для того, чтобы избежать накладных расходов памяти, характерных для моделей ценности в стиле PPO в контексте длинного аудио. Сигнал вознаграждения сочетает в себе несколько измерений, включая:

- Семантическую точность и следование инструкциям

- Оценку акустических предпочтений

- Сходство тембра

Результаты бенчмарков

S2 достигает лидирующих результатов в нескольких публичных бенчмарках:

| Бенчмарк | Fish Audio S2 |

|---|---|

| Seed-TTS Eval — WER (Китайский) | 0.54% (лучший результат) |

| Seed-TTS Eval — WER (Английский) | 0.99% (лучший результат) |

| Audio Turing Test (с инструкциями) | 0.515 (апостериорное среднее) |

| EmergentTTS-Eval — Win Rate | 81.88% (самый высокий результат) |

| Fish Instruction Benchmark — TAR | 93.3% |

| Fish Instruction Benchmark — Качество | 4.51 / 5.0 |

| Multilingual (MiniMax Testset) — Лучший WER | 11 из 24 языков |

| Multilingual (MiniMax Testset) — Лучший SIM | 17 из 24 языков |

В Seed-TTS Eval S2 демонстрирует самый низкий показатель WER среди всех протестированных моделей, включая закрытые системы: Qwen3-TTS (0.77/1.24), MiniMax Speech-02 (0.99/1.90), Seed-TTS (1.12/2.25). В Audio Turing Test показатель 0,515 превосходит Seed-TTS (0,417) на 24% и MiniMax-Speech (0,387) на 33%. В EmergentTTS-Eval S2 показывает особенно сильные результаты в паралингвистике (91,61% побед), вопросах (84,41%) и синтаксической сложности (83,39%).

Продуктовая потоковая передача через SGLang

Поскольку архитектура Dual-AR в S2 структурно изоморфна стандартным авторегрессионным LLM, она может напрямую наследовать все нативные оптимизации обслуживания LLM из SGLang с минимальными изменениями — включая непрерывный батчинг (continuous batching), paged KV cache, CUDA graph replay и кэширование префиксов на основе RadixAttention.

Для клонирования голоса S2 помещает токены эталонного аудио в системный промпт. RadixAttention в SGLang автоматически кэширует эти KV-состояния, достигая среднего показателя попадания в кэш префиксов 86,4% (более 90% в пике) при повторном использовании одного и того же голоса в запросах, что делает накладные расходы на предварительную обработку эталонного аудио практически незначительными.

На одном графическом процессоре NVIDIA H200:

- Real-Time Factor (RTF): 0.195

- Время до первого аудио (Time-to-first-audio): примерно 100 мс

- Пропускная способность: 3,000+ акустических токенов/с при сохранении RTF ниже 0.5

Почему этот релиз важен

S2 выпущен не просто как чекпоинт модели, а как полная система: веса модели, код для тонкой настройки и готовый к продакшну стек инференса.

Выделяются два дизайнерских решения. Во-первых, унифицированный пайплайн данных и вознаграждений устраняет структурную проблему — несоответствие распределения между предварительным обучением и RL — которую другие системы TTS не решили на архитектурном уровне. Во-вторых, структурный изоморфизм между архитектурой Dual-AR и стандартными LLM означает, что S2 может использовать всю экосистему оптимизаций обслуживания LLM, вместо того чтобы требовать кастомную инфраструктуру для инференса.

S2 доступен через GitHub-репозиторий проекта, SGLang-Omni, HuggingFace и в интерактивном демо на fish.audio.