Как работает преобразование речи в текст? Принцип работы технологии Speech-to-Text

28 февр. 2026 г.

Большинство людей думают, что преобразование речи в текст — это простой процесс: звук входит, текст выходит, как поиск в словаре со скоростью 150 слов в минуту. На самом деле даже одно произнесенное предложение должно пройти через 4–6 уровней обработки нейронной сетью. Каждый уровень решает определенную задачу, которую люди выполняют неосознанно, но машины все еще интерпретируют неверно примерно в 5–15% случаев.

Согласно ежегодному индексу ИИ Стэнфордского университета, уровень ошибок снизился с 43% в 2013 году до менее чем 5% для качественного английского аудио в 2025 году. Тем не менее, эта цифра скрывает значительные различия. Замените студийную запись на запись телефонного разговора из переполненного ресторана, переключитесь с английского на тайский или добавьте второго говорящего — и уровень ошибок быстро вернется к 15–30%. Чтобы понять почему, нужно заглянуть «под капот» и разобраться, как технология работает на самом деле.

Speech-to-Text в одном предложении (и подробно)

По сути, преобразование речи в текст (STT), также называемое автоматическим распознаванием речи (ASR), переводит устную речь в письменный текст. Это определение в одном предложении.

Углубленное объяснение: система STT начинает с захвата аналогового аудиосигнала и преобразования его в цифровое представление; затем система извлекает паттерны, соответствующие звукам речи, сопоставляет эти звуки с вероятными словами и предложениями и применяет лингвистический контекст для определения наиболее вероятного значения высказывания. Каждый шаг включает в себя компромисс между скоростью, точностью и вычислительными затратами. Разница между транскрипцией в реальном времени на вашем телефоне и 24-часовым ожиданием службы медицинской транскрипции в конечном итоге сводится к компромиссам, на которые рассчитана каждая система. В целом, практический ответ на вопрос «как работает преобразование речи в текст» сильно зависит от окружения, вариативности речи говорящего, качества звука и сценария использования.

5-этапный рабочий процесс: что происходит между звуком и текстом

Современные системы преобразования речи в текст, будь то на вашем телефоне или в облачном дата-центре, обычно проходят пять основных этапов. Каждый этап решает конкретную техническую задачу.

Этап 1: Предварительная обработка аудио

Сырое аудио — это хаос. Перед началом распознавания система очищает и стандартизирует сигнал.

- Шумоподавление: система изолирует речевой сигнал от фонового шума (такого как дорожное движение, музыка или перекрывающиеся разговоры). Современные системы используют нейросетевое разделение источников звука, чтобы отличить голос говорящего от окружающего шума.

- Нормализация: уровни громкости регулируются таким образом, чтобы тихая и громкая речь давали одинаковую мощность сигнала.

- Дискретизация и фреймирование: непрерывный аудиопоток делится на короткие фрагменты (фреймы), обычно по 20–25 миллисекунд каждый, с небольшим перекрытием. Каждый фрейм достаточно короток, чтобы аудиосигнал внутри него можно было считать акустически стабильным.

На этом этапе качество звука либо гарантирует успех, либо ведет к провалу. Чистая студийная запись дает системе отличную отправную точку. Телефонный звонок, записанный через Bluetooth-динамик в машине, вносит шумы, которые каждый последующий этап должен будет компенсировать.

Этап 2: Извлечение признаков (Feature extraction)

После очистки аудиофреймы необходимо преобразовать из необработанных данных волновой формы в формат, фиксирующий характеристики звуков речи. Система не обрабатывает звуковую волну напрямую; вместо этого она извлекает «признаки» — числовые представления того, что заставляет каждый крошечный фрагмент аудио звучать именно так.

Традиционно системы полагаются на мел-частотные кепстральные коэффициенты (MFCC), которые представляют аудио в виде, приближенном к тому, как человеческое ухо воспринимает высоту звука и тон. Представьте это как превращение фотографии в эскиз, который сохраняет основные контуры, отбрасывая визуальный шум.

Более современные системы, особенно построенные на базе сквозного (end-to-end) глубокого обучения, обходят такие вручную созданные признаки, как MFCC, и обучаются извлекать собственные представления непосредственно из сырого аудио. Примерами такого подхода являются модели Whisper от OpenAI и wav2vec от Meta. Они показали, что при наличии достаточного количества обучающих данных нейронная сеть может находить представления признаков, превосходящие созданные человеком.

Этап 3: Акустическое моделирование

Здесь аудиопризнаки сопоставляются со звуками речи. Основной вопрос на этом этапе: «Какие фонемы (базовые единицы звуков) присутствуют в этом аудиофрейме?»

В английском языке около 44 фонем (в русском — 42). Слово «cat», например, состоит из трех: /k/, /æ/, /t/. Акустическая модель оценивает извлеченные признаки каждого фрейма и рассчитывает распределение вероятностей по всем возможным фонемам.

На этом этапе доминируют две архитектуры:

Connectionist Temporal Classification (CTC): нейронная сеть обрабатывает всю аудиопоследовательность и выдает вероятности фонем на каждом временном шаге без необходимости в предварительно выровненных обучающих данных. CTC стала важным прорывом, так как избавила от необходимости вручную сопоставлять аудио с транскриптами во время обучения.

Attention-based encoder-decoder (Transformer): эта архитектура, адаптированная из языковых моделей вроде GPT для обработки аудио, использует энкодер для обработки аудиопризнаков и декодер для генерации одного текстового токена за раз. Механизм внимания (attention) узнает, какие части аудио соответствуют каждому выходному токену. По сравнению с CTC, этот подход лучше справляется с долгосрочными зависимостями, часто создавая более естественные транскрипты для разговорной речи.

Большинство производственных систем в 2025–2026 годах используют гибридные подходы, сочетая выравнивание CTC с декодированием на базе Transformer для баланса скорости и точности.

Этап 4: Языковое моделирование

Акустическое моделирование говорит вам, какие звуки присутствуют. Языковое моделирование определяет, какие слова эти звуки, скорее всего, представляют в контексте.

Вот почему этот этап важен: представьте последовательность фонем /r/ /aɪ/ /t/, которая может соответствовать словам «right», «write» или «rite». Без языкового контекста система просто гадает. С языковой моделью, которая знает, что предыдущими словами были «please write», вероятность слова «write» становится почти стопроцентной.

Современные системы STT обычно полагаются на два типа языкового контекста:

- Статистические языковые модели: предсказывают слово на основе 2–5 предыдущих слов. Такие модели эффективны и легки, но ограничены в охвате контекста.

- Нейронные языковые модели: обрабатывают все предложение (или абзац) для оценки вероятности слова. Такие модели могут эффективнее справляться с двусмысленными фразами, длинными зависимостями и сложными структурами предложений, но требуют значительно больших вычислительных затрат.

Специализированная лексика также играет важную роль. Языковая модель общего назначения может расшифровать «CRISPR-Cas9» как «crisper cast nine», в то время как модель, дообученная на биомедицинских данных, распознает термин правильно. Это объясняет, почему специализированные службы транскрипции в медицине, праве и финансах по-прежнему превосходят инструменты общего назначения в плане технической терминологии.

Этап 5: Постобработка и форматирование

После 3-го и 4-го этапов на выходе получается поток слов в нижнем регистре без знаков препинания, заглавных букв и абзацев. Постобработка превратит этот сырой результат в удобный для чтения текст.

- Вставка знаков препинания: отдельная модель предсказывает, где должны стоять точки, запятые и вопросительные знаки, основываясь на акустических сигналах (таких как изменение тона и паузы) и лингвистических паттернах.

- Капитализация: имена собственные, начало предложений и аббревиатуры пишутся с заглавной буквы на основе языковых правил и распознавания именованных сущностей.

- Форматирование чисел: «триста сорок два доллара и пятьдесят центов» превращается в «$342.50».

- Удаление речевого мусора: такие заполнители, как «эм» и «ну», а также ложные повторы могут быть удалены при необходимости.

- Диаризация спикеров (если включена): определяет, какие фрагменты записи с несколькими участниками принадлежат каждому конкретному человеку. Это отдельная модель, которая анализирует характеристики голоса (высоту, тембр, темп речи) для кластеризации аудиосегментов по личностям.

Постобработка часто определяет, будет ли транскрипт просто технически точным или действительно пригодным для использования. Текст с точностью 95% без пунктуации читать сложнее, чем версию с точностью 92%, но правильно отформатированную.

От 43% ошибок до 5%: три прорыва, которые изменили все

Исследования в области распознавания речи ведутся с 1950-х годов. Если вы спросите, «как преобразование речи в текст стало работать достаточно хорошо для современных приложений», ответ кроется в трех крупных прорывах последнего десятилетия, которые не только повысили точность, но и превратили исследования в практически полезную технологию.

Прорыв 1: Глубокое обучение заменило скрытые марковские модели (2012–2015). Десятилетиями системы STT полагались на статистические модели, известные как HMM (скрытые марковские модели) в сочетании с гауссовскими смесями. Эти системы были сложно устроены и достигли предела точности — около 20–25% ошибок в разговорной речи. Когда глубокие нейронные сети заменили HMM в качестве акустической модели, уровень ошибок упал на 30% за короткий срок. Это стало поворотным моментом, когда такие продукты, как Siri и Google Voice, превратились из «забавных игрушек» в инструменты, которые стали по-настоящему полезными.

Прорыв 2: Сквозные (End-to-end) модели упростили систему (2016–2020). Традиционные системы STT требовали отдельных моделей для извлечения признаков, акустического и языкового моделирования. Сквозные системы, такие как LAS (Listen, Attend and Spell) от Google и wav2vec от Meta, обучают единую нейронную сеть, которая переводит аудио сразу в текст. Это снизило сложность разработки и, что более важно, позволило модели оптимизировать весь процесс целиком, а не каждый этап по отдельности.

Прорыв 3: Самообучение на огромных массивах неразмеченного аудио (2020 — настоящее время). Последний прорыв произошел благодаря обучению моделей на сотнях тысяч часов аудио без использования человеческих транскриптов. Например, модель Whisper от OpenAI была обучена на 680 000 часах многоязычного аудио. Модель wav2vec 2.0 от Meta показала, что предварительно обученную на неразмеченной речи модель можно дообучить всего на 10 минутах размеченных данных и при этом превзойти системы, обученные на данных в 100 раз большего объема. Этот подход является ключевой причиной того, почему современные системы STT надежно работают на десятках языков, включая те, для которых мало размеченных данных.

Эти три сдвига дополняют друг друга. Современные готовые к работе системы STT объединяют их все: глубокие нейронные архитектуры, сквозное обучение и предварительное самообучение. В результате уровень ошибок падает ниже 5% для чистого английского аудио и остается в диапазоне 8–15% даже в сложных условиях, которые десятилетие назад считались почти нерешаемыми.

Почему точность все еще так сильно варьируется на практике

Если технология так развита, почему ваш телефон все еще иногда ошибается? Потому что уровень ошибок в 5% измеряется в идеальных условиях. В реальном мире на речь влияют переменные, которые быстро увеличивают количество ошибок.

Вариации акцентов и диалектов. Модели STT обучаются преимущественно на стандартных диалектах широко распространенных языков. Общий американский акцент, записанный в тихой комнате, может дать почти идеальную транскрипцию. Сильный шотландский или индийский акцент в той же обстановке может поднять уровень ошибок до 10–15%. Региональные диалекты и переключение языков (code-switching) в середине предложения остаются серьезными проблемами.

Деградация качества звука. Каждый уровень сжатия, фоновый шум и расстояние между говорящим и микрофоном вносят искажения. Запись непосредственно в микрофон с частотой 44,1 кГц фундаментально отличается от записи на громкой связи через другое устройство на противоположном конце стола.

Наложение речи. Когда два человека говорят одновременно, большинство систем STT не могут выдать надежный результат для перекрывающегося сегмента. Модели разделения спикеров совершенствуются, но различение голосов, особенно со схожими характеристиками, остается технически сложной задачей.

Специализированная лексика. Стандартные модели STT не могут автоматически распознать названия продуктов вашей компании, отраслевые аббревиатуры или терминологию вашей области. Без адаптации под домен редкие слова заменяются обычными фонетически похожими словами.

Деградация на длинных записях. Некоторым моделям трудно удерживать контекст в очень длинных записях. Поскольку языковые модели работают в ограниченном окне, информация, полученная 30 минут назад, может перестать влиять на предсказания в текущем предложении. В результате транскрипт 5-минутной встречи часто точнее, чем 90-минутной, даже если они записаны в одинаковых условиях.

6 реальных сценариев, где STT приносит измеримую пользу

Преобразование речи в текст — это больше не просто удобная функция в телефоне. Это базовая инфраструктура для многих отраслей.

- Создание контента и журналистика: транскрибирование интервью, пресс-конференций и исходных записей. Журналист, записывающий 60-минутное интервью, может сэкономить 3–4 часа ручного труда, используя STT по цене примерно $0,01–0,10 за минуту, против $1–3 за минуту услуг человека.

- Доступность: субтитры в реальном времени помогают глухим и слабослышащим пользователям во время встреч, лекций и прямых трансляций. Во многих странах то, что раньше считалось премиальной функцией, стало законодательным требованием (например, правила ADA).

- Медицинская документация: врачи диктуют заметки в электронные медкарты. Медицинские системы STT, обученные на клинической лексике, экономят врачам в среднем 2 часа в день, согласно исследованию Stanford Medicine 2023 года.

- Аналитика обслуживания клиентов: транскрибирование и анализ миллионов звонков в службу поддержки для выявления трендов, проблем с комплаенсом и возможностей для обучения персонала.

- Юридическая транскрипция: судебные процессы, свидетельские показания и интервью с клиентами. В юридическом контексте пороги точности выше, так как ошибки в протоколе могут иметь серьезные последствия.

- Образование: создание транскриптов лекций, поиск по архивам записей занятий и поддержка студентов, которым легче воспринимать текст, чем аудио.

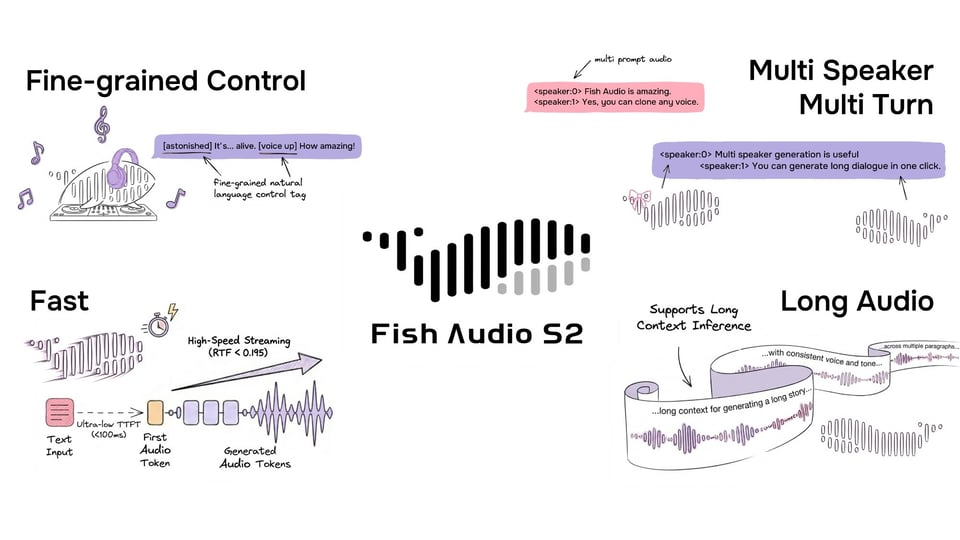

Как движок STT от Fish Audio применяет эти принципы

Как работает преобразование речи в текст? Одно дело — теоретический ответ, и совсем другое — выбор эффективного инструмента.

Движок Speech to Text от Fish Audio построен на том же поколении моделей, о которых говорилось выше: сквозные системы глубокого обучения с предварительным самообучением в различных аудиосредах. Вот как эти технические основы превращаются в практические возможности.

Устойчивая к шуму обработка. Этапы предобработки и акустического моделирования обучены на реальном аудио: телефонных записях, комнатной реверберации, уличном шуме и конференц-звонках. В результате разрыв в качестве между студийной записью и голосовой заметкой, сделанной на оживленном тротуаре, значительно меньше, чем у базовых потребительских инструментов.

Устойчивая к шуму обработка. Этапы предобработки и акустического моделирования обучены на реальном аудио: телефонных записях, комнатной реверберации, уличном шуме и конференц-звонках. В результате разрыв в качестве между студийной записью и голосовой заметкой, сделанной на оживленном тротуаре, значительно меньше, чем у базовых потребительских инструментов.

Английский, мандаринский, кантонский, японский и корейский с автоопределением языка. Модель Fish Audio использует преимущества метода самообучения. Изучая речевые паттерны на огромных многоязычных наборах данных, система сохраняет точность даже для тех языков, где не хватает обширных размеченных обучающих данных. Тот же архитектурный стержень поддерживает японский, арабский, португальский, тайский и десятки других языков.

Быстрая пакетная обработка. Пятиэтапная архитектура работает параллельно по аудиосегментам, а не последовательно. 60-минутная запись может быть обработана менее чем за 2 минуты, так как системе не нужно «прослушивать» аудио в реальном времени.

Доступ для разработчиков через API. Для команд, интегрирующих STT в свои продукты, API Fish Audio предоставляет тот же движок с задержкой на уровне миллисекунд для потоковой передачи в реальном времени и пакетные эндпоинты для обработки файлов.

Полный цикл работы со звуком

Движок STT от Fish Audio — это половина комплексной голосовой платформы. Вторая половина — это Text to Speech, предлагающий более 2 000 000 голосов, клонирование голоса за 15 секунд и поддержку более 13 языков. Вместе они формируют полный цикл, обрабатывая как устный, так и письменный контент внутри одной системы:

- Голос → Текст: загрузите запись и получите транскрипт (fish.audio/speech-to-text)

- Текст → Голос: вставьте текст, выберите голос и создайте готовое аудио (fish.audio/text-to-speech)

Для создателей контента и разработчиков объединение обоих направлений на одной платформе устраняет фрагментацию, вызванную использованием разных сервисов.

С чего начать

Бесплатный уровень достаточно щедр, чтобы протестировать систему на реальных записях. Загрузите аудиофайл, оцените качество транскрипции сами и сравните с вашим текущим решением. Платные тарифы начинаются от $11 в месяц. Полная информация о ценах здесь.

Что дальше: куда движется STT в 2026–2027 годах

Три тренда определят следующее поколение технологий STT.

Транскрипция с разделением спикеров в реальном времени. Сейчас диаризация (кто что сказал) часто выполняется на этапе постобработки. Следующее поколение будет делать это мгновенно во время живых разговоров с точной идентификацией на основе голосовых профилей.

Мультимодальный контекст. Системы STT будут все чаще использовать визуальные и контекстные сигналы. Если спикер показывает слайды, модель будет использовать текст на экране для улучшения распознавания технических терминов. Это превращает STT из чистого распознавания звука в понимание на основе нескольких сигналов.

Персонализированная адаптация словаря. Системы STT будут создавать индивидуальные профили, адаптируясь к отраслевым терминам пользователя, именам контактов и особенностям речи. Это сделает облачную адаптацию еще эффективнее с каждой новой транскрипцией.

Заключение

Преобразование речи в текст состоит из пяти уровней машинного обучения, каждый из которых решает задачу, кажущуюся человеку элементарной, но над которой компьютеры бились десятилетиями. Чтобы понять, как работает эта технология, нужно изучить весь конвейер: от очистки сигнала и извлечения признаков до акустического и языкового моделирования и финальной постобработки.

За десятилетие технология сократила уровень ошибок с 43% до менее чем 5%. Оставшийся разрыв между 95% и 99% точности кроется в работе с акцентами, шумом и специализированной лексикой. Для тех, кому нужен надежный STT в реальных условиях, Fish Audio предлагает технологии текущего поколения, доступные в браузере или через API.