Die beste Text-to-Speech API für Chatbots und Sprachassistenten im Jahr 2026

23. Feb. 2026

Die Demoversion Ihres Sprachassistenten klingt natürlich. Sie lassen jedes Mal dieselben 10 Testphrasen laufen, wenn Sie eine neue TTS-API evaluieren, die Antworten kommen sauber zurück und die Stimme wirkt fast menschlich. Dann setzen Sie sie echten Nutzern vor. Schon beim dritten Austausch stimmt etwas nicht. Die Pause vor jeder Antwort hat sich auf 900 ms ausgedehnt. Die Stimme, die isoliert betrachtet ausdrucksstark klang, wirkt bei der fünften Antwort hintereinander flach. Die Nutzer tolerieren die Stimme eher, als dass sie mit ihr sprechen.

Die TTS-Evaluierung für Chatbots und Sprachassistenten ist systematisch optimiert, da die Bedingungen, unter denen diese Produkte versagen – anhaltende Multi-Turn-Interaktionen unter realer Netzwerklast –, schwerer zu simulieren sind als ein einfacher Qualitätstest mit einer einzelnen Anfrage.

Was Single-Turn-Demos nicht messen

Es gibt drei Faktoren, die darüber entscheiden, ob eine TTS-API für Conversational AI geeignet ist, und keiner davon lässt sich in einem 10-sekündigen Clip gut darstellen:

Latenz beim Sprecherwechsel unter Last. Ein Sprachassistent fühlt sich reaktionsschnell an, wenn die Pause zwischen der Benutzereingabe und der Sprachantwort unter 400 ms liegt. Die meisten TTS-APIs liefern dies in einer schwach belasteten Testumgebung. Die Frage ist, was passiert, wenn 200 Nutzer gleichzeitig aktive Gespräche führen. Latenzspitzen bei hoher Parallelität sind die Hauptbeschwerde bei der Bereitstellung von Sprachassistenten in der Produktion.

Die menschliche Wahrnehmungsschwelle für Antworten in einem Gespräch liegt bei etwa 400-500 ms. Danach fangen die Nutzer an, die Stille mit Sprache zu füllen, was zu Crosstalk führt. Dies ist keine UX-Präferenz – es ist eine physiologische Grenze. Als wir einen Lasttest mit 50 simulierten gleichzeitigen Gesprächen auf einer Mid-Tier-Plattform durchführten, sprang die TTFB von 180 ms auf 2,8 Sekunden. Der Sprachassistent wurde ohne Vorwarnung von reaktionsschnell zu unbrauchbar, und in der Dokumentation des Anbieters gab es keinen Hinweis darauf, dass sich das Latenzprofil unter gleichzeitiger Last so drastisch ändern würde.

Konsistenz der Stimme über mehrere Dialogschritte (Multi-Turn). Einige TTS-Modelle erzeugen bei wiederholten Aufrufen für denselben Text eine leicht unterschiedliche Prosodie. In einer Single-Turn-Interaktion bemerkt das niemand. In einer Unterhaltung mit 10 Runden summiert die Stimme subtile Inkonsistenzen, wodurch sie weniger wie ein durchgängiger Charakter und mehr wie ein System klingt, das Antworten generiert.

Dieses Problem hat in Produktionsteams einen Namen: Persona-Kollaps. Wir stießen darauf, als wir eine beliebte TTS-API für einen Kundenservice-Chatbot testeten. In der 6. Runde des Gesprächs war die ursprünglich herzliche Kundenservice-Stimme in etwas abgedriftet, das wie ein Nachrichtensprecher klang, der gerade erst aufgewacht war. Die Wärme war weg. Das Tempo stimmte nicht mehr. Die Stimme, die sich im Test gewollt anfühlte, wirkte im Einsatz willkürlich. Wir konnten das Multi-Turn-Drift-Problem bei Fish Audio schließlich durch Anpassen spezifischer Parameter lösen – aber die Tatsache, dass wir Zeit dafür investieren mussten, stand in keiner Dokumentation.

Emotionale Bandbreite über verschiedene Antworttypen hinweg. Eine Conversational AI bewältigt Begrüßungen, Erklärungen, Korrekturen und Entschuldigungen. Die TTS-Stimme muss all dies angemessen modulieren und nicht nur beim Vorlesen einer neutralen Aussage gut klingen.

TTS-API-Vergleich für Conversational AI

| Plattform | TTFB | Streaming | Konsistenz (Multi-Turn) | Voice Cloning | Sprachen | Gleichzeitige Sitzungen |

|---|---|---|---|---|---|---|

| Fish Audio | Millisekunden-Bereich | Ja | Hoch | Ja (15 Sek. Sample) | 30+ | Hoch |

| ElevenLabs | Wettbewerbsfähig | Ja | Hoch | Ja | 30+ | Mittel |

| Azure TTS | Mittel | Enterprise-Tarif | Hoch | Begrenzt | 100+ | Enterprise |

| Google TTS | Mittel | Begrenzt | Hoch | Nein | 40+ | Hoch |

| Amazon Polly | Mittel | Ja | Hoch | Nein | 20+ | Hoch |

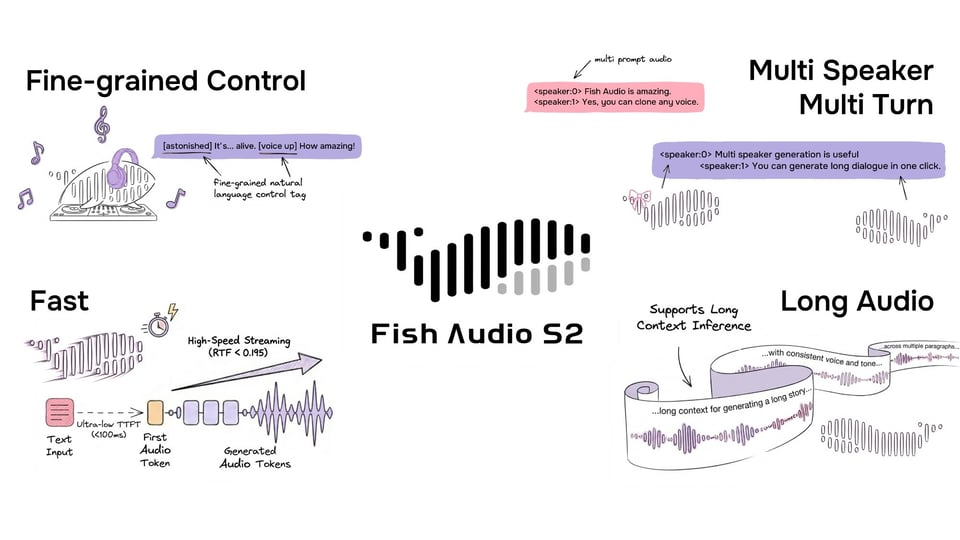

Fish Audio: Latenz und Konsistenz für Multi-Turn-Gespräche

Die beiden Anforderungen, die die Qualität eines Sprachassistenten am direktesten bestimmen, sind TTFB und Streaming-Unterstützung. Die Time-to-First-Byte im Millisekundenbereich von Fish Audio, kombiniert mit der Streaming-Auslieferung, bedeutet, dass Nutzer die Stimme bei einer normalen Verbindung innerhalb von 150-200 ms hören. Das liegt innerhalb der Schwelle, an der sich der Sprecherwechsel natürlich anfühlt.

Streaming ist für Conversational AI anders relevant als für Content-TTS. Bei einem Sprachassistenten tragen die ersten Wörter einer Antwort das höchste semantische Gewicht: "Ja, ich kann Ihnen dabei helfen" vs. "Es tut mir leid, das kann ich nicht tun." Mit Streaming treffen diese ersten Wörter in unter 200 ms ein. Der Nutzer versteht die Richtung der Antwort, noch bevor der vollständige Satz generiert wurde. Das ist qualitativ ein riesiger Unterschied dazu, 800 ms warten zu müssen, bis das komplette Audio fertig ist.

Die Architektur, die dies ermöglicht, besteht darin, den LLM-Output-Stream direkt mit dem TTS-Input-Stream zu verbinden. Anstatt zu warten, bis das Sprachmodell seine vollständige Antwort beendet hat, füttern Sie Text-Chunks in Fish Audio ein, sobald sie generiert werden. Die LLM-Streaming-Pipeline und die TTS-Streaming-Pipeline laufen parallel, und die Gesamtlatenz schrumpft auf die Latenz der jeweils langsameren Stufe – nicht auf die Summe aus beiden. So erreichen Sie eine End-to-End-Latenz von unter 500 ms in einem realen Einsatz.

Entwickler-Hinweis: Senden Sie lange LLM-Antworten nicht als einzelnen TTS-Aufruf. Unterbrechen Sie sie an natürlichen Satzgrenzen und streamen Sie sie als kürzere TTS-Aufrufe nacheinander. So können Sie früher mit der Audiowiedergabe beginnen und geben den Nutzern einen natürlichen Punkt für Unterbrechungen – genau wie in echten Gesprächen.

Die Unterstützung hoher Parallelität bedeutet, dass das Latenzprofil, das Sie während der Entwicklung beobachten, auch das ist, was die Nutzer tatsächlich erleben. Der dokumentierte Fall eines Chatbots, der mit Fish Audio eine End-to-End-Latenz von unter 500 ms erreicht, spiegelt reale Bedingungen wider, keine optimierte Benchmark-Umgebung.

Voice Cloning fügt eine Dimension hinzu, die speziell für Marken-Assistenten und Produkt-Personas wichtig ist. Anstatt aus einem Katalog generischer Stimmen zu wählen, können Sie einen spezifischen Sprachcharakter erstellen, der konsistent mit Ihrer Markenidentität ist. Die Anforderung von nur 15 Sekunden Audiomaterial macht dies praktikabel, ohne dass professionelle Aufnahmesitzungen erforderlich sind. Die geklonte Stimme funktioniert in allen über 30 unterstützten Sprachen, sodass ein einzelner Charakter ohne Neuaufnahmen international skaliert werden kann.

Der Stimmenkatalog von Fish Audio ist groß – über 2.000.000 Community-Stimmen – und bietet sofortige Optionen, wenn Sie nicht klonen möchten. Es ist jedoch zu beachten, dass der Katalog zu bestimmten Stimmenprofilen neigt. Wenn Sie einen sehr spezifischen regionalen Akzent oder eine sehr markante Charakterstimme benötigen, müssen Sie diese möglicherweise klonen, anstatt sie im Katalog zu suchen. Das ist kein Ausschlusskriterium, aber eine realistische Erwartung.

API-Dokumentation unter docs.fish.audio.

ElevenLabs: Qualität für englischsprachige Assistenten

Ehrlich gesagt: Wenn Sie eine immersive Begleiter-KI auf Englisch bauen und die Stimme selbst das Produkt ist, bleibt die emotionale Bandbreite von ElevenLabs der Maßstab. Der Unterschied darin, wie ElevenLabs im Vergleich zu den meisten anderen Plattformen Zögern, Betonung und emotionalen Subtext auf Englisch handhabt, ist hörbar. Er ist nicht marginal. Für ein Produkt, bei dem der Charakter der Stimme der Kern des Nutzererlebnisses ist – eine Companion-App, ein Storytelling-Assistent oder ein therapieähnliches Tool – rechtfertigt die Ausgabequalität von ElevenLabs auf Englisch die Kompromisse.

Diese Kompromisse sind real. Das Preismodell pro Stufe bedeutet, dass Stoßzeiten Sie in höhere Tarife zwingen können, und bei Produkten mit schwankender Nutzung wird die Abrechnung unvorhersehbar. Streaming funktioniert unter Standardbedingungen gut, aber bei massiver Parallelität hat Fish Audio einen strukturellen Vorteil. Für einen Sprachassistenten, der ausschließlich Englisch verarbeitet und bei dem das Gesprächsvolumen vorhersehbar ist, ist ElevenLabs aufgrund der reinen Ausgabequalität die stärkste Option. Bei mehrsprachigen Anforderungen oder hoher Parallelität verschiebt sich dieses Kalkül.

Azure TTS: Der Weg für Enterprise-Umgebungen

Die Qualität von Azure Neural TTS hat ein Niveau erreicht, das für Konversationsanwendungen wettbewerbsfähig ist. Die Zuverlässigkeit und das Enterprise-SLA machen es zur Standardwahl für Organisationen, die bereits auf Azure-Infrastruktur setzen.

Streaming ist verfügbar, erfordert aber in der Regel Zugriff auf den Enterprise-Tarif. Voice Cloning ist komplex zu konfigurieren und nicht für die schnelle Erstellung von Stimmen ausgelegt, wie sie Content-Ersteller oder kleinere Teams benötigen. Wenn Ihr Anwendungsfall ein Enterprise-IVR-System oder ein groß angelegter Kundenservice-Bot mit stabilen, definierten Stimmanforderungen ist, funktioniert Azure gut. Für experimentellere Conversational AI-Entwicklungen bremst der Konfigurationsaufwand die Iteration.

Design-Patterns zur Verbesserung der Konversationsqualität

Die Plattformwahl ist ein Hebel. Wie Sie die Sprachinteraktion konfigurieren, ist ein anderer.

Nutzen Sie Streaming ab der ersten Antwort. Warten Sie nicht, bis das gesamte Audio verfügbar ist. Spielen Sie den ersten Chunk ab und puffern Sie den Rest. Das Gefühl einer echten Konversation entsteht durch schnelles erstes Audio, nicht durch schnelles vollständiges Audio.

Passen Sie die Stimmauswahl an das Register des Anwendungsfalls an. Die Stimme einer Begleiter-KI und die eines Kundenservice-Bots sollten unterschiedlich klingen. Das emotionale Profil ist entscheidend: wärmer für Companion-Apps, sachlicher für die Informationsvermittlung, optimistischer für Consumer-Apps.

Halten Sie einzelne Antworten kurz. Die TTS-Qualität pro Audioeinheit ist bei kurzen, vollständigen Sätzen am höchsten. Lange Antworten bieten mehr Raum für Inkonsistenzen in der Prosodie. Wenn Ihr LLM eine Antwort aus vier Sätzen generiert, prüfen Sie, ob das Streamen als vier separate TTS-Aufrufe (und das sequentielle Abspielen) eine bessere Sprachqualität liefert als ein einzelner Aufruf mit vier Sätzen.

Generieren Sie statische Antworten vor. Begrüßungen, Bestätigungen und Überleitungen ("Lassen Sie mich das für Sie nachsehen") werden jedes Mal identisch generiert. Erzeugen Sie diese einmal vor und liefern Sie sie aus dem Cache aus. So eliminieren Sie die API-Latenz für die häufigsten Äußerungen vollständig.

Entwickler-Hinweis: Sprachassistenten benötigen ein Interaktionsmanagement. Wenn ein Nutzer spricht, während die TTS abgespielt wird, muss das Audio sauber stoppen. Implementieren Sie dies vor dem Test mit echten Nutzern – die UX bei Unterbrechungen ist der wichtigste Faktor dafür, ob sich ein Assistent natürlich anfühlt.

Die passende Plattform für jeden Chatbot-Typ

Companion-KI und Social Bots: Emotionale Reichweite und Natürlichkeit der Stimme sind wichtiger als jede andere Variable. Fish Audio oder ElevenLabs. Der Vorteil von Fish Audio steigt, wenn Sie mehrsprachige Unterstützung oder eine benutzerdefinierte Charakterstimme benötigen.

Kundenservice-Bots: Mehrsprachigkeit und Zuverlässigkeit stehen an erster Stelle. Fish Audio unterstützt über 30 Sprachen mit einer einzigen API und konsistenter Qualität. Hohe Parallelität ist wichtig für Kundenservice-Anwendungen mit Volumenpeaks.

IVR- und Telefonsysteme: Latenzanforderungen sind etwas weniger streng als bei Web- oder App-Assistenten. SSML-Kontrolle für Aussprache und Tempo ist hier wichtiger. Azure oder Amazon Polly sind speziell für den Telefonkanal gut geeignet.

Informations-Assistenten (FAQ-Bots, Wissens-Bots): Die Stimme muss autoritär und klar klingen. Eine neutrale, gemessene Stimme von einer der großen Plattformen funktioniert hier gut. Latenz und Kosten sind an dieser Stelle die primären Differenzierungsmerkmale.

Häufig gestellte Fragen

Welche TTS-Latenz benötige ich, damit sich ein Sprach-Chatbot natürlich anfühlt? Eine TTFB (Time to First Byte) von unter 400 ms erhält den natürlichen Sprecherwechsel aufrecht. Unter 200 ms fühlt es sich unmittelbar an. Über 600 ms führt dazu, dass Nutzer anfangen zu sprechen, bevor der Bot fertig ist, oder in unangenehmer Stille warten. Die Millisekunden-TTFB von Fish Audio hält Antworten im natürlichen Bereich.

Kann ich eine eigene Markenstimme für meinen Sprachassistenten erstellen? Ja. Das Voice Cloning von Fish Audio erstellt eine Markenstimme aus einer 15-sekündigen Aufnahme, die dann alle TTS-Ausgaben in dieser Stimme generiert. Der Klon funktioniert in über 30 Sprachen, sodass eine einzelne Markenstimme international skaliert werden kann.

Funktioniert Streaming-TTS mit Conversational-AI-Pipelines? Ja, und es ist die empfohlene Architektur. Streaming bei Fish Audio bedeutet, dass der Nutzer den Anfang einer Antwort hört, während der Rest noch generiert wird. Kombiniert mit Streaming-Textgenerierung eines LLM kann die End-to-End-Latenz unter 500 ms fallen.

Was passiert mit der TTS-Qualität bei einem langen Gespräch (10+ Runden)? Die Konsistenz der Stimme über mehrere Runden wird durch das TTS-Modell bestimmt, nicht durch die Länge des Gesprächs. Das Modell von Fish Audio erzeugt eine konsistente Prosodie bei wiederholten Aufrufen, was den Stimmendrift verhindert, den einige Plattformen in Multi-Turn-Sitzungen zeigen.

Lohnt sich Voice Cloning für einen Kundenservice-Chatbot? Für Marken-Chatbots, bei denen eine konsistente Unternehmensidentität wichtig ist: ja. Eine geklonte Stimme, die zum Kommunikationsstil Ihrer Marke passt, ist effektiver als eine Auswahl aus einem generischen Katalog. Die 15-sekündige Mindestprobe von Fish Audio macht dies ohne professionelles Budget praktikabel.

Welche TTS-API bewältigt mehrere gleichzeitige Chatbot-Gespräche am besten? Die Unterstützung für hohe Parallelität von Fish Audio ist genau dafür ausgelegt. Das Latenzprofil bleibt auch unter gleichzeitiger Last konsistent. Azure und Google bewältigen hohe Parallelität ebenfalls gut, jedoch mit anderen Kompromissen bei Qualität und Funktionen.

Fazit

Für Conversational AI läuft die Wahl der TTS-API auf zwei Fragen hinaus: Kann sie Audio schnell genug liefern, damit sich der Sprecherwechsel natürlich anfühlt, und kann sie diese Leistung aufrechterhalten, wenn hunderte Gespräche gleichzeitig stattfinden?

Die Millisekunden-TTFB von Fish Audio, die Streaming-Unterstützung, die hohe Parallelität und das Voice Cloning machen es zur komplettesten Option für Konversationsanwendungen. ElevenLabs eignet sich für rein englischsprachige Anwendungsfälle, in denen die Stimme selbst das Produkt ist. Azure und Google sind die Wahl für Enterprise- oder infrastrukturgebundene Umgebungen, in denen diese Ökosysteme bereits die Architektur vorgeben.

Testen Sie unter gleichzeitiger Last, bevor Sie sich festlegen. Ein Sprachassistent, der bei einem Nutzer funktioniert, lässt keine Rückschlüsse auf das Verhalten bei 500 Nutzern zu. API-Dokumentation und Integrationsdetails unter docs.fish.audio.