Wie man Prompts in komplette Songs verwandelt: Text-zu-Musik

8. März 2026

Vor nicht allzu langer Zeit bedeutete die Erstellung eines Songs noch, Studiozeit zu buchen, Musiker einzustellen oder zumindest Stunden mit Digital Audio Workstations (DAWs) zu verbringen. Fachleute in der Branche brauchten ein Studium, um alles zu verstehen. Heute können Sie einen Satz tippen und in weniger als einer Minute einen fertigen Track erhalten. Text-zu-Musik-KI hat sich still und heimlich zu einem der aufregendsten verfügbaren kreativen Werkzeuge entwickelt und zieht die Aufmerksamkeit von Content-Erstellern, Indie-Filmemachern, Spieleentwicklern und neugierigen Hobbyisten gleichermaßen auf sich – besonders wenn diese Tracks lizenzfrei sind. Aber wie funktioniert das eigentlich? Und was noch wichtiger ist: Wie schreibt man Prompts, die Musik liefern, die man auch wirklich verwenden möchte? Lassen Sie uns das Ganze aufschlüsseln.

Einführung

Text-zu-Musik wird im Grunde verwendet, wenn ein KI-Modell Audio basierend auf Ihrer Beschreibung generiert. Die Technologie hat sich rasant entwickelt. Frühe Tools konnten einfache Loops oder schlichte Akkordfolgen erzeugen. Heutige Modelle können vollständige Kompositionen mit unterschiedlichen Strophen, Hooks und Instrumentierungen generieren, von denen einige wirklich professionell klingen.

Hinter den Kulissen werden diese Systeme mit massiven Datensätzen aus Musik- und Textpaaren trainiert. Sie lernen die Beziehungen zwischen beschreibender Sprache wie „melancholisches Klavier“, „treibender 80er-Jahre-Synth“, „Lo-Fi mit Regengeräuschen“ und den tatsächlichen klanglichen Qualitäten, die diese Wörter repräsentieren. Wenn Sie einen Prompt eingeben, interpretiert das Modell diesen und erstellt Audio, das der von Ihnen beschriebenen Stimmung entspricht.

Dies unterscheidet sich grundlegend von Stock-Musikbibliotheken. Sie suchen nicht nach etwas, das annähernd Ihren Anforderungen entspricht. Sie generieren etwas, das genau auf Ihre Vision zugeschnitten ist – und wenn es das Ziel verfehlt, können Sie den Prompt verfeinern und es erneut versuchen.

Der Begriff „lizenzfrei“ (royalty-free) ist für jeden, der professionell oder semi-professionell Inhalte erstellt, von großer Bedeutung. Traditionelle Lizenzierung kann kompliziert sein: Man kauft einen Track, aber die Rechte sind unklar, die Plattform beansprucht ihn oder man erhält einen Copyright-Strike für ein Video, an dessen Bearbeitung man 40 Stunden gesessen hat. Lizenzfreie KI-Songs umgehen diesen Reibungspunkt meist. Da das Audio neu generiert wird, anstatt aus einer urheberrechtlich geschützten Aufnahme reproduziert zu werden, sind die Nutzungsrechte in der Regel viel klarer. Die meisten KI-Musikplattformen bieten Tracks an, die kostenlos in YouTube-Videos, Podcasts, Social-Media-Inhalten, Kurzfilmen und kommerziellen Projekten verwendet werden können – manchmal mit einer einfachen Quellenangabe, manchmal völlig ohne Bedingungen.

Dies ist enorm wichtig für kleine Content-Ersteller, die sich keine Lizenzgebühren leisten können, aber dennoch möchten, dass ihre Inhalte professionell wirken. Es ist wichtig für Spieleentwickler, die stundenlange adaptive Hintergrundmusik benötigen. Es ist wichtig für Marketer, die schnelle Ergebnisse für Videoanzeigen ohne rechtliche Kopfschmerzen brauchen.

Hier machen die meisten Leute einen Fehler: Sie schreiben vage Prompts und wundern sich dann, warum das Ergebnis generisch klingt. „Fröhliche Hintergrundmusik“ liefert Ihnen zwar technisch gesehen etwas Fröhliches, aber es wird nicht interessant sein. Spezifische, vielschichtige Prompts machen den Unterschied zwischen einer vergessenswerten Ausgabe und etwas, das man behalten möchte.

Strukturieren Sie Ihre Beschreibungen

Ein starker Musik-Prompt deckt typischerweise vier Dinge ab: Genre oder Stil, Stimmung oder Emotion, Instrumentierung und Tempo oder Energieniveau. „Cinematisch-orchestral, spannend und sich steigernd, schwere Streicher und Blechbläser, langsames Tempo mit einer dramatischen Steigerung“ gibt der KI viel mehr Arbeitsgrundlage als „spannende Musik für einen Film“.

Beziehen Sie sich auf Epochen und Szenen

KI-Musikmodelle reagieren gut auf kontextuelle Referenzen. Sätze wie „klingt wie eine Coffee-Shop-Playlist aus den späten 90ern“ oder „die Art von Musik, die in einer Retro-80er-Science-Fiction-Eröffnungsszene läuft“ geben dem Modell stilistische Ankerpunkte. Sie rufen im Grunde eine sehr spezifische ästhetische Erinnerung ab, und das Modell greift auf Muster zurück, die es aus der Musik gelernt hat, die mit diesen Stimmungen verbunden ist.

Spezifizieren Sie die Struktur, wenn es darauf ankommt

Wenn Sie einen Track mit einem definierten Bogen benötigen – ein ruhiges Intro, ein sich steigernder Mittelteil, ein kraftvoller Abschluss – sagen Sie das. Einige Plattformen lassen Sie die emotionale Reise des Songs Takt für Takt beschreiben. Diese Art von strukturellem Prompting verbessert die Nutzbarkeit des fertigen Tracks für Video- oder Präsentationsarbeiten drastisch.

Einige Tools, die man kennen sollte

Der Bereich Text-zu-Musik ist schnell unübersichtlich geworden, mit Plattformen, die von einfachen Generatoren bis hin zu kompletten Kreativ-Suites reichen. Zwei Namen, die oft fallen, sind Suno und Fish Audio.

Suno ist bekannt geworden für die Generierung kompletter Songs – Gesang, Texte und Instrumentierung – aus einem einzigen Text-Prompt. Es ist zugänglich genug für Menschen ohne musikalischen Hintergrund und liefert Ergebnisse, die in manchen Fällen kaum von menschlichen Demos zu unterscheiden sind. Die Ausgaben neigen zu strukturiertem Pop und Genremusik, und es ist ein beliebter Einstiegspunkt für Ersteller geworden, die schnell voll produzierte Tracks benötigen.

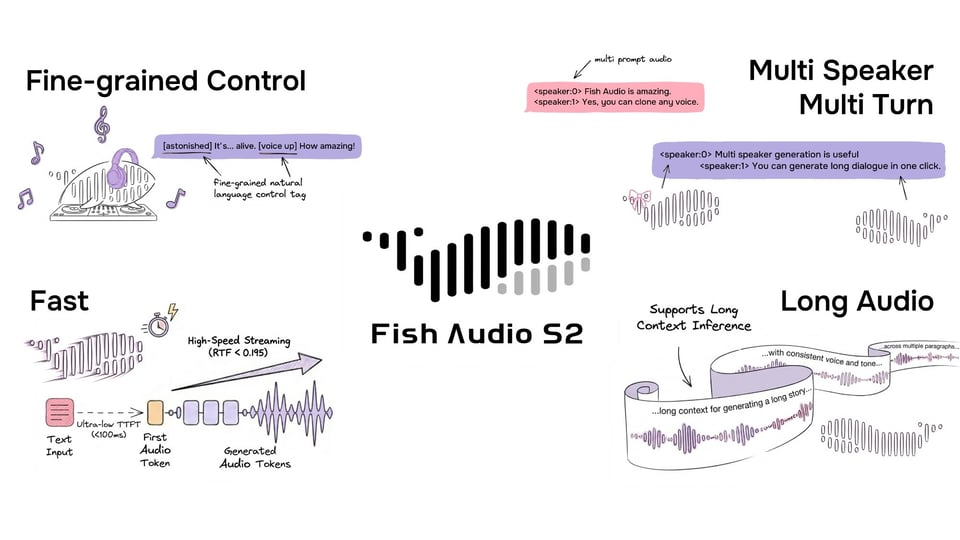

Fish Audio verfolgt einen anderen Ansatz. Im Kern ist es eine Plattform, die auf hochwertigem Stimmen-Klonen und Text-zu-Sprache-Synthese basiert, aber sie hat sich in ein breiteres Feld der Audiogenerierung ausgeweitet. Eine der herausragenden Funktionen ist die Fähigkeit, eine Stimme aus einer kurzen Audioprobe zu klonen und diese Stimme dann zur Generierung von neuer Sprache, Narration oder gesungenem Gesang zu verwenden. Dies macht es besonders nützlich für Ersteller, die Konsistenz über Projekte hinweg wünschen, wie ein Podcast-Host, der eine KI-Stimme möchte, die wirklich wie er selbst klingt, oder ein Entwickler, der einen Sprachassistenten mit einer spezifischen Persönlichkeit baut.

Fish Audio bietet auch einen Marktplatz für von der Community geteilte Stimmenmodelle an, was bedeutet, dass Sie Stimmen durchsuchen können, die von anderen Benutzern erstellt und hochgeladen wurden, und diese auf Ihre eigenen Projekte anwenden können. Es richtet sich eher an Entwickler und technisch versierte Ersteller als an Gelegenheitsnutzer, wobei der API-Zugriff ein wesentlicher Teil der Attraktivität ist. Wenn Sie ein Produkt oder einen Workflow erstellen, der eine programmgesteuerte Audiogenerierung erfordert, bietet Ihnen Fish Audio die Infrastruktur, um dies sauber zu integrieren.

Beide sind erkundenswert, je nachdem, was Sie benötigen. Suno eignet sich hervorragend für die schnelle Produktion von fertig klingender Musik. Fish Audio ist besser für diejenigen geeignet, die den Generierungsprozess tiefergehend aufbauen oder anpassen möchten.

Der Weg zum guten Ergebnis durch Iteration

Eine Sache, die neue Benutzer oft nicht merken, ist, dass die Generierung von KI-Musik ein iterativer Prozess ist, keine einmalige Sache. Ihre erste Ausgabe wird wahrscheinlich nicht perfekt sein – und das ist völlig in Ordnung. Betrachten Sie die erste Generation als einen Entwurf, der Ihnen sagt, was Sie anpassen müssen.

Wenn die Stimmung nicht stimmt, fügen Sie mehr emotionale Beschreibungen hinzu. Wenn sich das Tempo nicht richtig anfühlt, beschreiben Sie die Energie anders: „dringlich und schnell“ im Vergleich zu „langsam und bedächtig“ wird selbst innerhalb desselben Genres sehr unterschiedliche Ergebnisse liefern. Wenn ein Instrument alles andere übertönt, notieren Sie explizit die gewünschte Balance: „Klavier-fokussiert mit dezenten Hintergrundstreichern“.

Fazit

Betrachten Sie es wie die Zusammenarbeit mit einem Studiomusiker, der unendliche Geduld und kein Ego hat. Sie können fünfmal auf unterschiedliche Weise nach derselben Sache fragen, bis Sie genau das erhalten, was Sie in Ihrem Kopf gehört haben.

Text-zu-Musik-KI ist nicht nur eine Spielerei – sie wird bereits in echten, praktischen Workflows eingesetzt. YouTube-Ersteller generieren benutzerdefinierte Hintergrundmusik, die zum emotionalen Ton jedes Segments passt. Podcaster erstellen Titelmelodien und Übergangselemente, ohne Komponisten einzustellen. Indie-Spieleentwickler erstellen stundenlange adaptive Ambient-Musik, die sich basierend auf dem Gameplay verändert.

Auf der geschäftlichen Seite nutzen Marketingteams die Technologie für schnelle Anzeigenentwürfe, Markenpräsentationen und Social-Media-Inhalte. Therapeuten und Entwickler von Wellness-Apps generieren beruhigende oder fokusfördernde Klanglandschaften. Sogar Pädagogen erkunden die Möglichkeiten, ansprechende Audioumgebungen für Online-Kurse zu schaffen.